Adaptive Deconvolutional Networks for Mid and High Level Feature Learning

用于中高级特征学习的自适应反卷积网络

本文章记录反卷积网络论文阅读后的心得

摘要

文章提出了一个层次模型,通过交替层卷积稀疏编码和最大池化来学习图像分解。当在自然图像上训练时,我们的模型层以各种形式捕捉图像信息:低级边缘、中级边缘连接、高级对象部分和完整对象。为了构建我们的模型,我们依赖于一种新颖的推理方案,该方案确保每一层都重新构建输入,而不仅仅是直接在下面的层的输出,就像现有分层方法中常见的那样。这使得学习多层表示成为可能,我们展示了4层模型,训练来自Caltech-101和256个数据集的图像。当与标准分类器相结合时,从这些模型中提取的特征优于SIFT,以及其他特征学习方法的表现。

网络结构

上采样

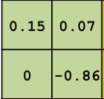

首先我们要理解此feature maps 是一个3D特征图,可以把k=1看做第一层,k=2看做第二层,构成一个三维矩阵。然后对此3D特征图做最大池化操作,并且记录下每个最大特征的具体位置。本文中进行上采样的方法只是其中一个,首先根据上面步骤记录的位置图,把最大特征填入,其他位置全部置0.

k=1

k=2

如何来看3D的位置:

-0.21数值对应三维的位置就是(1,1,1),0.45数值对应的三维位置即是(1,2,1),同样-0.86对应(2,1,2)。其他特征亦是同理获取3D位置。

模型两层可视化

每一层由反卷积和最大池化组成。反卷积层是稀疏编码的卷积形式,它将输入图像y分解为特征映射z1(绿色)和学习滤波器f1(红色),它们一起卷积和重建y。滤波器有c个平面,每个平面用于重建输入图像的不同通道(获取不同深度特征)。每个z 特征图都有每个元素的1个稀疏性(紫色)。特征图内和特征图之间的最大池化层池,减小了它们的大小和数量,以提供池化图p(蓝色)。每个池区最大值的位置记录在交换机s(黄色)中。第二个反卷积/池化层在概念上与第一个相同,但现在有两个输入通道,而不是三个。实际上,我们每层有更多特征地图,总共最多有4层。

操作框图

实例图

未完待续。。。

3730

3730

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?