1.Overlapping Pooling :能够得到更准确的结果,并且不容易过拟合。

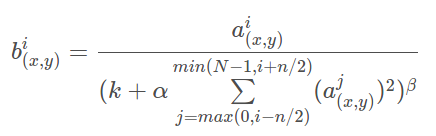

2.Local Response Normalization:tanh和sigmoid的输出值域有上下界,ReLU这类激活函数得到的值域不是一个区间,所以要对ReLU得到的结果进行归一化。(参考:https://blog.csdn.net/luoluonuoyasuolong/article/details/81750190)

分子为当前kernel在(x,y)激活后的值,分母中累加的是当前kernel的相邻的n个kernel在(x,y)激活后的值,AlexNet使用的参数:k=2,n=5,α=10−4,β=0.75。

3.

569

569

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?