master log中报 :

ERROR org.apache.hadoop.hdfs.server.namenode.NameNode: RECEIVED SIGNAL 15: SIGTERM

2015-12-09 11:50:50,870 INFO org.apache.hadoop.hdfs.server.namenode.NameNode: SHUTDOWN_MSG:

DataNode 中报WARN org.apache.hadoop.hdfs.server.datanode.DataNode: IOException in offerService

java.io.EOFException: End of File Exception between local host is: "node1/192.168.176.129"; destination host is: "master":9000; : java.io.EOFException; For more details see: http://wiki.apache.org/hadoop/EOFException

方法为:重新格式化各个节点,。。web访问不到的问题是,dns解析问题。

①dfs。xml 文件配置下的目录 ② core 文件配置下的目录 ③ log 日志 每个节点都要格式化

因为之前正常启动过hadoop集群。所以在hadoop的对应data目录中,已经有很多相关文件夹了。我们在格式化之前得先删除相关文件夹才行。

一、对于master主节点进行操作

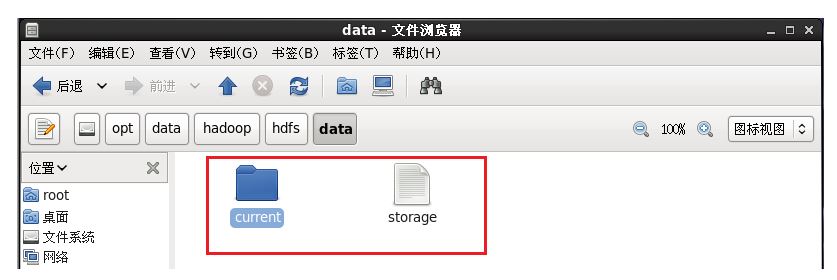

1、删除data、name、namesecondary三个文件夹。

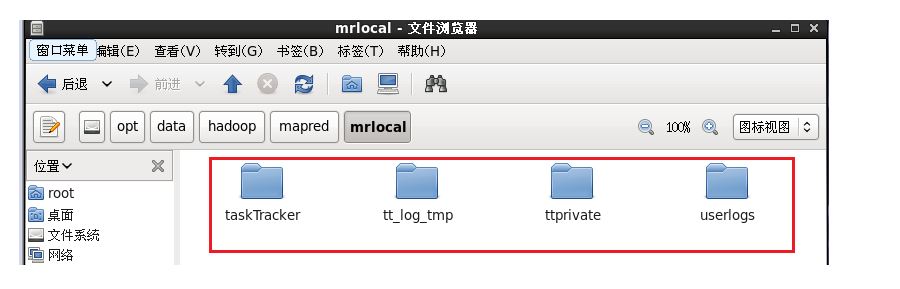

2、删除mrlocal目录中的四个文件夹

3、删除logs文件夹中的所有文件

二、对于node节点进行操作

1、删除hdfs/data中的所有文件

2、删除mrlocal中的所有文件

基本删除完成后。开始重新格式化namenode

三、格式化namenode

[hadoop@master hadoop]$ bin/hadoop namenode -format

格式化成功后。重新启动集群

四、重新启动集群

[hadoop@master hadoop]$ bin/start-all.sh五、查看集群启动情况

[hadoop@master hadoop]$ jps

3851 Jps

3744 TaskTracker

3622 JobTracker

3279 NameNode

3533 SecondaryNameNode

3395 DataNode

如看到

[hadoop@master hadoop]$ jps

3851 Jps

3744 TaskTracker

3622 JobTracker

3279 NameNode

3533 SecondaryNameNode

3395 DataNode

4554

4554

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?