作者:禅与计算机程序设计艺术

1.简介

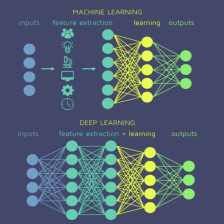

随着深度学习技术的不断推进、神经网络的普及应用,越来越多的研究人员和工程师将注意力放在机器学习领域的一些重要问题上——特别是分类任务(classification)上的一些非常具有挑战性的问题。在这项工作中,作者会从“软最大化回归”的原理出发,引导读者理解它在深度学习模型中的作用,并阐述其在解决分类问题中的巧妙之处。

2.基本概念术语说明

首先,需要对一些基本的概念和术语进行说明,以便于后面的叙述更清晰准确。

-

Softmax function: 即softmax函数,又称softmax映射,是一个归一化的指数函数,它将输入的n个实数,通过对其求取自然对数并归一化为概率分布。其定义如下:

σ ( z

本文深入探讨了softmax回归的工作原理,详细介绍了softmax函数、交叉熵损失函数、参数优化和模型评估。通过实例展示了如何在多分类问题中应用softmax模型,包括数据准备、模型搭建、超参数设置、训练与评估。同时,提到了标签平滑、迁移学习等概念,有助于理解模型的优化和泛化能力。

本文深入探讨了softmax回归的工作原理,详细介绍了softmax函数、交叉熵损失函数、参数优化和模型评估。通过实例展示了如何在多分类问题中应用softmax模型,包括数据准备、模型搭建、超参数设置、训练与评估。同时,提到了标签平滑、迁移学习等概念,有助于理解模型的优化和泛化能力。

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?