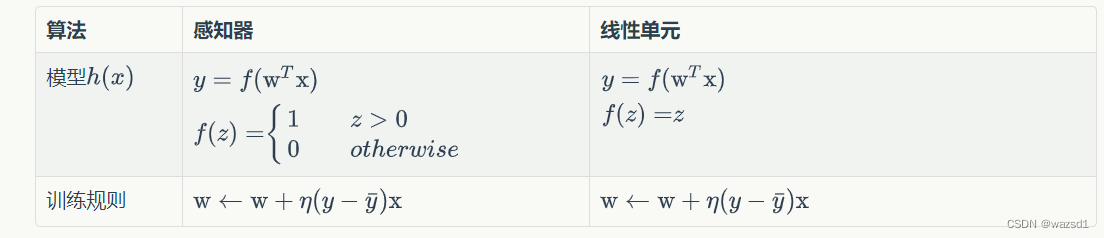

线性单元和感知器的区别在于激活函数的不同:

线性单元:

感知器:

BGD:每次更新的迭代,要遍历训练数据中所有的样本进行计算,我们称这种算法叫做批梯度下降(Batch Gradient Descent)。

SGD:每次更新的迭代,只计算一个样本。这样对于一个具有数百万样本的训练数据,完成一次遍历就会对更新数百万次,我们称为随机梯度下降算法(Stochastic Gradient Descent, SGD)。

随机梯度下降所带来的波动有个好处就是,对于类似盆地区域(即很多局部极小值点)那么这个波动的特点可能会使得优化的方向从当前的局部极小值点跳到另一个更好的局部极小值点,这样便可能对于非凸函数,最终收敛于一个较好的局部极值点,甚至全局极值点。

import matplotlib.pyplot as plt

import numpy as np

# 线性单元

def h(m): # 求和

return (w1 * m + z)

# 激活函数, y=x简单线性, 可以将想拟合的函数写入,比如一些非凸函数

# 对非凸函数,初始值的不同,可导致最终训练到不同的鞍点和局部最小值

def f(x):

return x

x1 = [3, 5, 7, 8, 10]

y = [33, 49, 72, 79, 101]

z = -0.4 # 权重

w1 = 0.2

a = 0.00001 # 学习率,太高会无法拟合,跳出或循环在一个范围内

e = 0.00001

i = 0

j = 0

while True:

if abs(y[i] - f(h(x1[i]))) < e and abs((y[i] - f(h(x1[i]))) * x1[i]) < e: # 偏导同时趋于零

break

else:

z = z + a * (y[i] - f(h(x1[i])))# 迭代权重值

本文介绍了线性单元与感知器的区别,重点讨论了随机梯度下降(SGD)的优势,以及学习率对非凸函数优化的影响。讨论了学习率的选择策略,包括经验设定、数据集大小的影响、动态调整学习率的方法,并提到了指数衰减法和SVRG算法。文章强调了学习率适中对于模型训练的重要性。

本文介绍了线性单元与感知器的区别,重点讨论了随机梯度下降(SGD)的优势,以及学习率对非凸函数优化的影响。讨论了学习率的选择策略,包括经验设定、数据集大小的影响、动态调整学习率的方法,并提到了指数衰减法和SVRG算法。文章强调了学习率适中对于模型训练的重要性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

761

761

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?