基于超完备字典的信号稀疏分解是一种新的信号表示理论,其采用超完备的冗余函数系统代替传统的正交基函数,为信号自适应的稀疏扩展提供了极大的灵活性。稀疏分解可以实现数据压缩的高效性,更重要的是可以利用字典的冗余特性捕捉信号内在的本质特征。

信号稀疏分解的基本思想是:使用超完备的冗余函数字典作为基函数,字典的选择尽可能地符合被逼近信号的结构,字典中的元素被称为原子。利用贪婪算法或者自适应追踪算法,从字典中找到具有最佳线性组合的很少的几项原子来表示一个信号,也称作高度非线性逼近。本文主要利用字典的冗余特性可以更好地捕捉信号本质特征这一特点,提出数据分类算法SRC。实验结果表明,SRC算法在分类准确性上优于SVM和Fld算法,不平衡数据集的分类实验结果显示了该算法的鲁棒性。

几个专业名词解析:

原子:字典的列向量。

完备字典与过完备字典:如果字典D中的原子恰能够张成n维的欧式空间,则字典D是完备的。如果m》n,字典D是冗余的,同时保证还能张成n维的欧式空间,则大字典D是过完备的。

面对稀疏表示模型,有三个关键问题需要解决,如下:

1.如何有效获取图像在字典中下最稀疏的分解系数。2.如何设计与构建有效的图像稀疏表示字典。3.如何将图像稀疏表示模型应用于具体的图像处理反问题中。

首先,Dictionary是一种sparse representation(稀疏表示)的模型。比如你的数据是y,字典是D,y=Dx,其中x是稀疏的。如果你的D是方阵或者长方形矩阵(正交矩阵除外),字典很可能是不确定的。相反的,如果你的D是个fat matrix 冗余矩阵,形象地讲,你拥有多于必要的列来表达这个数据(冗余)。这样的字典称为Overcomplete dictionary。这种字典的优势是更有利于表达highly diversified(高度多元化)的数据(图像)。

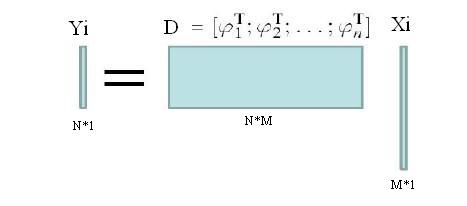

特征学习的过程中,假设学习的码书D的大小为M。每个码字的维数为N。每个原始特征Yi的维数也为N。假设原始特征投影到码书上以后的特征向量是Xi(M维的矢量),那么用D和Xi对Yi重建的过程就是:Yi=D*Xi。

coding的过程就变成了已知Yi和D,求Xi的过程了。显然这是一个非齐次方程组求解的问题,方程组有解的条件是rank(D)≤M,其中取等号时方程组有唯一解。过完备的定义是M>>N,所以此时 rank(D)≤N<<M,此时方程组有无穷多解。(你可能会问,这和最小化平方误差为目标函数不一样啊!其实求个导,就变成这个方程组了。)这就是过完备造成的问题了。怎么办呢?办法就是对Xi做约束------稀疏的约束,这样Xi就有唯一解了。这就是需要加约束的原因。而为什么是稀疏的约束,这个再谈。

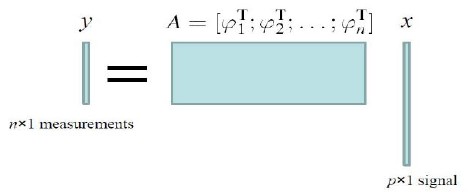

特征选择的过程,也是一样的。假设此时有n个样本,每个样本有个measurement(这个measurement可以是regression中的output,也可以是classification中的label)。每个样本的特征是p维的,n个样本的特征组成n*p的矩阵A。目标是对这p维特征做一个选择,选择的系数用x记录。此时将如下图所示:

这与第一个图是等价的,特征选择过程中的over-complete是指p>>n,不加约束的情况下x将有无穷多组解,所以和特征学习一样,加系数的约束。xi为0表示相应的特征不被选择。(而xi<0,等价于取一个|xi|,而将相应的特征的值取负号。)

如果measurement不是一维的咋办?比如multi-label的问题。我猜测把x的列维数也扩展成相应大小,然后根据label之间的correlation加低秩等约束吧。

稀疏表示是最近几年信号处理领域的热点之一,简单来说,它其实是一种对原始信号的分解过程,该分解过程借助一个事先得到的字典(也有人称之为过完备基,overcomplete basis,后面会介绍到),将输入信号表示为字典的线性近似的过程。即:

2185

2185

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?