用Python实现出来的机器学习算法都是什么样子呢? 前两期线性回归及逻辑回归项目已发布(见文末链接),今天来讲讲BP神经网络。

BP神经网络

全部代码

https://github.com/lawlite19/MachineLearning_Python/blob/master/NeuralNetwok/NeuralNetwork.py

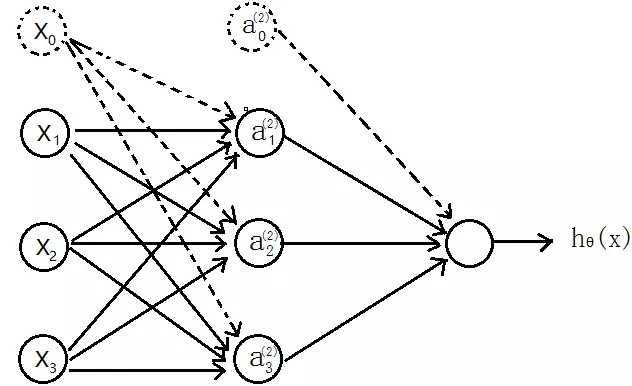

神经网络model

先介绍个三层的神经网络,如下图所示

输入层(input layer)有三个units(

为补上的bias,通常设为1)

表示第j层的第i个激励,也称为为单元unit

为第j层到第j+1层映射的权重矩阵,就是每条边的权重

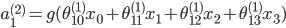

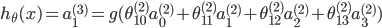

所以可以得到:

隐含层:

输出层

,

其中,S型函数

,也成为激励函数

可以看出

为3x4的矩阵,

为1x4的矩阵

==》j+1的单元数x(j层的单元数+1)

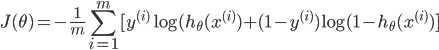

代价函数

假设最后输出的

,即代表输出层有K个单元

,

其中,

代表第i个单元输出与逻辑回归的代价函数

差不多,就是累加上每个输出(共有K个输出)

正则化

L-->所有层的个数<

本文详细介绍了如何使用Python实现BP神经网络,包括三层神经网络结构、代价函数、正则化、反向传播算法和梯度检查。通过实例代码展示了权重初始化、预测函数的实现,并提供了完整代码链接。

本文详细介绍了如何使用Python实现BP神经网络,包括三层神经网络结构、代价函数、正则化、反向传播算法和梯度检查。通过实例代码展示了权重初始化、预测函数的实现,并提供了完整代码链接。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3759

3759

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?