吴老师的支持向量机太难懂了(主要公式太多),转战StatQuest (Josh Starmer)这个更适合R语言,还有尤克里里的编曲听(虽然挺尬的吧。。)主要是通俗!易懂! 至少他开篇的黑体字title 写着Clearly Explained .......

支持向量机(support vector machine)(中英字幕)_哔哩哔哩 (゜-゜)つロ 干杯~-bilibiliwww.bilibili.com

- 一些可能不准确的先行理解:

- 线性可分linear separable: 在平面内存在这么一条能区分两个类别的直线(暂且叫做threshold)! 注意是直线,非线性需要了解核相关的知识 kernel

- margin: 算法的目的不是尽可能以低错误率去分类嘛?把这两组(对,仅在二元平面空间内讨论)看作离散点,分散到二元平面。margin作为两个类别的端口值到被区分的直线边界(threshold)的最短距离。【应该是对称的,也就是利用了什么拉格朗日还是什么对偶性之类的吧。】

- optimization: threshold 位于margin 的中间位置时可以保证margin最大。

- 这个threshold 应该是一个可以灵活延展的这么一个边界线。(给我的直观可视感受就很像confidence band 也就是不再拘泥于一个根据cost function + regularization 实现的最优固定分类,支持向量机给了一个可活动的范围区间?)

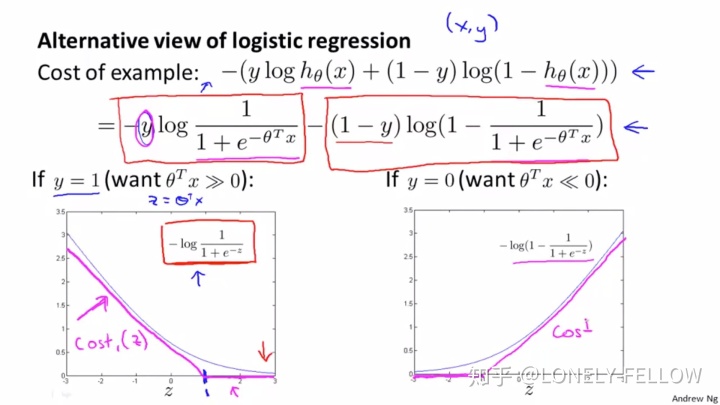

- 写法不一样,都是针对二元逻辑回归的分类,支持向量机更注重前面的cost 所以把log(hθ(x)) 写成 cost 的形式。【这里还是得找一下吴老师】

逻辑回归的sigmoid 函数:

if y=1,

if y=0,

支持向量机进行改写,把原式中的

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?