@TOC

<hr style=" border:solid; width:100px; height:1px;" color=#000000 size=1">

1.问题解决:pycharm debug断点调试时遇到Pycharm DataLoader会卡死(num_works参数 多进程的坑点)

- 把DataLoader中的参数num_workers 设为 0即可

https://blog.csdn.net/qq_43827595/article/details/113187052

<hr style=" border:solid; width:100px; height:1px;" color=#000000 size=1">

2.pycharm 进行远程服务器代码的编写与调试

参考链接: https://www.cnblogs.com/superjn/p/8624605.html

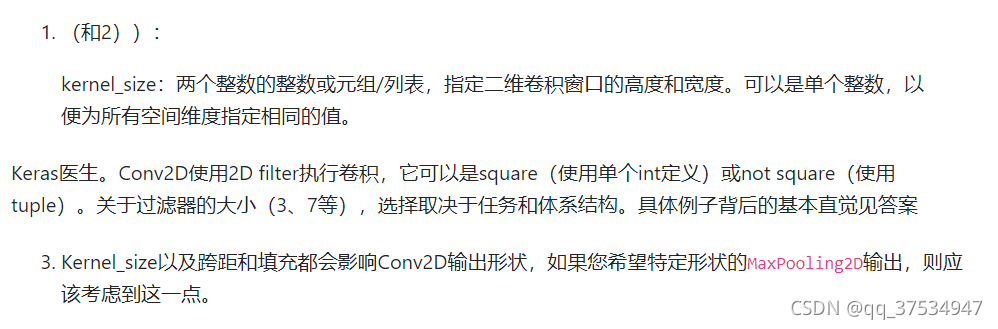

3.使用Conv2D时,内核大小可能是1或2个尺寸,以及原因是什么?

https://blog.csdn.net/qq_26369907/article/details/88366147

https://www.5axxw.com/questions/content/815xpy

4.Pytorch中contiguous()函数理解

- 在pytorch中,只有很少几个操作是不改变tensor的内容本身,而只是重新定义下标与元素的对应关系的。换句话说,这种操作不进行数据拷贝和数据的改变,变的是元数据。

- 就是深拷贝,而已。

https://blog.csdn.net/kdongyi/article/details/108180250

5.3x3xc卷积的每个通道的九个参数一样吗?

- 不一样

https://zhuanlan.zhihu.com/p/251068800

6.nn.conv1d?

- nn.Conv1d(in_channels,out_channels,kernel_size,stride,padding,dilation,groups,bias) 一维卷积,这里的一维不仅代表在一个维度上进行卷积,而且代表卷积的方向为一维 接口内的参数:

- in_channels:NLP任务中代表词向量的维度

- out_channels:卷积产生的通道数,out_channels==卷积核的数量

- kernel_size:卷积核尺寸,卷积核大小==(k,in_channels),这里卷积核的第二维度等于-in_channels

- padding:输入的每一条边,补充0的层数

注:输入-B,C,N ;输出-B,C2,N

参考链接: https://blog.csdn.net/weixin_38664232/article/details/104464247

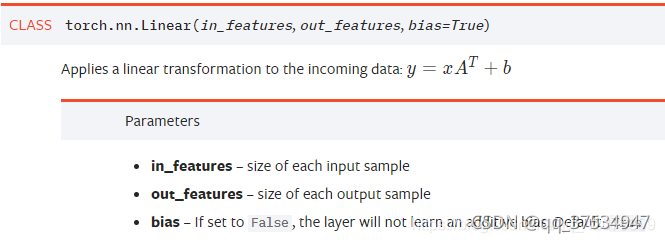

7.PyTorch的nn.Linear()

PyTorch的nn.Linear()是用于设置网络中的全连接层的,需要注意在二维图像处理的任务中,全连接层的输入与输出一般都设置为二维张量,形状通常为[batch_size, size],不同于卷积层要求输入输出是四维张量。其用法与形参说明如下:

in_features指的是输入的二维张量的大小,即输入的[batch_size, size]中的size。out_features指的是输出的二维张量的大小,即输出的二维张量的形状为[batch_size,output_size],当然,它也代表了该全连接层的神经元个数。从输入输出的张量的shape角度来理解,相当于一个输入为[batch_size, in_features]的张量变换成了[batch_size, out_features]的输出张量。

原文: https://blog.csdn.net/qq_42079689/article/details/102873766

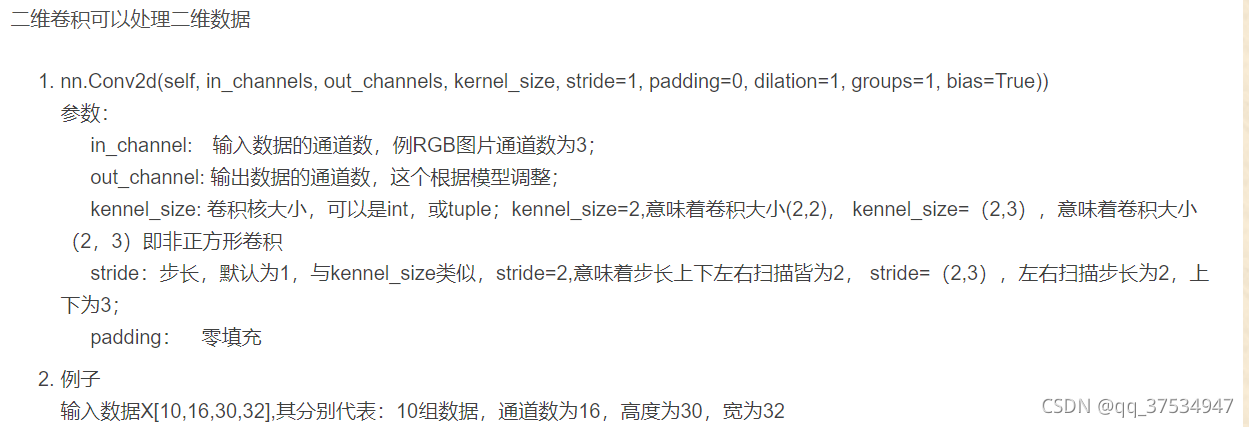

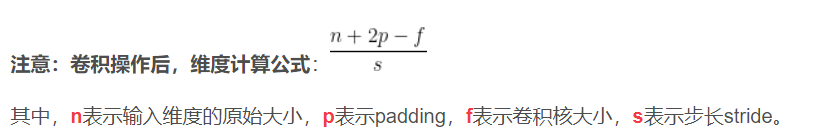

8.nn.conv2d?

nn.Conv2d(in_channels,out_channels,kernel_size,stride=1,padding=0,dilation=1,groups=1,bias=True)- 输入和输出格式: https://blog.csdn.net/bigFatCat_Tom/article/details/91619977

9.pytorch中BatchNorm1d、BatchNorm2d?

- nn.BatchNorm1d(num_features)-----注意第二维操作

- nn.BatchNorm2d(num_features)----注意第二维

参考: https://www.jianshu.com/p/6358d261ade8

10.pytorch topk 保持维度和位置 置零,实现mask功能?

输出是:

https://blog.csdn.net/weixin_37763484/article/details/114109148

11.PyTorch——自注意力(self-attention)机制实现(代码详解)

https://blog.csdn.net/beilizhang/article/details/115282604

12.with torch.no_grad() 减少显存

模型训练的时候,爆显存了,可以调整batch,对数据进行crop等等操作。今天发现一个模型,训练ok,每次测试的时候爆显存。开始以为是因为用了全图(1920x1080略大)进行inference,这是一方面。但后来发现忘了用with torch.no_grad():这导致模型运算的时候不能释放显存(记录了梯度信息),所以显存巨大。加了之后,用了不过3G显存就够了。确实inference不需要那么多显存的,以后记着这种不正常现象如何处理。

一般训练不爆显存,测试也不会爆;训练时的显存占用远多于inference 注:验证集和测试集都要!!!!!!!!

- 修改前

- 修改后:

https://www.jianshu.com/p/e8b9c59274a7 https://wstchhwp.blog.csdn.net/article/details/108405102?spm=1001.2101.3001.6650.5&utm_medium=distribute.pc_relevant.none-task-blog-2%7Edefault%7EBlogCommendFromBaidu%7Edefault-5.no_search_link&depth_1-utm_source=distribute.pc_relevant.none-task-blog-2%7Edefault%7EBlogCommendFromBaidu%7Edefault-5.no_search_link

13.实时监控GPU显存

14.torch.manual_seed(seed) → torch._C.Generator

- 参数seed (int) – CPU生成随机数的种子。取值范围为[-0x8000000000000000, 0xffffffffffffffff],十进制是[-9223372036854775808, 18446744073709551615],超出该范围将触发RuntimeError报错

- 返回返回一个torch.Generator对象。

- 示例(设置随机种子)

每次运行test.py的输出结果都是一样:

- 示例(没有设置随机种子)

每次运行test.py的输出结果都不相同:

15.numpy.amin

- 结果为每一行的最小值,可以使得所有值为正

16.valueError: Unable to determine SOCKS version from socks://127.0.0.1:1080/”

在终端中输入:

17.linux下conda安装opencv?

- 比较坑的一点:conda install opencv,安装成功了,但是import cv2一直失败,查看conda list,确实安装了3.4.1版本,虚拟环境:python=3.6

- 解决:重新创建虚拟环境,python=3.7,然后conda install opencv即可,默认版本3.4.2

- 注:原来是python版本导致的,或者3.4.1版本导致的

18.python语法...

- ...的使用

- 注:可见是从不同的维度上选数据。 https://blog.csdn.net/weixin_39630106/article/details/109930171

19.visio插入数学公式

- 1.打开word,插入数学公式

- 2.复制

- 3.在visio中右击---选择性黏贴---Microsoft word文档

- 4.最后还可使用Ctrl+G将框图和公式组合到一起,这样移动时两个一起移动,更方便些。

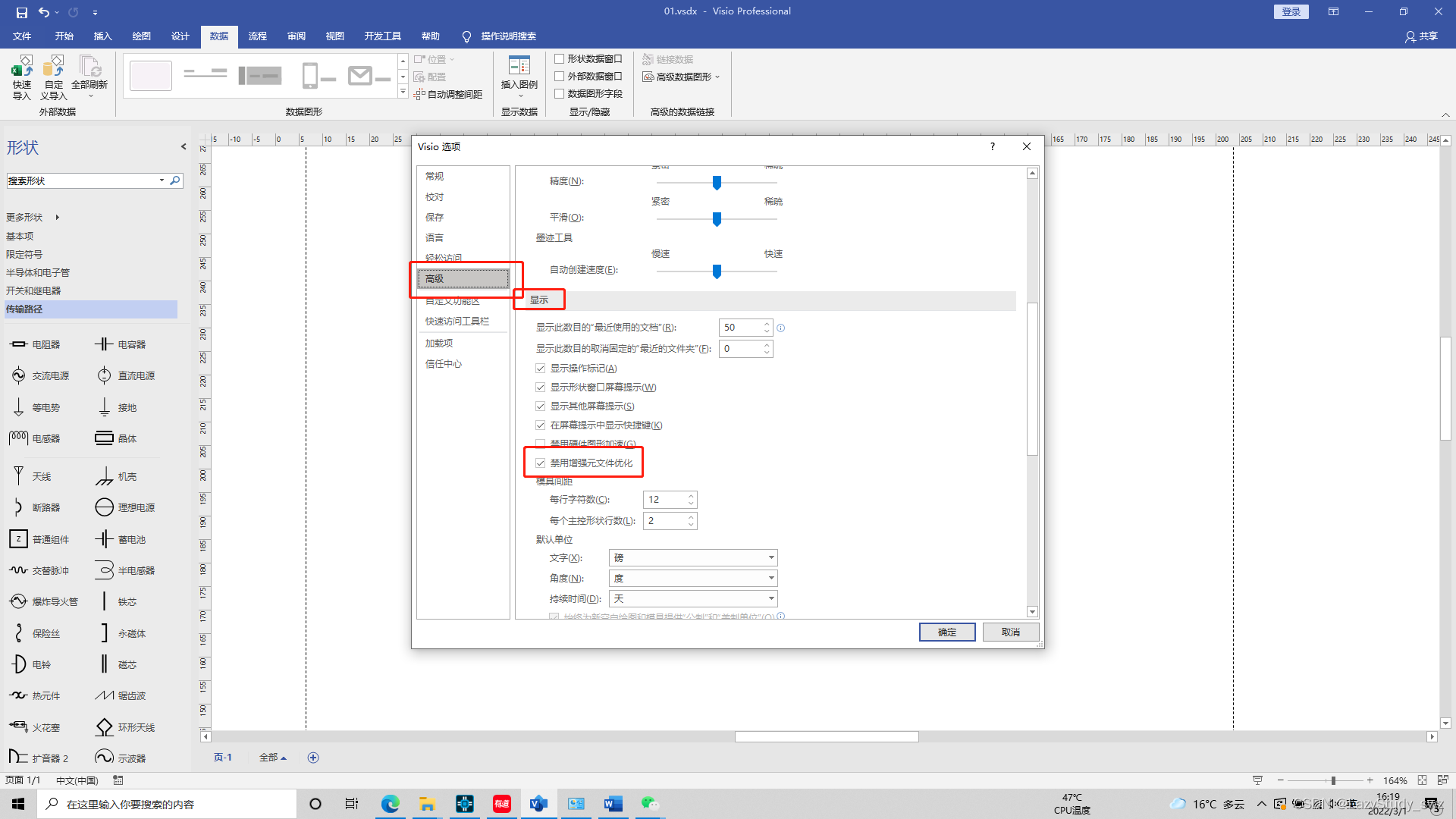

19.1 将word中编辑好的公式复制到Visio中出现乱码问题?

在Visio(点击 选项 --> 高级 --> 显示 ->勾选禁用增强元文件优化)

20.SharedArray.create 导致 tmpfs 100%

/dev/shm 默认大小为物理内存的一半,如果需要调整大小,可以修改 /etc/fstab

sudo -i passwordvi /etc/fstab

最后重启即可,然后利用df -lh命令查看

https://blog.csdn.net/ctypyb2002/article/details/107914643

21.pytorch计算flops和paramas

1、安装Thop

2、代码使用1)直接输出

这样的直接输出会让数据可比较性很弱,还需要自己转化单位【有点麻烦,不太推荐!】

2)使用thop.clever_format

加上这样简单的一句话后,真的输入结果看上去太舒服了。

原文链接: https://blog.csdn.net/qq_37844044/article/details/119644941

22.PyCharm远程运行调试代码

https://zhuanlan.zhihu.com/p/38591832

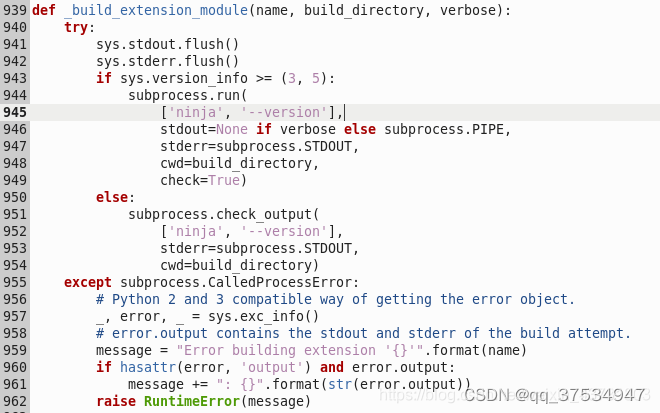

23.subprocess.CalledProcessError: Command '['ninja', '-v']' returned non-zero exit status 1.

问题:

解决:.../lib/python3.6/site-packages/torch/utils/cpp_extension.py

即:-v 改成 --version 注:vim快速定位:/'ninja'

24.torch.nn.CrossEntropyLoss()

https://zhuanlan.zhihu.com/p/159477597

25.F.cross_entropy()

https://blog.csdn.net/wuliBob/article/details/104119616

26.pytorch|optimizer与学习率

https://lhyxx.top/2020/02/11/pytorch-optimizer%E4%B8%8E%E5%AD%A6%E4%B9%A0%E7%8E%87/

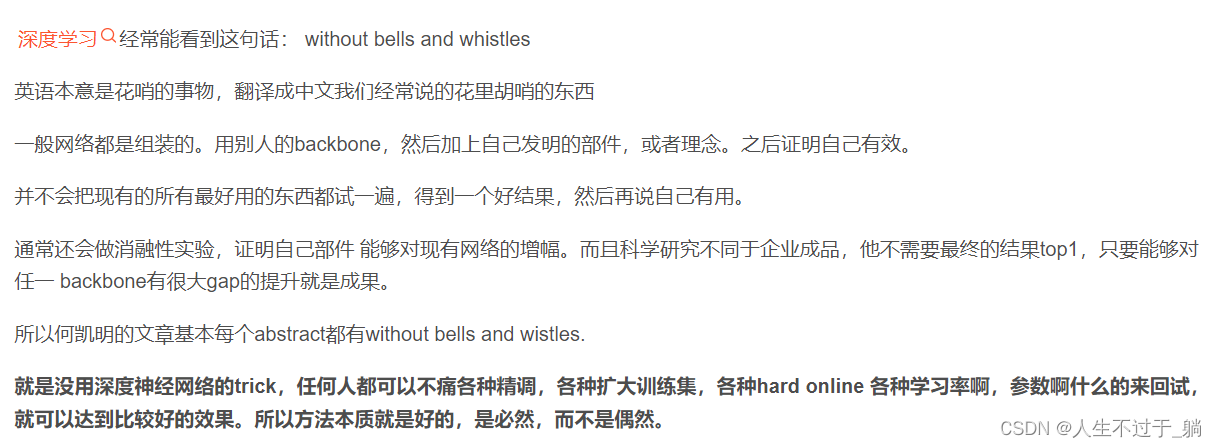

27.without bells and whistles 深度学习

https://blog.csdn.net/u013249853/article/details/84786730

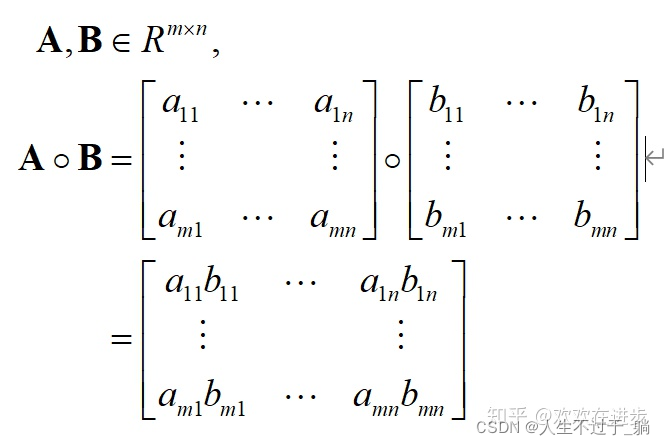

28.element-wise product = element-wise multiplication = Hadamard product?

含义:两个矩阵对应位置元素进行乘积

https://www.zhihu.com/question/432693995

29.迁移anaconda虚拟环境到新服务器+解决迁移后pip无法使用

- 迁移anaconda虚拟环境到新服务器如果你有一个台机A不能联网,另一台机B可以联网,但需要在不能联网的A上运行代码,需要一些库。那么可以在A上离线安装Anaconda,在B上配置上虚拟环境,移动到A上。

- 安装Ananconda,官网下载安装包,ssh传到A上并安装,同时B也应该安装好,两机anaconda安装包无需一致,但需要同类系统(Linux or Win)。

- 在B上创建虚拟环境

py36(取名随意),在虚拟环境中安装需要的库。 - 前往B的anaconda目录,找到

envs文件夹,对py36文件夹进行压缩。tar -czvf py36.tar.gz py3将压缩包传输到A,解压,放至anaconda/envs目录下。

- 解决迁移后pip无法使用这一步完成后,基本上你需要的库都安装在A机上了,但是!如果你又加上了其他的项目,有1,2个库需要安装怎么办呢?

- 先使用

pip download <package_names>,在有网络的机子(B)上下载,库安装包,然后上传到A上。 - 比如

opencv,pip download opencv-python,得到文件opencv_python-4.2.0.32-cp36-cp36m-manylinux1_x86_64.whl上传至A。 - 这时在A上切换虚拟环境,

pip install opencv_python-4.2.0.32-cp36-cp36m-manylinux1_x86_64.whl进行安装。 - 这里会报一个错误

-bash: /home/computer_a/anaconda3/envs/torch/bin/pip: /home/computer_b/anaconda3/envs/torch/bin/python: bad interpreter: No such file or directory。这是因为A机的pip路径是拷贝过来的,还是原来B机的python路径,修改即可。 - 方法:打开

/home/computer_a/anaconda3/envs/torch/bin/pip,将第一行路径改为/home/computer_b/anaconda3/envs/torch/bin/python。

原文链接: https://blog.csdn.net/weixin_44633882/article/details/105308120

30.pip install 时报错 ERROR: Could not install packages due to an EnvironmentError: [WinError 5] 拒绝访问?

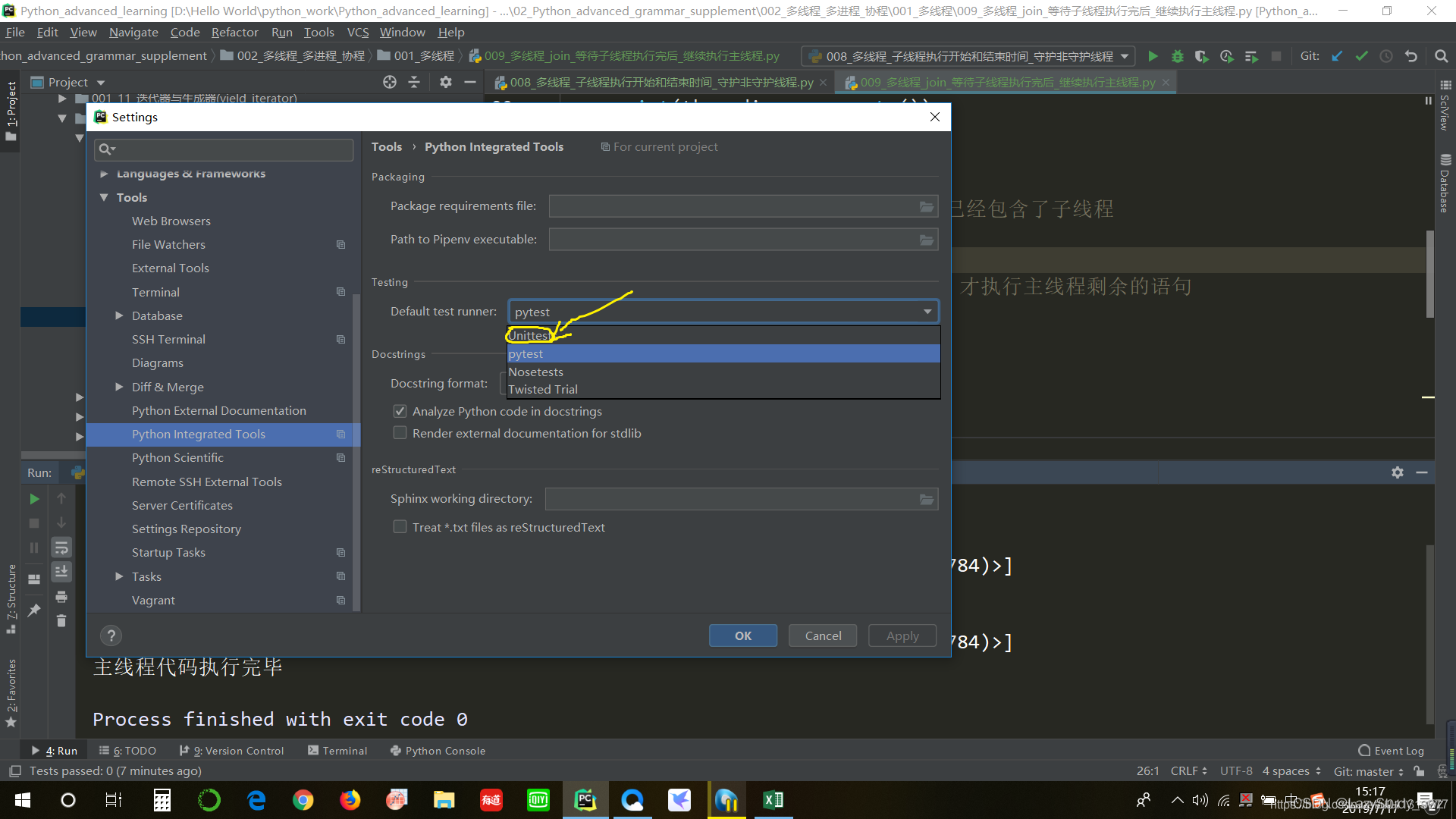

31.Pycharm退出pytest模式(run pytest in模式)?

1.方法1:

要退出这种模式,

- 第一步:点击顶部运行键——选择‘Edit configuration’,

- 第二步:可以看到左侧Python下有两个文件夹,如果进入了test模式,就会有‘Python test’一栏,

- 第三步:选定Python test,这时点击上面的‘-’号去掉这栏下的文件即可。

- 然后确定,再次右键代码,就可以执行run模式了

2.方法二

可以进入 File-settings-tools-python integrated tools里面修改,选择unittest修改后记得应用一下参考下图:

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?