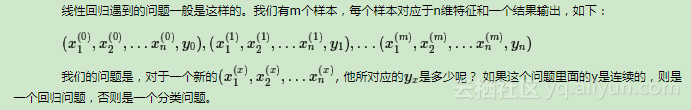

一,线性模型描述

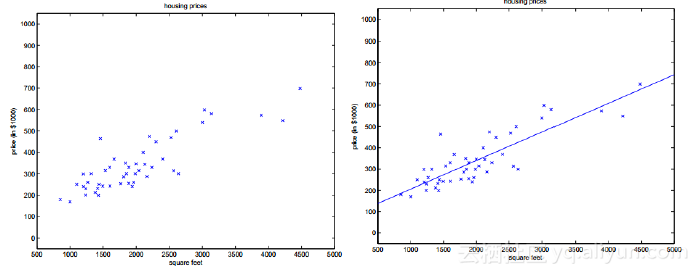

简单线性回归如:

y= ax+b

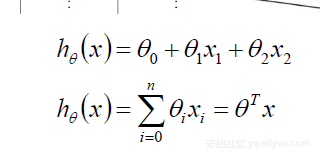

对于多变量的情形

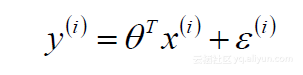

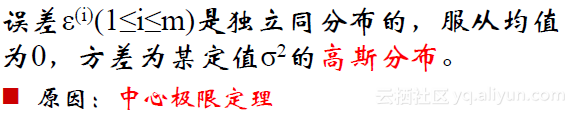

通常,通过机器学习训练模型计算的值和真实值可能存在一定的误差:

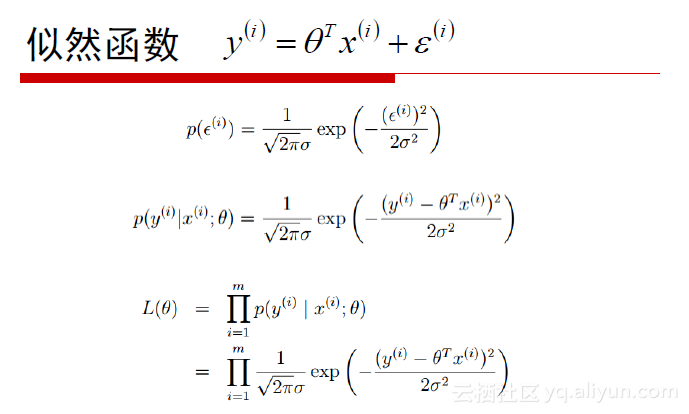

因此,我们使用最大似然估计就可以得到损失函数:

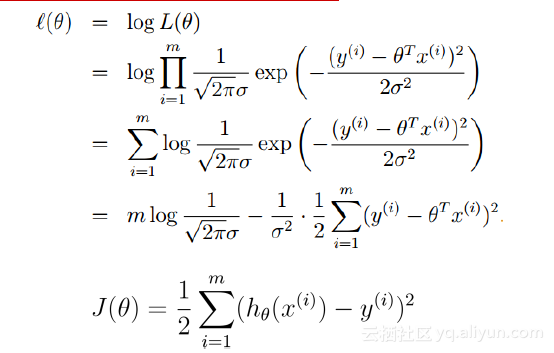

利用高斯的对数似然化简:

致此,我们就得到了损失函数。

通常,我们想要使我们的目标函数值最小,这样我们模型预测的值就更加精确。

二,梯度下降和最小二乘法

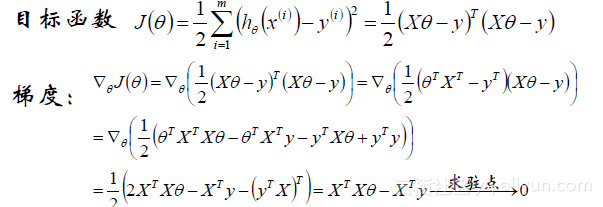

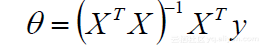

1.最小二乘法:

在目标函数的导数为零的点为极值点,

得到:

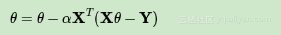

2.梯度下降:

梯度下降又分为批量梯度下降和随机梯度下降,二者的区别在于,批量梯度下降是对全样本量的迭代,而随机梯度下降是单个样本下降迭代。

三,线性回归过拟合和正则项

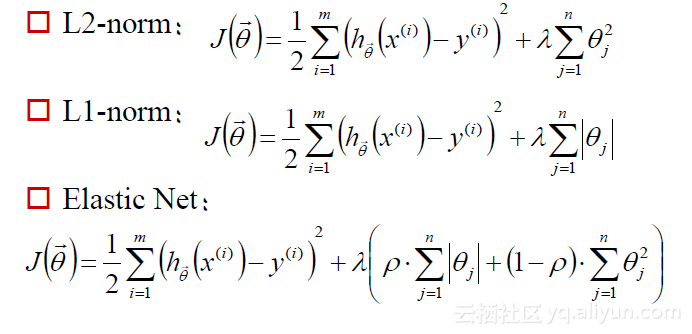

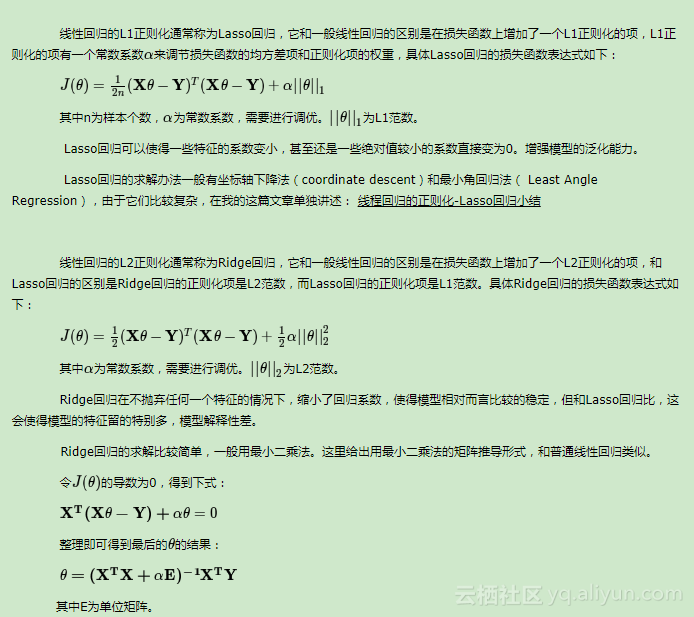

在我们的模型训练过程中,可能存在在模型训练时产生的效果很好,但在应用中可能得不到我们想法的效果,可能存在模型过拟合的情况,为了避免过拟合的发生,我们在目标函数中添加一个正则项。

通常,我们有多种拟合方式,以下列举3种,

第三种则集中了前两者的优点。

参考:

刘建平Pinard:http://www.cnblogs.com/pinard/p/6004041.html

邹博:机器学习PPT

5076

5076

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?