本文机器学习的学习总结,讲解单变量线性回归模型。

线性回归——模型描述

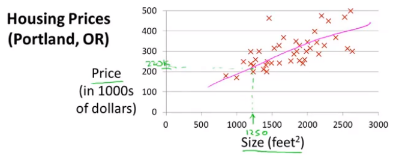

同样是监督学习中的第一个例子-房屋价格预测:

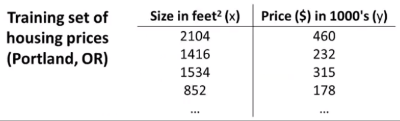

图中的训练集如下:

接下来我们定义一些符号,方便今后的学习:

- m m m:训练样本的个数;

- x x x:输入变量/特征

- y y y:输出变量/目标变量

其中, ( x , y ) (x,y) (x,y) 代表了一个训练样本, ( x ( i ) , y ( i ) ) (x^{(i)},y^{(i)}) (x(i),y(i)) 表示第 i i i 个训练样本。例如 x ( 1 ) = 2104 x^{(1)}=2104 x(1)=2104。

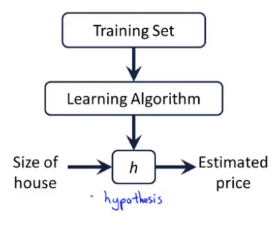

我们对训练集使用学习算法:

其中 h h h 为假设函数(该名称是历史原因,不要过分纠结),我们输入房子大小,通过 h h h 函数映射为预估价格。在以后的文章中,我们将 h h h 表示为 h θ ( x ) = θ 0 + θ 1 x h_θ(x)=θ_0+θ_1x hθ(x)=θ0+θ1x (其中 θ 0 , θ 1 θ_0,θ_1 θ0,θ1 为模型参数,其实就是我们初中数学中的 y = k x + b y=kx+b y=kx+b),等式左边可简写为 h ( x ) h(x) h(x)。函数的作用是预测 y y y 是关于 x x x 的线性函数。

我们首先通过学习线性拟合,进而学习更加复杂的模型。这里的例子是一个一元线性回归,也称为单变量线性回归。

代价函数

在定义代价函数前,我们先明确我们的目标。我们的目标是选择合适的 θ 0 , θ 1 θ_0,θ_1 θ0,θ1,使得训练集中的假设函数 h ( x ) h(x) h(x) 尽可能接近实际值 y y y。我们给出标准定义:在线性回归中,我们要求解一个最小化问题:

min θ 0 , θ 1 1 2 m ∑ i = 1 m ( h θ ( x ( i ) ) − y ( i ) ) 2 \min_{θ_0,θ_1}\frac{1}{2m}\sum_{i=1}^m(h_θ(x^{(i)})-y^{(i)})^2 θ0,θ1min2m1i=1∑m(hθ(x(i))−y(i))2

换句话说,我们要尽可能减小预测值和实际值的差的平方误差和,我们实际要考虑的是这个值的 1 2 m \frac{1}{2m} 2m1。我们对其进行重写:

J ( θ 0 , θ 1 ) = 1 2 m ∑ i = 1 m ( h θ ( x ( i ) ) − y ( i ) ) 2 J(θ_0,θ_1)=\frac{1}{2m}\sum_{i=1}^m(h_θ(x^{(i)})-y^{(i)})^2 J(θ0,θ1)=2m1i=1∑m(hθ(x(i))−y(i))2

min θ 0 , θ 1 J ( θ 0 , θ 1 ) \min_{θ_0,θ_1}J(θ_0,θ_1) θ0,θ1minJ(θ0

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

423

423

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?