最近复现Neural Process时,发现网上复现代码里对图像补全这样的回归问题竟然用的是伯努利分布的交叉熵,又一次百思不得其解。今天学习cs230看了logistic回归时反向传播的导数推导,终于想明白了。感觉可以增加对这两个loss的理解,给大家分享一下。

一般的回归例子中,没有对y的值域作任何限制,也就是

1.均方误差的缺点

图像补全问题也是一个回归问题,这时的已知和待预测数据(x,y)均为(像素2D位置,intensity)。但此时intensity的值域是一个有界闭集,比如预处理Mnist数据集时,常将图片每个像素intensity值域约束至[0,1]。

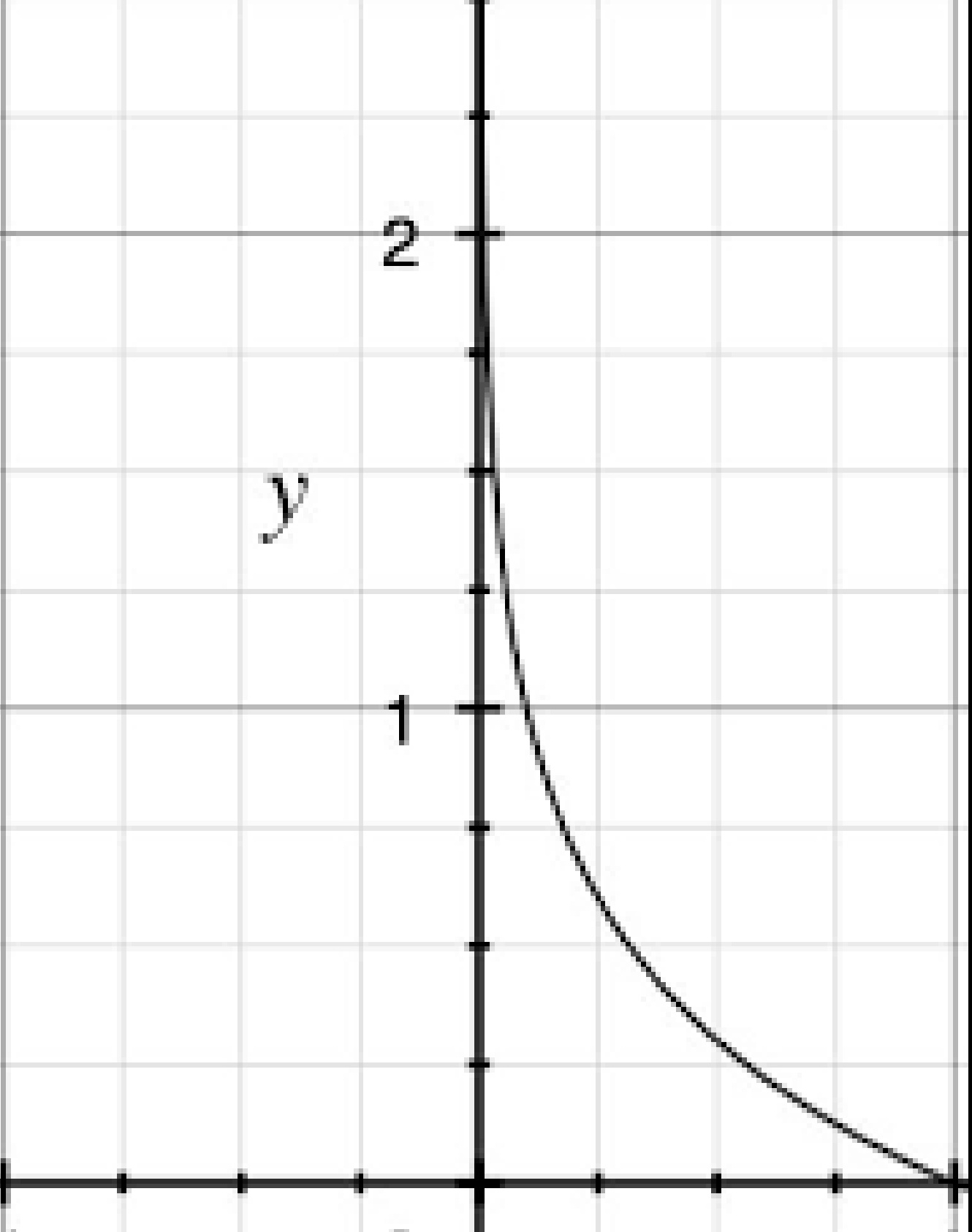

此时,若对图像作补全预测,那么预测值也必须落入[0,1]中,所以一般在神经网络最后一层加一层sigmoid函数,而这导致了如下问题。

假设x为待预测的像素点坐标,以其为输入得到该点像素的intensity预测值。

假设神经网络计算图为

1.

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

6万+

6万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?