本文由码农场同步,最新版本请查看原文:http://www.hankcs.com/ml/hinton-deep-neural-nets-with-generative-pre-training.html

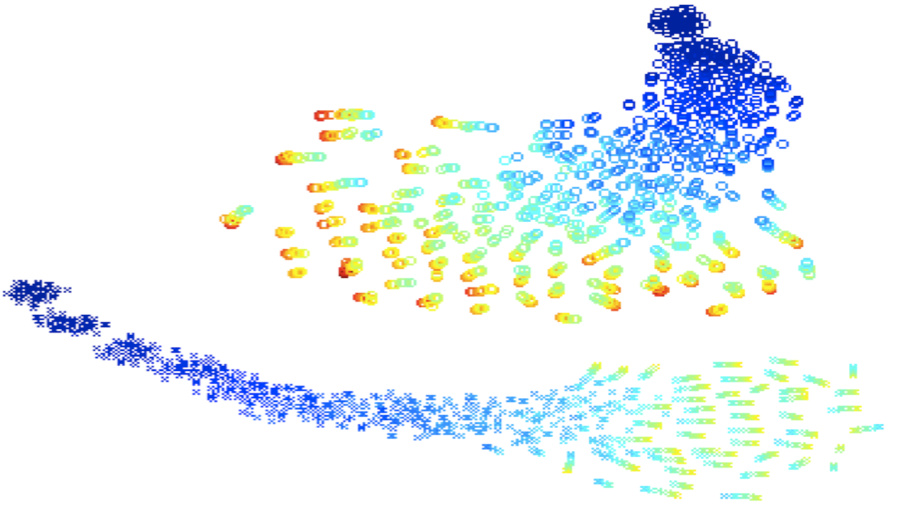

这节课介绍另一种训练sigmoid belief net的方法,这种方法的发明可谓无心之举。Hinton放弃了sigmoid belief net之后又回到了玻尔兹曼机的研究,发现RBM的训练很高效。RBM可以学习一层非线性的特征,如果层叠多个RBM,则可以学习特征之间的关系。那么问题就来了,这些RBM组成的是多层RBM吗?Hinton手下一个聪明的研究生G.Y. Tay发现,得到的模型更加类似sigmoid belief net;真奇怪,通过放弃deep sigmoid belief net得到了训练de...

继续阅读:码农场 » Hinton神经网络公开课14 Deep neural nets with generative pre-training

原文链接:http://www.hankcs.com/ml/hinton-deep-neural-nets-with-generative-pre-training.html

84

84

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?