在统计学中,线性回归(Linear Regression)是利用称为线性回归方程的最小平方函数对一个或多个自变量和因变量之间关系进行建模的一种回归分析。这种函数是一个或多个称为回归系数的模型参数的线性组合。只有一个自变量的情况称为简单回归,大于一个自变量情况的叫做多元回归。

线性模型形式简单,易于建模,但却蕴含着机器学习中一些重要的基本思想,许多功能更为强大的非线性模型(nonlinear model)实际上就是在线性模型的基础上通过引入层级结构或高维映射而得。

一,一元线性回归

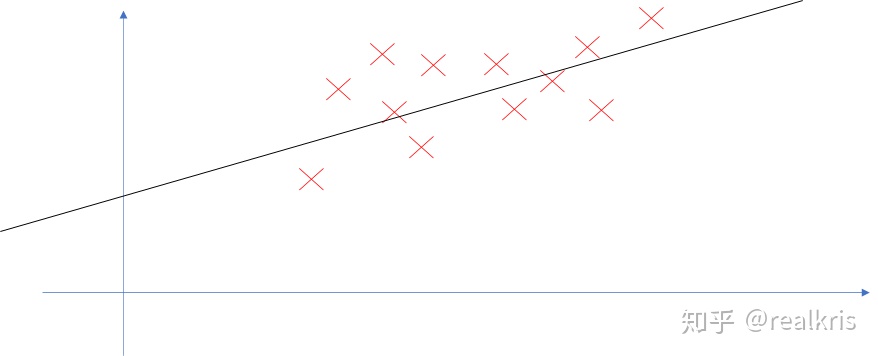

我画了一张图描述这个过程,给定数据集D = {(x1,y1),(x2,y2),......,(xm,ym)},其中xi=(xi1;xi2;...;xid),yi属于R。线性回归试图学得一个线性模型以尽可能准确地预测实值输出标记。(如图)

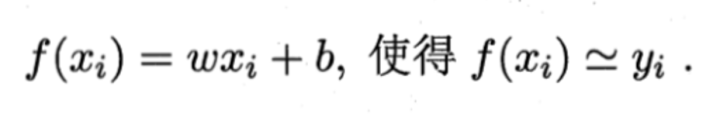

线性回归试图产生这样的模型:

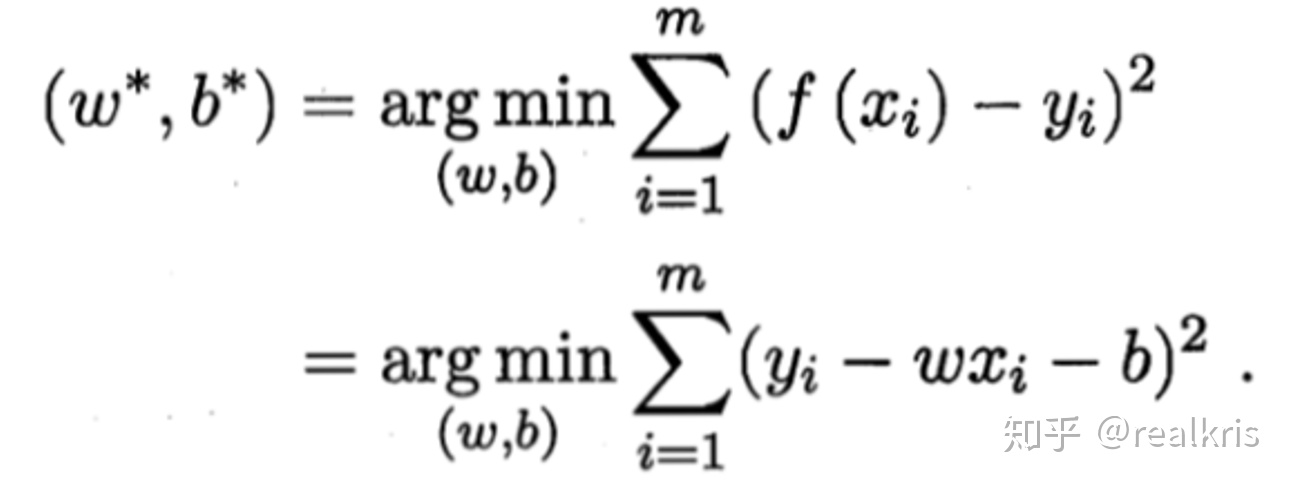

如何确定w和b?w和b的目的是最小化f(x)与y的差别,这里可以使用均方误差,即:

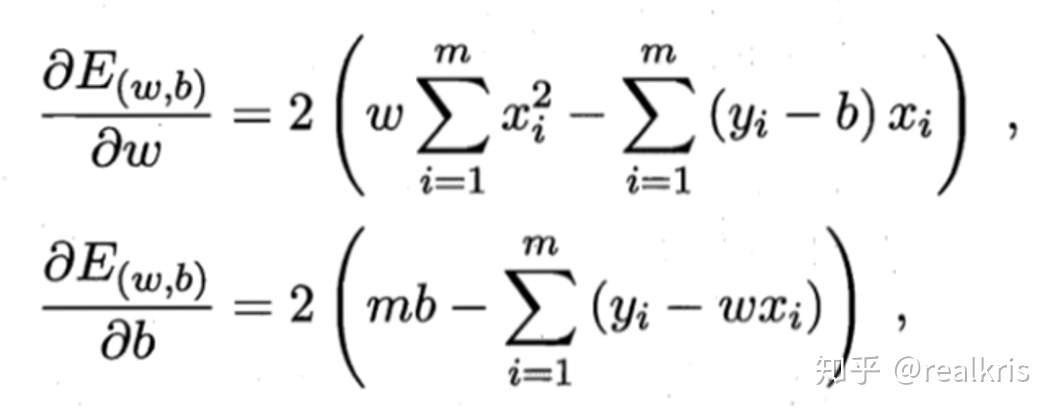

其中,线性回归就是指通过确定w和b使E(w,b)最小化的过程。这个过程称为线性回归模型的最小二乘参数估计。我们可将E(w,b)对w和b求导,得到

令两式为0可得到w和b最优解的闭式解:

这篇博客深入探讨了线性模型,从一元线性回归到多元线性回归,进一步阐述了对数线性回归的概念。文中详细解释了如何确定模型参数,通过最小二乘法进行估计,并介绍了广义线性模型、对数几率回归(逻辑回归)以及线性判别分析的基本原理和应用。

这篇博客深入探讨了线性模型,从一元线性回归到多元线性回归,进一步阐述了对数线性回归的概念。文中详细解释了如何确定模型参数,通过最小二乘法进行估计,并介绍了广义线性模型、对数几率回归(逻辑回归)以及线性判别分析的基本原理和应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1570

1570

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?