非原创,已表明出处,不是为了吸粉,仅仅是为了做笔记

——————————————————————————————————————

- 微信搜索:深度学习中的优化算法串讲

2. 微信搜索:详解深度学习中的常用优化算法

3. ZHOU-JC:从动量和矩的角度探讨优化理论的内涵(以动量法、AdaGrad和Adam举例)

4. 陈楠:深度模型优化算法SGD、Momentum、NAG、AdaGrad、RMSProp及Adam等

SGD缺点:

- 收敛速度慢

- 容易陷入局部最优

- 全局学习率

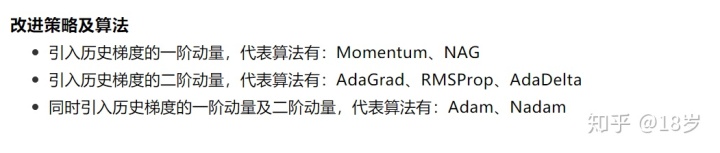

固定学习率的优化算法

SGD,Momentum,NAG

自适应学习率的优化算法

AdaGrad,Adam,Nadam

“自适应学习率”优化算法时代的到来。SGD及其变种以同样的学习率更新每个参数,但深度神经网络往往包含大量的参数,这些参数并不是总会用得到(想想大规模的embedding)。对于经常更新的参数,我们已经积累了大量关于它的知识,不希望被单个样本影响太大,希望学习速率慢一些;对于偶尔更新的参数,我们了解的信息太少,希望能从每个偶然出现的样本身上多学一些,即学习速率大一些。

1414

1414

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?