简介:本PPT课件详细介绍了《概率论与数理统计》这门在IT行业中至关重要的数学课程。内容覆盖了随机事件、概率、二项分布、条件概率、事件的关系与运算、期望与方差、大数定律与中心极限定理、分布理论、参数估计与假设检验以及回归分析与相关性等核心概念。掌握这些知识对于数据分析、机器学习、人工智能等领域的应用至关重要,能为IT专业人士在数据分析和建模方面提供坚实的理论基础。

1. 概率论与数理统计的理论基础

在现代数据分析中,概率论与数理统计是不可或缺的理论基础,它们为处理不确定性问题提供了强有力的数学工具。这一章节将首先介绍概率论与数理统计的基本概念,为后续章节中的深入讨论和应用奠定坚实基础。

1.1 概率论的基本原理

概率论是研究随机事件发生规律的数学分支。它提供了量化的手段来分析和预测那些本质上不可预测的事件。我们将从以下几个方面深入理解概率论的基本原理:

- 随机实验与样本空间: 随机实验是指在相同条件下,无法事先确定唯一结果的实验,其所有可能结果的集合构成样本空间。

- 随机事件: 随机实验中可能出现的一个或多个结果称为随机事件。

- 概率的定义: 概率用于量化事件发生的可能性,通常定义为特定事件发生的次数与所有可能情况次数的比值。

举例:掷一枚公平的硬币,硬币落地时正面朝上的事件称为一个随机事件。由于硬币有两面,因此该事件发生的概率为1/2。

1.2 数理统计的基本概念

数理统计则是应用概率论中的原理来收集、分析、解释数据的科学,它涉及到从数据中提取信息并作出统计推断的方法。为了有效地应用统计方法,我们需要了解以下基本概念:

- 总体与样本: 总体指的是研究对象的集合,而样本是从总体中抽取的一部分数据,用于代表或估计总体的特征。

- 统计量: 样本的一个函数,通常用于估计总体参数,例如样本均值和样本方差。

举例:假设我们想要研究某城市居民的平均月收入,那么该城市所有居民的收入总和构成总体,从其中抽取的若干居民收入数据则构成样本。通过计算样本均值,我们可以估计该城市居民的平均月收入。

通过本章的学习,读者将对概率论与数理统计的概念有初步的掌握,并为进一步学习更高级的主题打下坚实的理论基础。

2. 随机事件的概率运算与分析

2.1 随机事件的定义和分类

2.1.1 基本概念:样本空间、随机事件、基本事件

随机事件是在一定条件下可能发生也可能不发生的事件,而概率论就是研究随机事件发生规律的数学分支。在讨论随机事件之前,我们必须首先了解几个基本概念:样本空间、随机事件以及基本事件。

样本空间(Sample Space) ,通常表示为Ω,是所有可能结果的集合。在抛掷一枚硬币的实验中,样本空间可能是{正面, 反面}。在掷一个六面骰子的实验中,样本空间将是{1, 2, 3, 4, 5, 6}。

随机事件(Random Event) 是从样本空间中选取的,可能发生也可能不发生的一个或一组结果。它表示为样本空间的子集。例如,掷骰子出现偶数点可以视为一个随机事件。

基本事件(Elementary Event) 是样本空间中不能被继续分割的最小事件单位。在抛硬币的例子中,每个可能的结果(正面或反面)就是一个基本事件。

2.1.2 随机事件的概率及其性质

随机事件发生的可能性称为概率。概率是0到1之间的一个实数,其中0表示事件绝对不会发生,而1表示事件肯定会发生。概率的性质对分析随机事件至关重要:

- 非负性 :任何事件的概率都不小于0。

- 规范性 :必然事件的概率为1。

- 有限可加性 :如果两个事件A和B互斥(即同时发生的概率为0),那么事件A或B发生的概率等于A和B各自概率的和。

2.2 概率的计算方法

2.2.1 古典概率模型与加法原理

古典概率模型适用于当所有基本事件出现的可能性相等时。比如,掷一个公平的六面骰子,每个面朝上的概率都是1/6。

加法原理(Addition Principle) 指出,若事件A和事件B互斥,那么事件A或B发生的概率等于A和B各自概率的和,即 P(A∪B) = P(A) + P(B)。

2.2.2 几何概率的计算与应用

几何概率是指事件发生区域相对于整个可能区域的度量比。它常常用于处理连续空间的问题,比如在一条线段上随机选点。计算几何概率时,关键是确定所关心的事件所占的比例。

2.2.3 条件概率与乘法法则

当我们想知道一个事件在另一个事件发生的条件下发生的可能性时,我们使用 条件概率 。 条件概率 表示为 P(A|B),是事件A在事件B发生的条件下发生的概率。 乘法法则 (Multiplication Rule)指出,两个事件同时发生的概率等于事件A的概率乘以在事件A发生的条件下事件B发生的概率,即 P(A∩B) = P(A)P(B|A)。

为了说明这些概念,考虑以下例子:一个盒子中装有5个红色球和3个蓝色球,我们随机抽取两个球,计算两次都抽到红球的概率。

- 首先计算第一次抽取是红球的概率:P(Red1) = 5/8。

- 抽出一个红球之后,盒子里剩下4个红球和3个蓝球,因此第二次抽到红球的概率是 P(Red2|Red1) = 4/7。

- 两次抽取都是红球的联合概率是:P(Red1 ∩ Red2) = P(Red1) * P(Red2|Red1) = (5/8) * (4/7)。

这个简单的例子说明了古典概率模型和乘法法则的应用。

对于计算概率,重要的是确定事件类型并选择正确的概率模型或原理来应用。对于涉及多步骤的复杂事件,常常需要组合使用这些基本法则和概念。

下一章节将介绍概率分布及其性质,它在理解随机变量行为方面发挥着重要作用。我们将探讨离散型和连续型随机变量的概率分布以及它们的性质。

3. 概率分布及其性质

在信息技术飞速发展的今天,概率分布是数据分析、机器学习和统计推断中不可或缺的理论基础。它帮助我们理解和预测随机事件在不同条件下的表现,从而做出更加科学的决策。本章节将深入探讨离散型和连续型随机变量的概率分布,以及它们在实际应用中的性质和意义。

3.1 离散型随机变量的概率分布

随机变量是概率论中的基础概念,它可以是离散的,也可以是连续的。离散型随机变量的概率分布通过概率质量函数(probability mass function, PMF)来描述。概率质量函数给出了每个可能结果发生的概率。

3.1.1 二项分布的概率质量函数和性质

二项分布是离散概率分布中非常重要的一个,它描述了在固定次数的独立实验中,成功次数的概率分布情况。二项分布有两个参数:实验次数 ( n ) 和单次实验的成功概率 ( p )。

二项分布的PMF表达式如下:

[ P(X=k) = \binom{n}{k} p^k (1-p)^{n-k} ] 其中,( \binom{n}{k} ) 表示二项式系数,( P(X=k) ) 表示恰好成功 ( k ) 次的概率。

二项分布具有以下性质: - 它是对称的,如果 ( p = 0.5 )。 - 它是偏斜的,如果 ( p \neq 0.5 ),偏向 ( n \cdot p ) 的值。 - 当 ( n ) 增加时,它趋于正态分布(中心极限定理)。

示例代码:计算二项分布的概率质量函数

from scipy.stats import binom

# 设定二项分布的参数

n, p = 10, 0.5

# 创建二项分布对象

b = binom(n, p)

# 计算恰有k次成功的概率

k = 6

prob = b.pmf(k)

print(f"二项分布中,n={n}, p={p}时,恰有{k}次成功的概率为:{prob}")

参数说明:

-

n:实验次数,必须是正整数。 -

p:每次实验成功的概率,必须在0和1之间。 -

k:想要计算概率的成功次数。

执行逻辑说明:

上述代码导入了 scipy.stats 模块中的二项分布函数,并设定了 n=10 和 p=0.5 。使用 b.pmf(k) 计算了恰好6次成功的概率。

3.1.2 几何分布与泊松分布的特性分析

几何分布和泊松分布也是分析离散随机变量时常见的分布类型。

几何分布

描述了进行一系列独立实验,直到第一个成功发生时,进行实验的次数的概率分布。它只有一个参数:成功概率 ( p )。

几何分布的PMF表达式为:

[ P(X=k) = (1-p)^{k-1}p ] 其中,( P(X=k) ) 是第 ( k ) 次实验成功时的概率。

泊松分布

用于描述在一定时间或空间内随机事件发生次数的概率分布,适用于描述罕见事件的概率模型。其参数是事件在单位时间或单位空间内发生次数的期望值 ( \lambda )。

泊松分布的PMF表达式为:

[ P(X=k) = \frac{\lambda^k e^{-\lambda}}{k!} ] 其中,( k ) 是在给定的时间或空间内,事件发生的次数。

3.2 连续型随机变量的概率密度函数

连续型随机变量的概率分布通过概率密度函数(probability density function, PDF)来描述。概率密度函数表示变量取值在某个范围内的概率密度。

3.2.1 均匀分布与正态分布的概率密度解析

均匀分布 :连续随机变量在一个闭区间内的取值是等可能的。它的两个参数是区间的下限 ( a ) 和上限 ( b )。

均匀分布的PDF表达式为:

[ f(x) = \frac{1}{b-a} ] 其中,( a \leq x \leq b ),且 ( f(x) ) 在此区间内是一个常数。

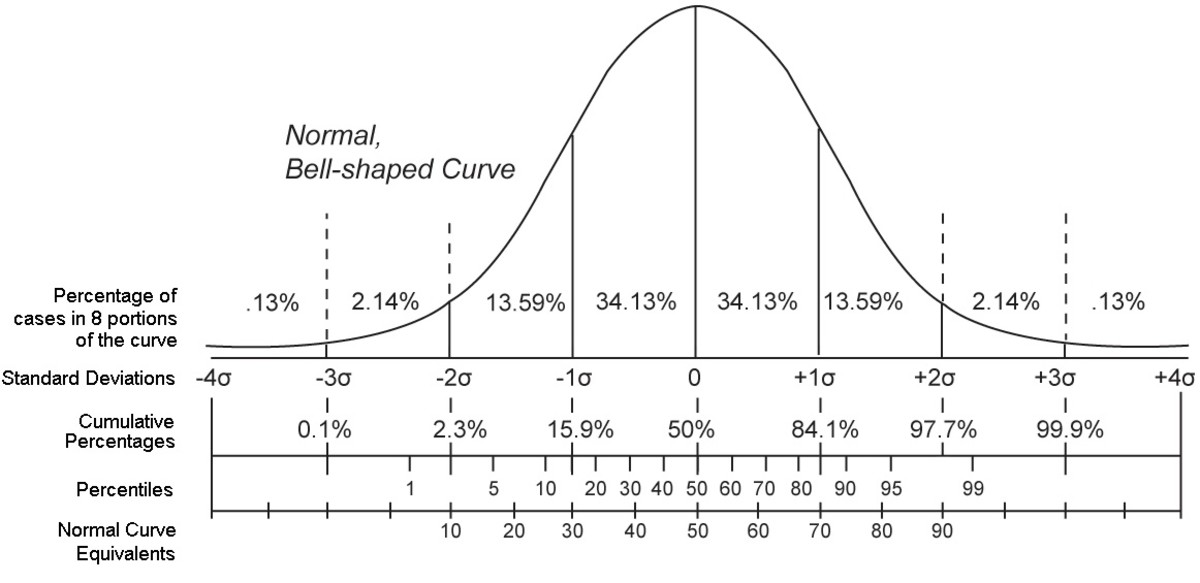

正态分布 :是连续分布中最著名的分布之一,也被称为高斯分布。其形状呈现为对称的钟形曲线,广泛应用于自然和社会科学领域。

正态分布的PDF表达式为:

[ f(x) = \frac{1}{\sigma \sqrt{2\pi}} e^{-\frac{(x-\mu)^2}{2\sigma^2}} ] 其中,( \mu ) 是均值,( \sigma ) 是标准差,( f(x) ) 在 ( x ) 处的值给出了 ( x ) 在其周围附近取值的概率密度。

3.2.2 概率密度函数的计算与图形表示

通过Python的matplotlib库可以很方便地绘制出连续随机变量的概率密度函数图像,以直观地展示变量的概率分布情况。

import numpy as np

import matplotlib.pyplot as plt

from scipy.stats import norm

# 设置正态分布参数

mu, sigma = 0, 0.1

x = np.linspace(mu - 4*sigma, mu + 4*sigma, 1000)

p = norm.pdf(x, mu, sigma)

# 绘制正态分布概率密度函数图

plt.plot(x, p)

plt.title('Normal Distribution PDF')

plt.xlabel('x')

plt.ylabel('Probability Density')

plt.grid(True)

plt.show()

参数说明:

-

mu:正态分布的均值,影响曲线的中心位置。 -

sigma:正态分布的标准差,影响曲线的宽度和高度。 -

x:绘制概率密度函数时,用于生成曲线的x轴坐标点。

执行逻辑说明:

以上代码首先定义了正态分布的均值和标准差,然后生成了表示x轴的点,并使用正态分布的概率密度函数 norm.pdf() 计算了这些点的概率密度。最后,使用matplotlib库绘制出概率密度函数图。通过此图可以直观地看到正态分布的对称性以及均值和标准差对曲线形状的影响。

4. 统计推断与概率模型

统计推断是数据科学中的一个重要领域,其主要目的是根据样本数据对总体参数进行推断。这一过程涉及到两个核心概念:参数估计与假设检验。本章将详细介绍大数定律和中心极限定理的基本原理及其在统计推断中的应用,同时探讨参数估计和假设检验的方法和常见误区。

4.1 大数定律与中心极限定理

4.1.1 大数定律的含义与应用

大数定律是概率论中的一条基本定理,表明在一定的条件下,大量独立同分布的随机变量的算术平均值会随着样本数量的增加而趋近于其期望值。这一现象的直观理解是,当实验次数足够多时,样本的频率会接近理论的概率值。

大数定律的应用极为广泛,在统计学、经济学、保险和金融等领域有着举足轻重的地位。例如,在金融市场中,投资者往往根据过去的数据来预测未来的股票价格走势。大数定律支持了这种做法的合理性,即通过大量历史数据的分析,可以对股票的期望回报做出较为准确的估计。

graph TD;

A[开始] --> B[收集大量历史数据];

B --> C[计算收益率的期望值];

C --> D[建立预测模型];

D --> E[应用模型进行预测];

E --> F[更新数据和模型];

F --> G[预测股票价格走势];

4.1.2 中心极限定理及其在统计中的角色

中心极限定理是另一个非常重要的统计学原理。它的核心思想是:不管总体分布如何,只要样本数量足够大,样本均值的分布将近似正态分布。这一原理为很多统计推断提供了理论基础,尤其是参数估计和假设检验。

在实际应用中,中心极限定理允许我们使用正态分布的性质对样本均值的置信区间进行估计,即使总体分布是非正态的。例如,在产品质检中,通过对一批产品的样本进行检测,可以估计出产品的平均质量,进而计算出其置信区间,并决定是否接受整批产品。

4.2 参数估计与假设检验

4.2.1 点估计与区间估计的方法

参数估计是统计推断的一个重要方面,主要包括点估计和区间估计。点估计是用样本统计量(如样本均值)来估计总体参数(如总体均值)的一个具体数值。而区间估计则给出一个包含总体参数的区间,并给出该区间置信度的估计值。

区间估计通常比点估计更为可靠,因为它提供了总体参数可能值的范围以及该范围的可信程度。例如,在调查研究中,研究人员可能需要估计总体中具有特定特征的比例。通过构建一个置信区间,研究者不仅给出了一个估计值,还提供了该估计值的可信程度。

import numpy as np

from scipy.stats import norm

# 假设总体均值和标准差未知,需要估计

# 假设样本数据为 numpy 数组 sample_data

sample_data = np.random.normal(100, 15, size=50) # 假设均值为 100,标准差为 15 的正态分布样本

# 置信水平,例如 95%

confidence_level = 0.95

# 计算样本均值和样本标准差

sample_mean = np.mean(sample_data)

sample_std = np.std(sample_data, ddof=1)

# 计算标准误差

standard_error = sample_std / np.sqrt(len(sample_data))

# 计算置信区间的 z 分数

z_score = norm.ppf((1 + confidence_level) / 2)

# 计算置信区间

confidence_interval = (sample_mean - z_score * standard_error,

sample_mean + z_score * standard_error)

print(f"置信区间为: {confidence_interval}")

4.2.2 假设检验的基本步骤和常见误区

假设检验是另一项统计推断中的重要技术,其目的是确定样本数据是否足够充分以拒绝某一关于总体参数的假设。基本步骤包括:建立零假设和备择假设、选择检验统计量、确定显著性水平、计算检验统计量的观测值以及做出决策。

在假设检验过程中,存在一些常见的误区。比如,混淆“统计显著性”与“实际重要性”,或者是“第一类错误”与“第二类错误”的概念。此外,检验结果的解释要避免过度推断,例如,样本数据支持某个假设,并不意味着该假设一定正确,也不能因为样本数据拒绝了某个假设,就认为该假设绝对错误。

通过对假设检验的正确理解和操作,统计分析人员能够更加科学地处理数据,为决策提供更为有力的支持。

5. 统计分析中的期望与方差

5.1 期望的定义与计算

5.1.1 离散与连续随机变量的期望值

在统计学和概率论中,期望(或数学期望)是一个衡量随机变量平均值的量。对于离散型随机变量,期望值是所有可能结果乘以其概率的总和;对于连续型随机变量,则是概率密度函数下的积分。

对于离散型随机变量 X,其期望值 E(X) 定义为: [ E(X) = \sum_{x} x \cdot P(X = x) ]

其中 ( \sum ) 表示求和,( x ) 是随机变量 X 的可能值,而 ( P(X = x) ) 是 X 等于 x 的概率。

对于连续型随机变量 Y,其期望值 E(Y) 定义为: [ E(Y) = \int_{-\infty}^{\infty} y \cdot f(y) \, dy ]

其中 ( \int ) 表示积分,( y ) 是随机变量 Y 的可能值,而 ( f(y) ) 是 Y 的概率密度函数。

期望值的计算在实际应用中非常广泛,如金融领域中计算投资的预期收益,或者在产品测试中预测产品寿命的平均时间。

5.1.2 期望的性质及其在实际中的应用

期望值有若干重要性质,这些性质可以帮助我们更容易地计算复杂随机变量的期望值。

-

线性性质:对于任何常数 a 和 b,以及任意随机变量 X 和 Y,有: [ E(aX + b) = aE(X) + b ] [ E(X + Y) = E(X) + E(Y) ] 这表明期望值与线性变换是可结合的。

-

期望值的非负性:如果所有可能的随机变量值都是非负数,那么其期望值也是非负的。

-

预期值的可忽略性:如果 X 和 Y 是独立随机变量,则有: [ E(XY) = E(X) \cdot E(Y) ]

在现实世界的应用中,期望值不仅用于计算平均数,还用于风险评估、经济模型的建立以及概率论的许多其他方面。比如,一家公司可能会利用期望值来预测未来某个时期内的销售额,从而制定相应的生产和市场策略。

5.2 方差与标准差的计算与解读

5.2.1 方差的数学定义及其计算方法

方差是衡量随机变量离散程度的一个指标。在统计学中,它被定义为随机变量与其期望值差的平方的期望值。

对于离散型随机变量 X 的方差 ( Var(X) ) 定义为: [ Var(X) = E[(X - E(X))^2] ]

对于连续型随机变量 Y 的方差 ( Var(Y) ) 定义为: [ Var(Y) = \int_{-\infty}^{\infty} (y - E(Y))^2 \cdot f(y) \, dy ]

在计算时,方差可以简化为: [ Var(X) = E(X^2) - [E(X)]^2 ] [ Var(Y) = \int_{-\infty}^{\infty} y^2 \cdot f(y) \, dy - [E(Y)]^2 ]

方差的计算在数据分析中极为关键,因为它帮助识别数据的分布情况,尤其是在比较不同数据集时。

5.2.2 方差在数据分散度分析中的作用

方差作为衡量数据分散程度的工具,其大小直接反映了随机变量的分散或聚集的程度。方差大意味着随机变量的值分散,方差小则意味着值比较集中。

在应用层面上,方差被用来:

- 评估数据的离散性,从而为风险评估提供基础信息。

- 在质量管理中,控制产品质量的一致性。

- 在投资领域,评估资产的风险和预期回报。

- 在自然和社会科学实验中,控制实验误差和不确定性。

例如,一个公司的不同业务部门的利润率方差很大,可能表明业务风险分散,公司需要采取措施保证某些高风险部门的稳定。相反,如果利润率的方差很小,那么公司可以针对特定的高利润业务进行更多投资,以进一步提高利润。

6. 回归分析与相关性系数

回归分析与相关性系数是统计学中的核心概念,广泛应用于数据分析、预测建模以及科学研究等领域。本章将深入探讨线性回归的理论基础及其实际应用,并详细解析相关性系数的概念与计算方法。

6.1 线性回归的理论与实践

线性回归是研究两个或两个以上变量之间线性关系的一种统计方法。它旨在通过一个或多个自变量的值来预测因变量的值。

6.1.1 线性回归模型的构建与评估

构建线性回归模型通常从假设因变量和自变量之间存在线性关系开始。以最简单的单变量线性回归为例,我们尝试用一个自变量 (X) 来解释因变量 (Y),模型可以表示为:

[ Y = \beta_0 + \beta_1 X + \epsilon ]

其中,(Y) 是因变量,(X) 是自变量,(\beta_0) 是截距,(\beta_1) 是斜率,(\epsilon) 是误差项。

在进行线性回归分析之前,首先需要收集数据并对数据进行探索性分析,以检验变量间的关系是否符合线性假设。然后,采用最小二乘法估计模型参数 (\beta_0) 和 (\beta_1),使得所有观测值与回归线的垂直距离的平方和最小。

6.1.2 最小二乘法在回归分析中的应用

最小二乘法是一种数学优化技术,它通过最小化误差的平方和来寻找数据的最佳函数匹配。在单变量线性回归中,最小二乘法的参数估计公式为:

[ \hat{\beta} 1 = \frac{\sum {i=1}^{n} (X_i - \bar{X})(Y_i - \bar{Y})}{\sum_{i=1}^{n} (X_i - \bar{X})^2} ]

[ \hat{\beta}_0 = \bar{Y} - \hat{\beta}_1 \bar{X} ]

其中,(X_i) 和 (Y_i) 分别是第 (i) 个观测点的自变量和因变量的值,(\bar{X}) 和 (\bar{Y}) 是自变量和因变量的均值。

在多变量线性回归中,参数的估计涉及矩阵运算,需要使用多元统计分析的方法。

6.2 相关性系数的理论与计算

相关性系数用于量化两个变量之间的线性相关程度。最常用的线性相关系数是皮尔逊相关系数。

6.2.1 相关性系数的定义及其在统计中的重要性

皮尔逊相关系数 (r) 的计算公式为:

[ r = \frac{\sum_{i=1}^{n} (X_i - \bar{X})(Y_i - \bar{Y})}{\sqrt{\sum_{i=1}^{n} (X_i - \bar{X})^2} \sqrt{\sum_{i=1}^{n} (Y_i - \bar{Y})^2}} ]

皮尔逊相关系数的取值范围为 ([-1, 1]),其中 (1) 表示完全正相关,(-1) 表示完全负相关,(0) 表示无关。

相关性系数对于数据科学家来说是一个非常重要的工具,因为它可以帮助他们理解变量之间是否存在关联,以及这种关联的强度。

6.2.2 计算相关性系数的实例分析

考虑一个简单的例子,我们有两组数据:一组是某城市在不同年份的平均温度 (X),另一组是同一年份的冰淇淋销量 (Y)。为了分析这两者之间是否存在相关性,我们计算皮尔逊相关系数。

假设我们有以下数据:

| 年份 | 平均温度 (X) | 冰淇淋销量 (Y) | |------|----------------|------------------| | 2015 | 20.5°C | 1500 | | 2016 | 22.8°C | 1800 | | 2017 | 23.1°C | 1850 | | 2018 | 22.9°C | 1790 | | 2019 | 24.0°C | 2000 |

计算得到的 (r) 值为 0.95。这表明平均温度和冰淇淋销量之间存在强烈的正相关关系。尽管相关性不等于因果性,这样的分析结果可以为营销策略制定提供有价值的见解。

在实际应用中,相关性分析往往通过统计软件或编程语言(如Python或R)进行,利用内置函数快速得到结果。例如,在Python中,可以使用numpy库计算相关系数:

import numpy as np

# 定义两组数据

X = np.array([20.5, 22.8, 23.1, 22.9, 24.0])

Y = np.array([1500, 1800, 1850, 1790, 2000])

# 计算皮尔逊相关系数

r = np.corrcoef(X, Y)[0, 1]

print(f'皮尔逊相关系数 r = {r:.2f}')

以上代码块展示了如何使用Python计算两个变量之间的皮尔逊相关系数。

通过本章的学习,我们可以更好地理解回归分析和相关性系数在实际中的应用,为后续的数据挖掘、模型建立和预测分析打下坚实的基础。在下一章节,我们将继续探讨数据统计分析的其他重要概念和方法。

简介:本PPT课件详细介绍了《概率论与数理统计》这门在IT行业中至关重要的数学课程。内容覆盖了随机事件、概率、二项分布、条件概率、事件的关系与运算、期望与方差、大数定律与中心极限定理、分布理论、参数估计与假设检验以及回归分析与相关性等核心概念。掌握这些知识对于数据分析、机器学习、人工智能等领域的应用至关重要,能为IT专业人士在数据分析和建模方面提供坚实的理论基础。

609

609

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?