书生·浦语大模型实战系列文章目录

书生·浦语大模型全链路开源体系发展历程和特点(lesson 1)

部署 InternLM2-Chat-1.8B(lesson 2-1)

部署八戒demo InternLM2-Chat-1.8B(lesson 2-2)

部署InternLM2-Chat-7B 模型(lesson 2-3)

部署浦语·灵笔2 模型(lesson 2-4)

部署InternLM Studio“茴香豆”知识助手(lesson 3)

XTuner 微调 LLM: 1.8B、多模态和 Agent(lesson 4)

LMDeploy 量化部署 LLM & VLM 实践(lesson 5)

Lagent & AgentLego 智能体应用搭建(lesson 6)

OpenCompass 大模型评测实战(lesson 7)

书生·浦语大模型实战:部署InternLM2-Chat-7B 模型(lesson 2-3)

前言

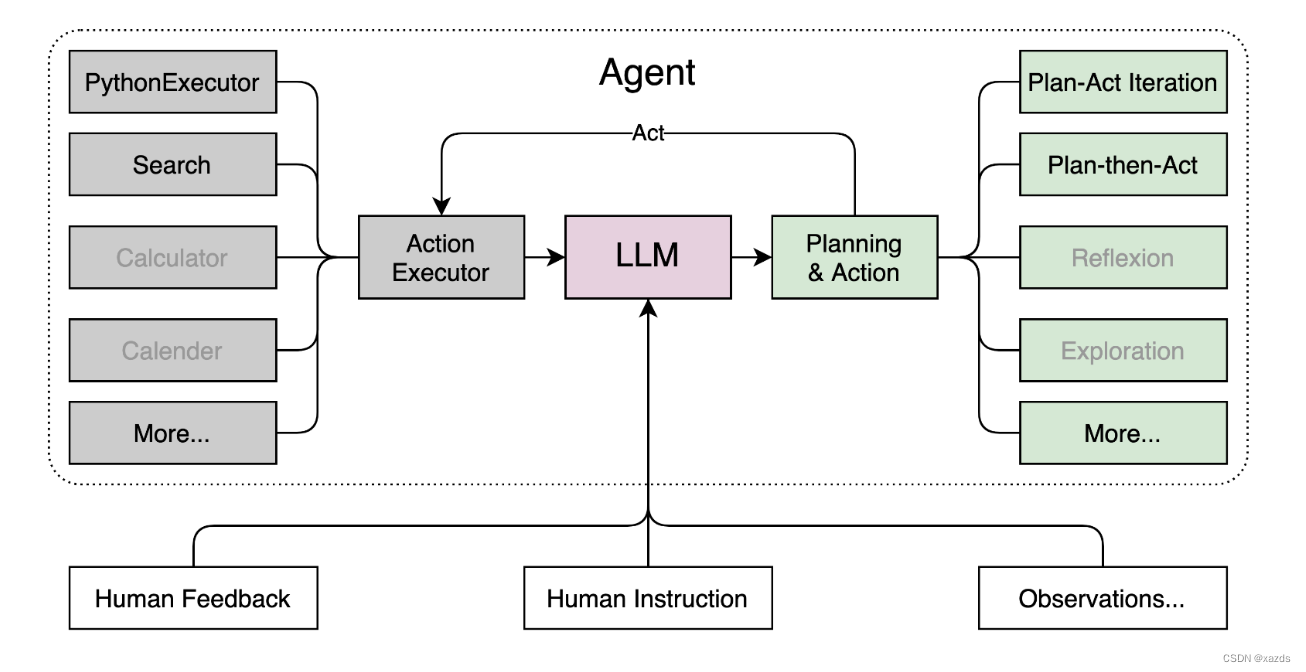

Lagent 是一个轻量级、开源的基于大语言模型的智能体(agent)框架,支持用户快速地将一个大语言模型转变为多种类型的智能体,并提供了一些典型工具为大语言模型赋能。

Lagent 的特点:

流式输出:提供

,包括:

一、框架

1. stream_chat 接口作流式输出,本地就能演示酷炫的流式 Demo。

2. 接口统一,设计全面升级,提升拓展性。

3. 文档全面升级,API 文档全覆盖。

4. 优势:

Model : 不论是 OpenAI API, Transformers 还是推理加速框架 LMDeploy 一网打尽,模型切换自由;

Action: 简单的继承和装饰,即可打造自己个人的工具集,不论 InternLM 还是 GPT 均可适配;

**Agent:**模型输入接口一致,模型到智能体的蜕变只需一步,便捷各种 agent 的探索实现。

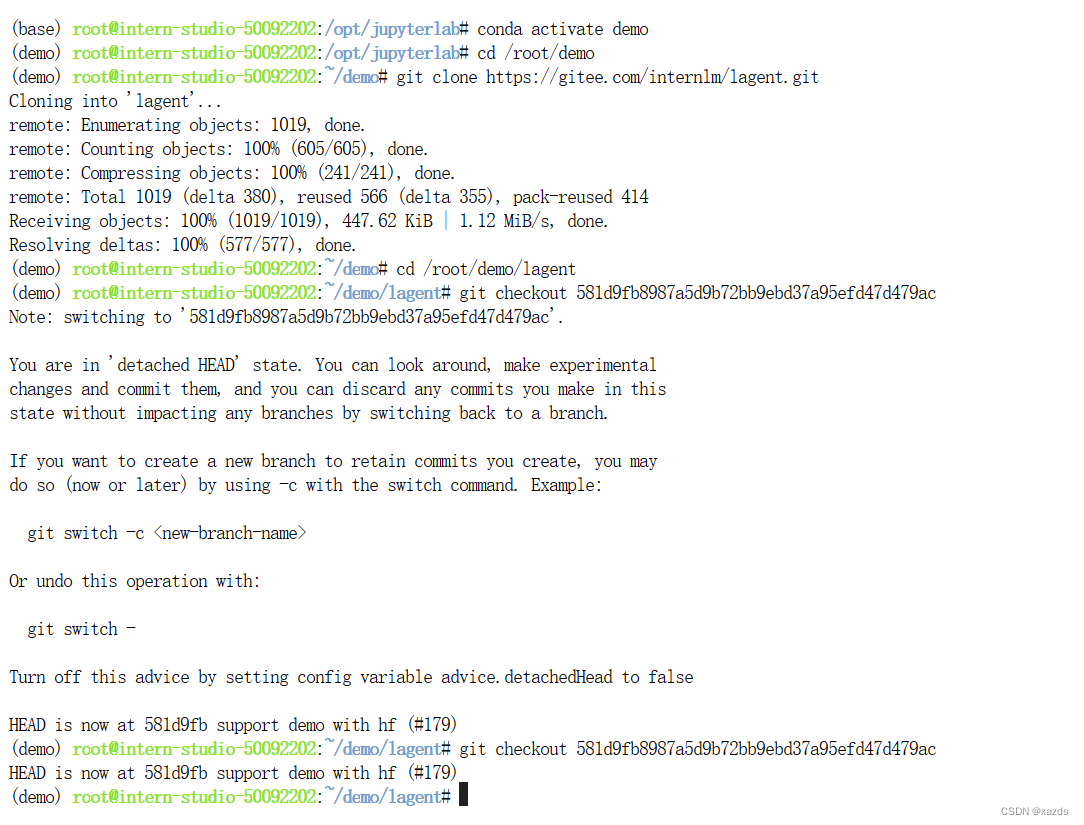

二、配置基础环境

在之前的环境安装基础上,重新开启开发机,输入命令。

2.1 开启 conda 环境:

conda activate demo

2.2 进入子路径:

cd /root/demo

2.3 git 下载 Lagent 相关代码库:

git clone https://gitee.com/internlm/lagent.git

# git clone https://github.com/internlm/lagent.git

cd /root/demo/lagent

git checkout 581d9fb8987a5d9b72bb9ebd37a95efd47d479ac

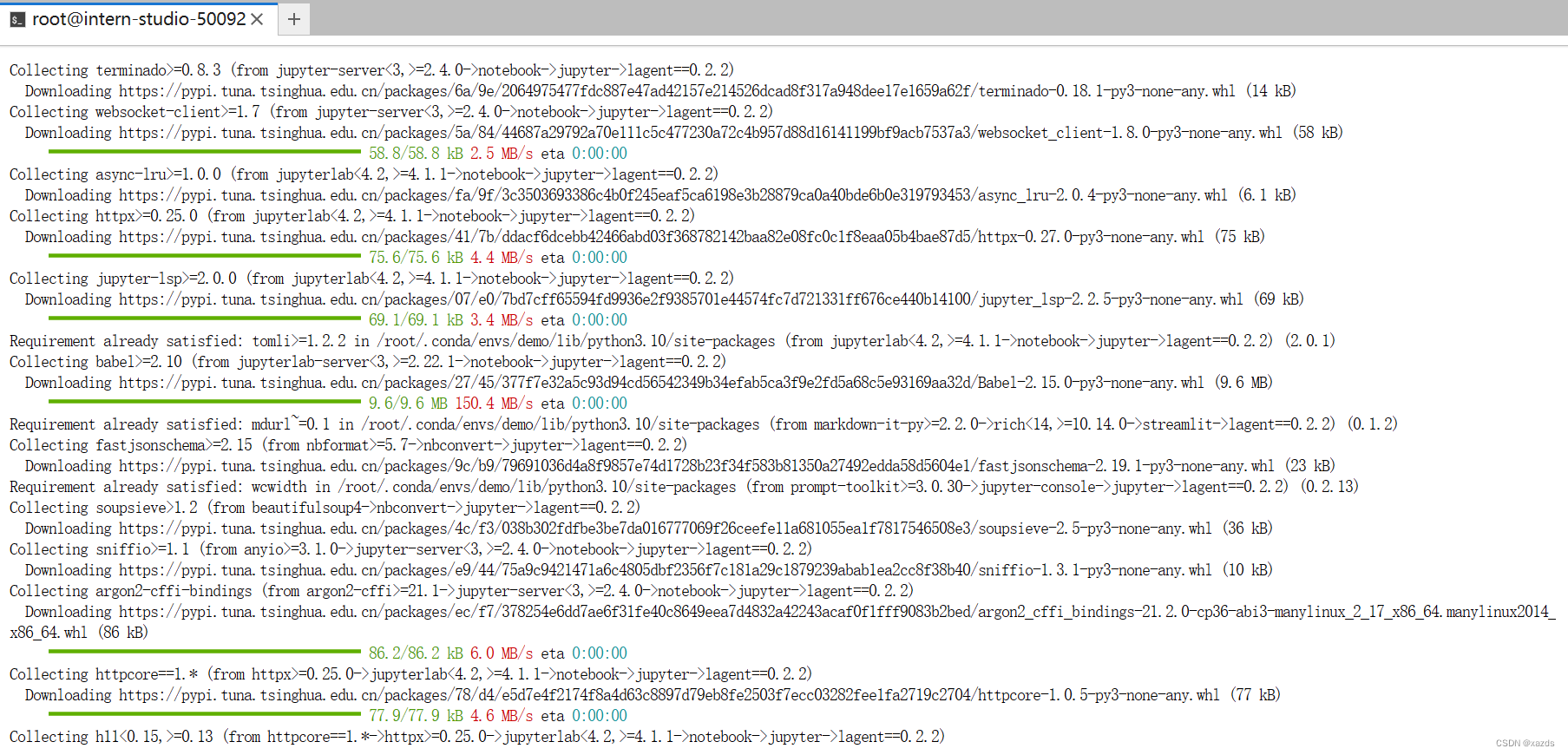

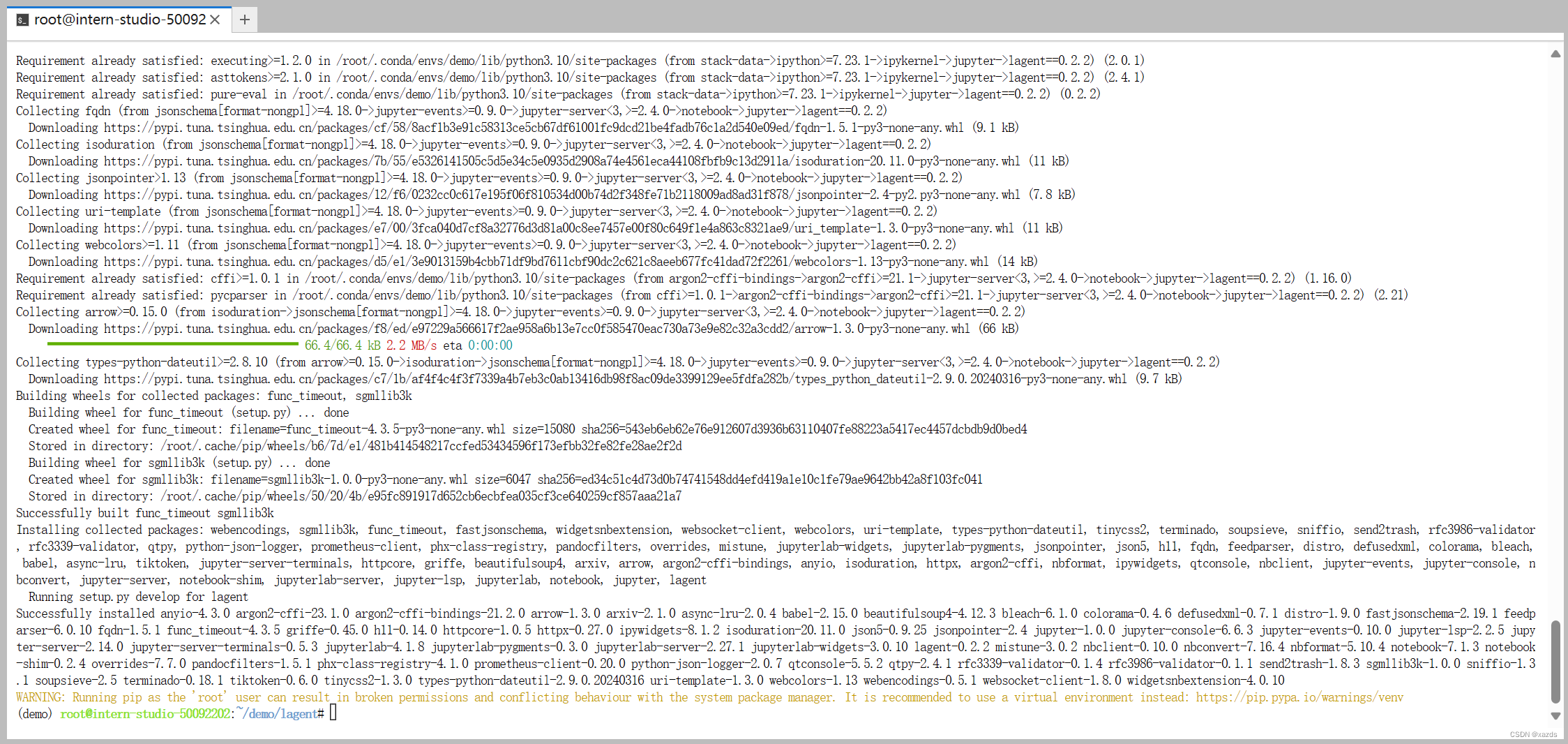

pip install -e . # 源码安装

2.4 运行:

三、使用 Lagent 运行 InternLM2-Chat-7B 模型为内核的智能体

Intern Studio 在 share 文件中预留了实战所需的所有基础模型,包括 InternLM2-Chat-7b 、InternLM2-Chat-1.8b 等等。

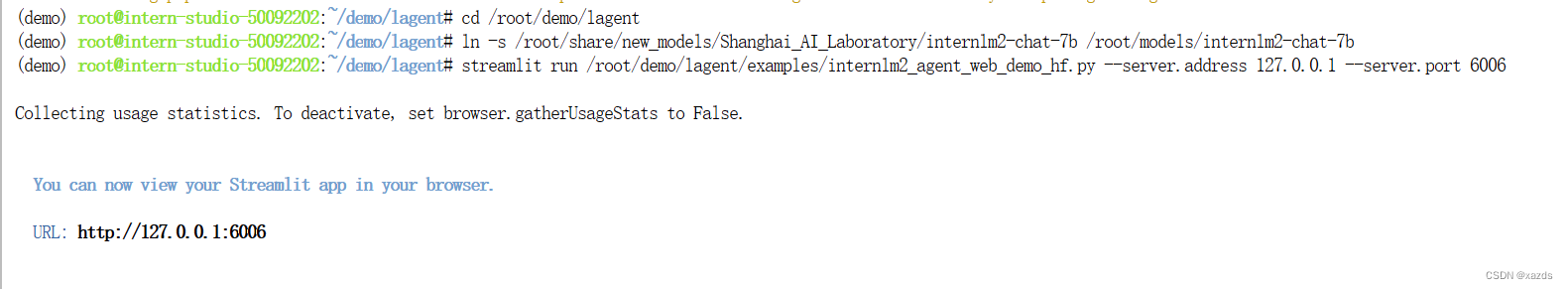

3.1 进入lagent 路径:

cd /root/demo/lagent

3.2 在 terminal 中输入指令,构造软链接快捷访问方式:

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-7b /root/models/internlm2-chat-7b

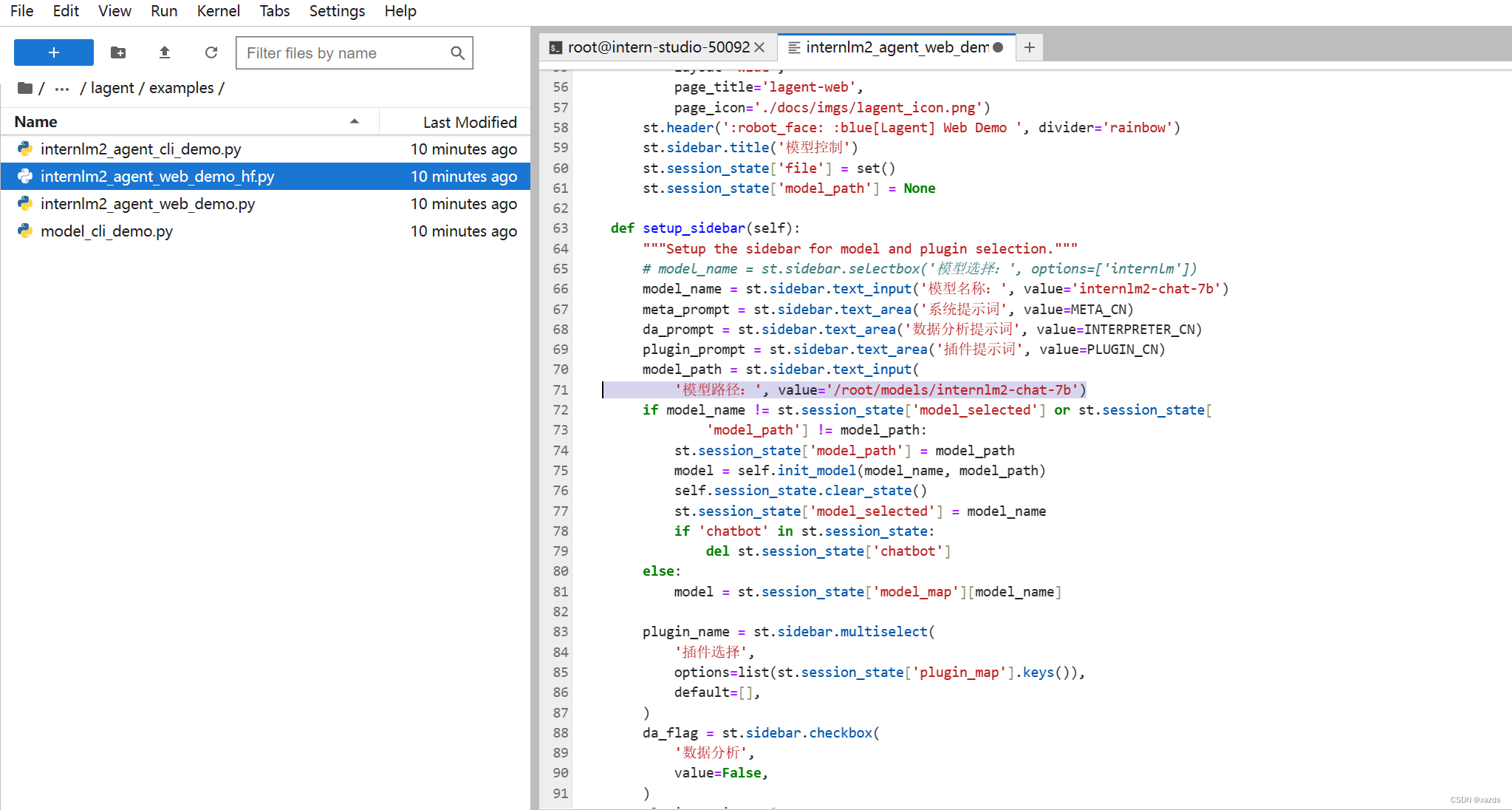

3.3 修改代码

打开 lagent 路径下 examples/internlm2_agent_web_demo_hf.py 文件,并修改对应位置 (71行左右) 代码:

# 其他代码...

value='/root/models/internlm2-chat-7b'

# 其他代码...

3.4 加载模型

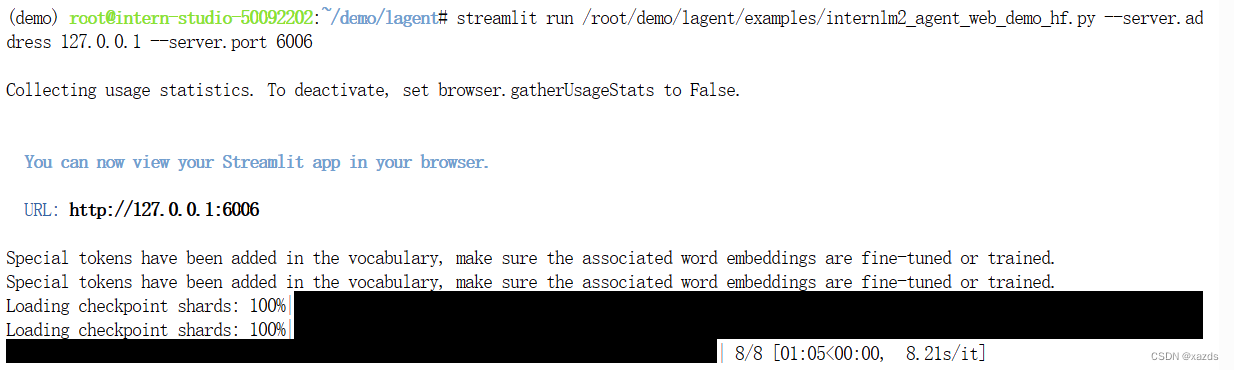

- 输入运行命令 - 点开 6006 链接后,大约需要 5 分钟完成模型加载。

streamlit run /root/demo/lagent/examples/internlm2_agent_web_demo_hf.py --server.address 127.0.0.1 --server.port 6006

-

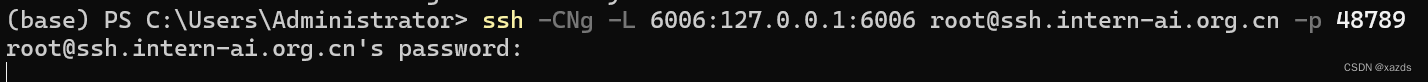

程序运行成功之后,在本地客户端计算机上配置本地端口和环境 。使用快捷键组合 Windows + R(Windows 即开始菜单键)打开PowerShell 指令界面。

-

在服务器上记住端口号,复制下方的密码备用,再根据端口键入命令 :

# 从本地使用 ssh 连接 studio 端口

# 将下方端口号 12345 替换成自己的端口号

ssh -CNg -L 6006:127.0.0.1:6006 root@ssh.intern-ai.org.cn -p 12345

- 在cmd窗口中,鼠标右键点一下,粘贴密码,直接回车即可。

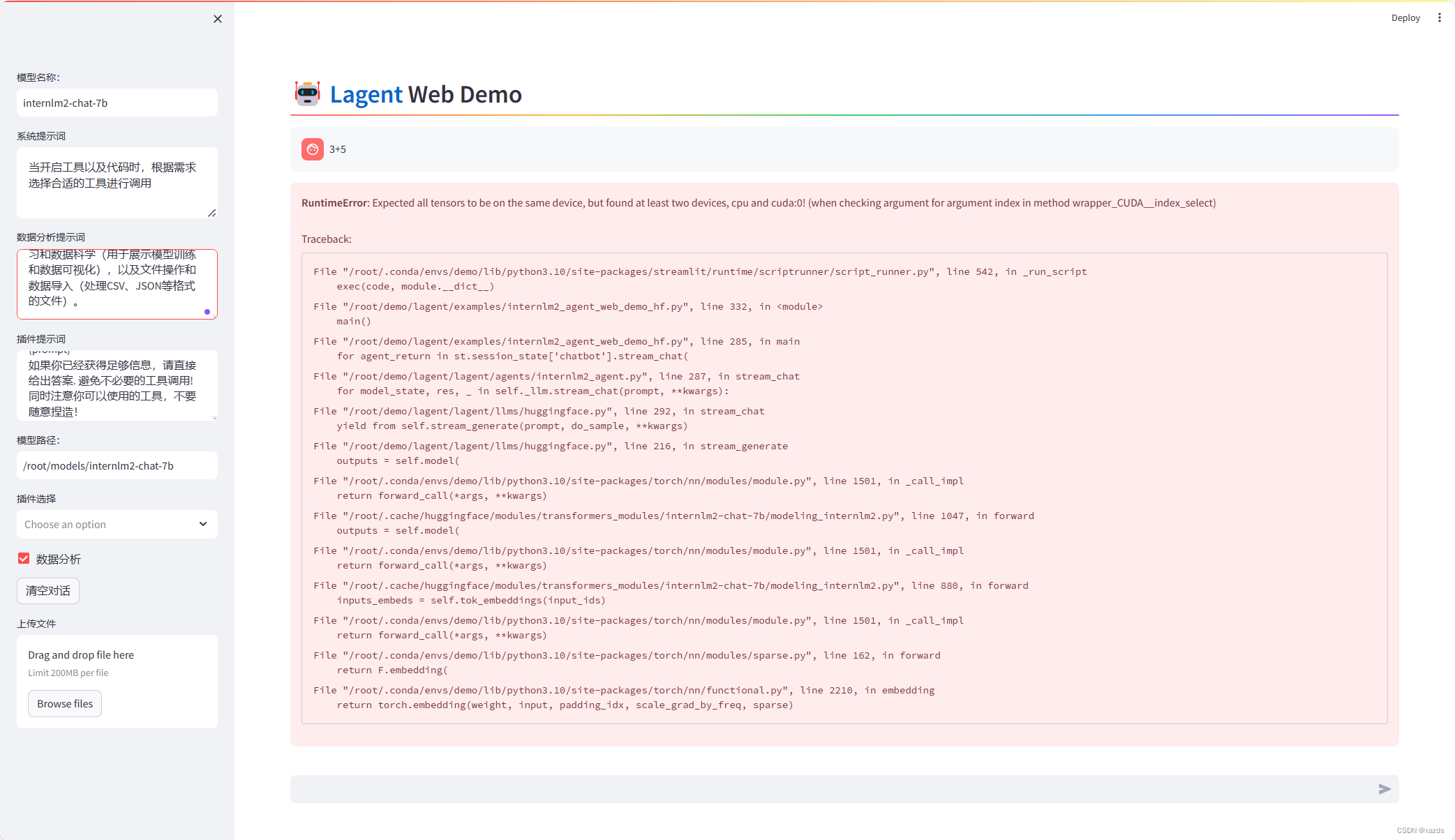

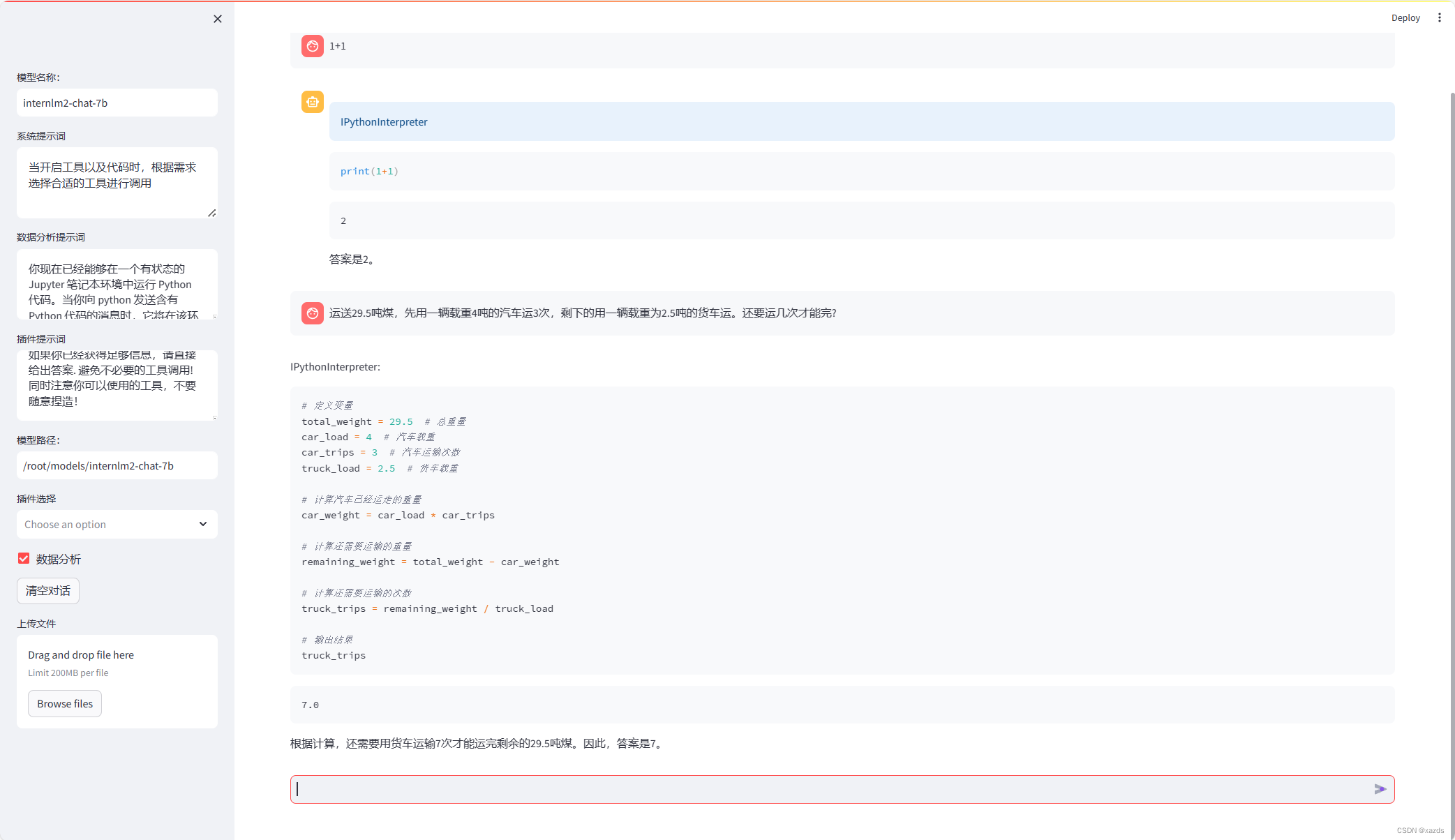

浏览器打开 http://127.0.0.1:6006 ,加载成功后,勾上数据分析,其他的选项不选,开始进行计算 Demo 。

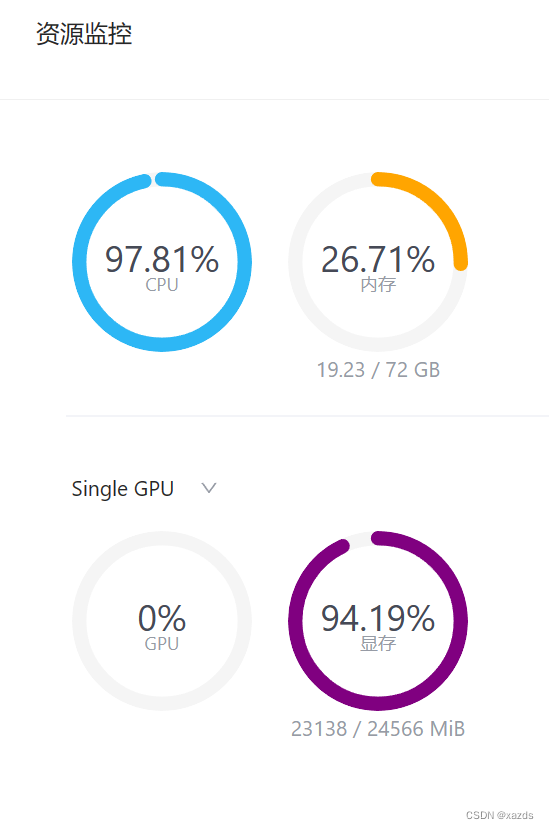

做了一个简单的3+5,结果资源消耗成下图的样子。看来要再次升级到50%算力,才会比较轻松。

重新启动了一下,终于出来答案了。

小结

InternLM2-Chat-7B的安装部署,和之前的差不多,轻车熟路,一路畅通。个人感觉数学计算比较无趣,没做太多测试.

656

656

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?