LSTM(Long short term memory,长短时记忆网络),是一种特殊的RNN(Recurrent Neural Network,循环神经网络),能够学习长期的依赖关系。LSTM在这篇文章中被提出。

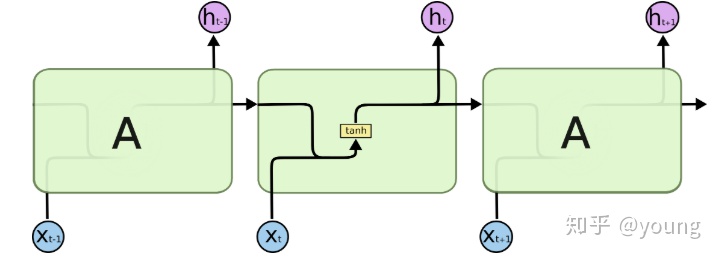

所有RNN都具有神经网络的重复模块链的形式。 在标准的RNN中,该重复模块将具有非常简单的结构,例如单个tanh层。标准的RNN网络如下图所示

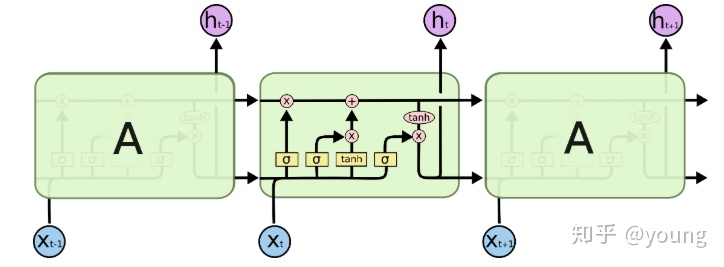

LSTM也具有神经网络的重复模块链的形式。只是在CNN的基础上,每个重复模块增加了三个神经网络层,如下图所示

图中的绿色大框代表单元模块;黄色方框代表神经网络层;粉色圆圈代表逐点操作,例如矢量加法;箭头表示向量转换,从一个节点输出到另一个节点输入;合并的行表示串联,而分叉的行表示要复制的内容&#x

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

6623

6623

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?