人工智能(AI)已广泛渗透到生活和工作的方方面面。然而,部分AI系统的“黑箱”特性,即其决策过程的不透明性,引发了公众对问责性和信任度的担忧。为解决这一问题,技术专家正致力于提升AI决策过程的透明度,而AI可追溯性正是这一努力的关键所在。

AI可追溯性的定义与核心原则

AI可追溯性是指在AI系统的整个生命周期中跟踪和记录数据、决策的能力,详细记录AI的开发、训练以及决策过程。它基于三大核心原则:数据血缘、模型血缘和决策血缘,旨在全面增强AI系统的透明度和问责性。

-

数据血缘:追踪数据从原始数据采集、处理到在AI模型中最终使用的全过程,确保法规遵从性,并识别数据中潜在的偏差或错误。

-

模型血缘:记录AI模型的整个生命周期,包括初始创建、算法和参数使用、训练过程以及版本修改/更新,便于跟踪模型变化。

-

决策血缘:跟踪AI系统做出决策的每一步,包括输入数据、操作顺序以及最终决定或预测,确保重要决策能够被理解和解释,尤其是在风险较高的情况下。比如AI辅助医生诊断时,会记录输入的症状、信息分析过程以及诊断建议的原因。

成功实现AI可追溯性后,将带来以下益处,以助力组织理解和改进AI模型:

-

增加信任和透明度:可追溯性清晰记录AI做出决策的过程,有助于开发人员和用户洞悉决策背后的逻辑和数据处理过程,增强了内外部对AI工具的信心。

-

减少偏差并确保公平:通过跟踪AI工作路径,有效监控数据使用与决策制定过程,及时发现并纠正潜在的不公平倾向或系统性偏差。

-

改进调试和模型性能:当AI给出意外答案时,可追溯性帮助组织回溯问题所在,加速故障排查和修复,提升系统的稳定性和可靠性。

实施AI可追溯性的困境和策略

由上可见AI可追溯性意义重大,但在实际实施过程中,许多企业常常陷入“心有余而力不足”的困境。

数据孤岛和缺乏标准:数据存储混乱是实现可追溯性的一大难题。不同团队存储数据的方式、位置不同,当企业没有对这些数据进行整齐的分类时,搜索特定的细节极为困难。如果这些杂乱的信息直接提供给大语言模型(LLMs)中,之后几乎不可能弄清楚它们的来源。为了解决这个问题,企业需要打破数据存储间的壁垒,制定统一的数据处理标准。

现代AI模型的复杂性:具有深度学习架构等现代AI模型非常复杂,多层算法和神经网络增加了决策过程的跟踪难度。

平衡可追溯性和隐私:AI可追溯性意味着要显示所使用数据的详细信息,但可能会泄露敏感数据。企业需要在保持透明度的同时,保护敏感数据的安全。

那么,如何打破上述困境,让AI可追溯性真正落地呢?软信天成总结了一套实施策略,涵盖AI 开发与部署的各个关键环节,供诸位参考。

关注AI生命周期:AI可追溯性应涵盖AI生命周期的每个阶段,从数据收集和模型训练到部署和监控。通过关注整个生命周期,可以确保AI决策过程的每一步都有据可查。

数据管理优先:优先考虑数据管理,可以维护AI模型中使用的数据的完整性,为理解这些模型如何做出决策奠定基础。

建立数据治理策略:定义数据访问权限、使用方式及隐私安全协议,促进数据合规,并确保AI可追溯性的合规。

促进数据协作和共享:数据科学家和其他业务用户之间的轻松协作和共享,促进了更透明的AI开发过程。

保持详细文档记录:详细文档记录数据在AI系统中工作的全部内容,包括数据源、模型参数、决策过程以及更改记录,以便理解和审计AI系统。

使用版本控制系统:实现版本控制系统,以跟踪 AI 模型在开发过程中的变化,便于问题回溯和版本管理。

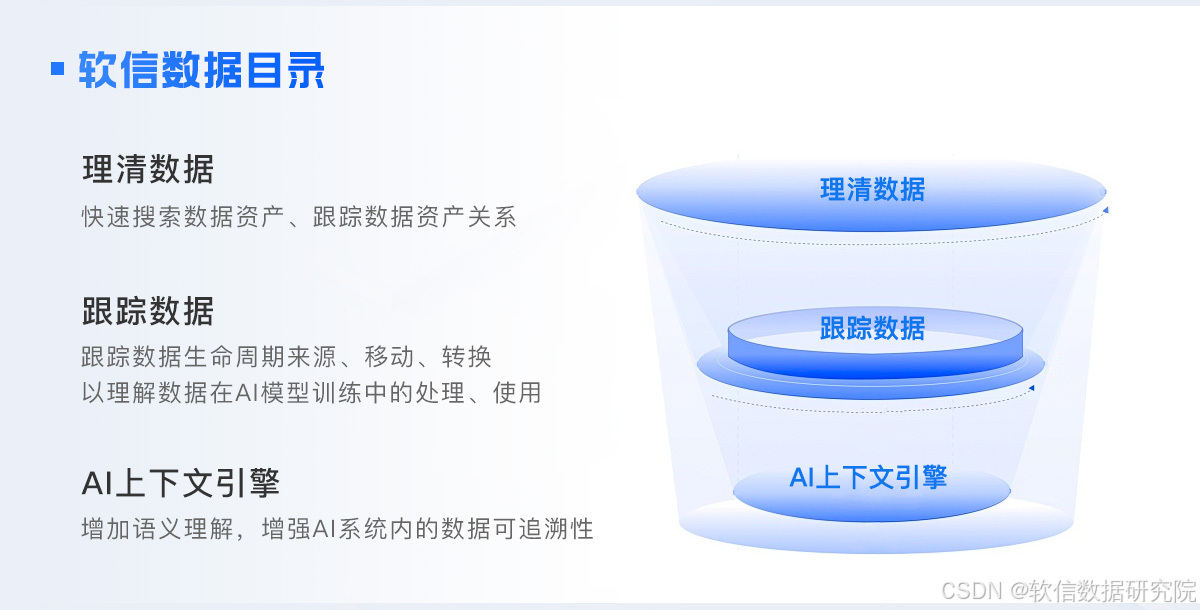

使用数据目录等工具:借助软信数据目录和血缘等专业工具绘制数据关系图谱。这些工具可以将分散的数据整理成适用于AI的数据,并全程跟踪数据在AI系统中的流动轨迹;提供数据使用的详细视图,使得在将数据输入系统之前,轻松快捷地跟踪数据的来源和转换;此外,我们数据目录搭载了AI上下文引擎,可以将训练模型中使用的数据及其相关信息(如定义、指标、来源)相连接,有效增强AI系统内的数据可追溯性。

在 AI 技术迅猛发展的当下,AI 可追溯性已成为解锁 AI 信任密码的关键钥匙。尽管在实施过程中会面临诸多挑战,但通过遵循科学合理的策略,企业将逐步攻克难关,构建起值得信赖的 AI 应用体系。如有需要欢迎私信!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?