Attention-Based Bidirectional Long Short-Term Memory Networks for Relation Classification

概述

作者提出了一种基于注意力机制的双向LSTM框架用于关系抽取。方法的主要创新点引入了注意力机制。

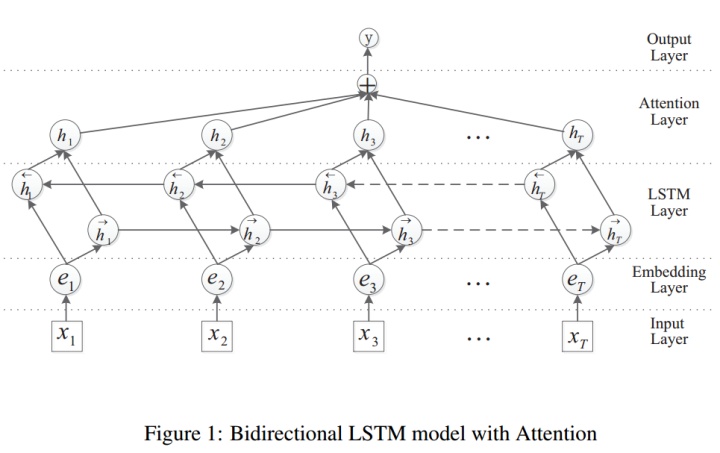

神经网络框架

框架非常简单,也是作者一直强调的。Embedding Layer、LSTM layer、Attention Layer。

Embedding Layer,跟通常的Embedding没有什么区别,首先使用训练好的word vector初始

化,然后在训练过程中微调。

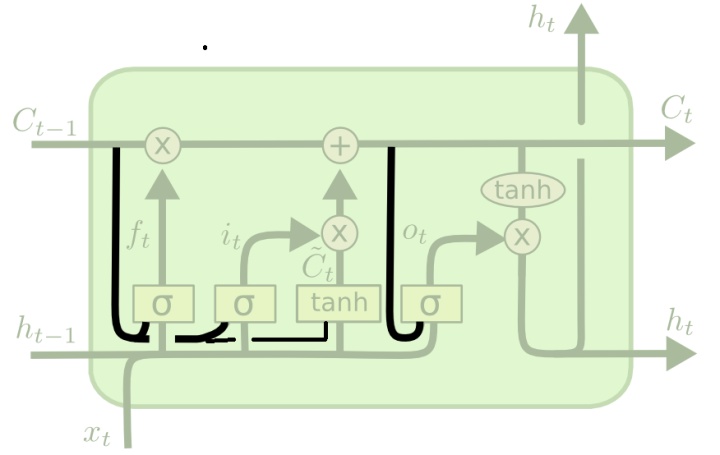

LSTM Layer

文章中使用的是LSTM的变体,其与LSTM的区别如下图,思想是各个门也将上一个记忆单元考虑上。

计算公式如下

Attention-Based Bidirectional Long Short-Term Memory Networks for Relation Classification 概述作者提出了一种基于注意力机制的双向LSTM框架用于关系抽取。方法的主要创新点引入了注意力机制。神经网络框架框架非常简单,也是作者一直强调的。Embedding Layer、LSTM layer、Attention L...

Attention-Based Bidirectional Long Short-Term Memory Networks for Relation Classification 概述作者提出了一种基于注意力机制的双向LSTM框架用于关系抽取。方法的主要创新点引入了注意力机制。神经网络框架框架非常简单,也是作者一直强调的。Embedding Layer、LSTM layer、Attention L...

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

6699

6699

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?