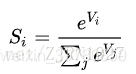

第一步:Softmax

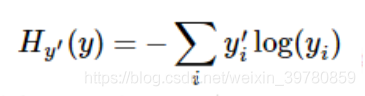

第二步:Cross-Entropy

tf.nn.sparse_softmax_cross_entropy_with_logits(logits, labels, name=None)

这里的labels的形状为[batch_size],也即长度为batch_size的一维向量。每一个值的取值范围是[0,num_class)。

如果label 已经是one-hot格式,可以使用

tf.nn.softmax_cross_entropy_with_logits()

参考

https://blog.csdn.net/ZJRN1027/article/details/80199248

https://blog.csdn.net/qq_22194315/article/details/77991283

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?