深度残差收缩网络(Deep Residual Shrinkage Networks,DRSN)是深度残差网络(Deep Residual Networks)的一种改进形式。顾名思义,深度残差收缩网络,就是对“深度残差网络”的“残差路径”进行“收缩(软阈值化)”的一种网络。深度残差收缩网络的设计体现了一种思想:在特征学习的过程中,剔除冗余信息也是非常重要的。

1. 深度残差网络基础

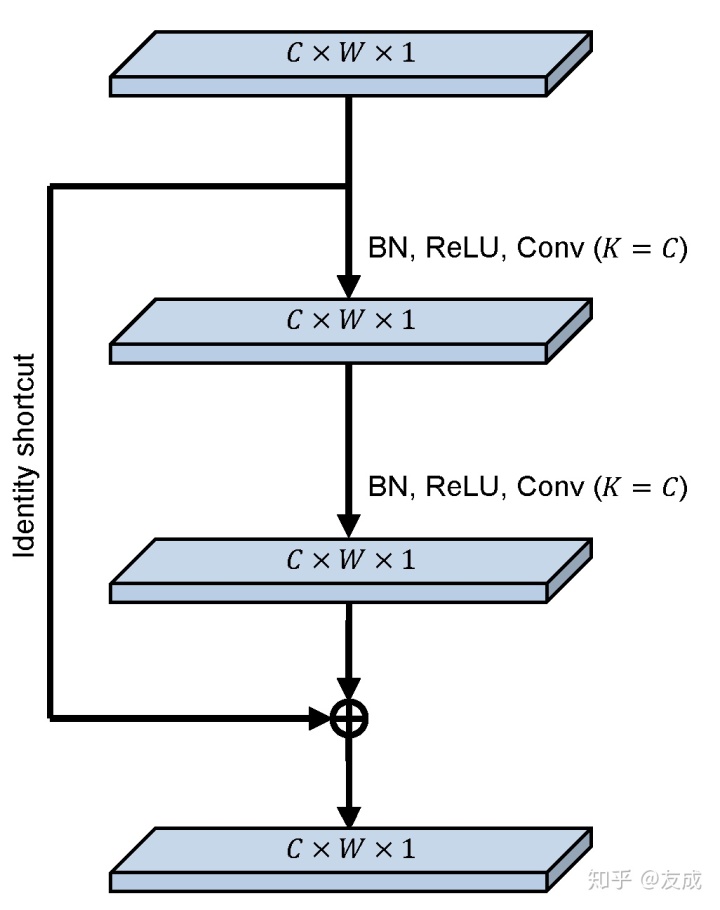

残差模块(Residual Building Unit, RBU)是深度残差网络基本组成部分。如下图所示,长方体表示通道数为C、宽度为W、高为1的特征图;一个残差模块可以包含两个批标准化(Batch Normalization, BN)、两个整流线性单元激活函数(Rectifier Linear Unit activation function, ReLU)、两个卷积层(Convolutional layer)和恒等映射(Identity shortcut)。恒等映射是深度残差网络的核心贡献,极大程度地降低了深度神经网络训练的难度。K表示卷积层中卷积核的个数,在此图中K与输入特征图的通道数C相等。在这张图中,输出特征图的尺寸和输入特征图的尺寸相等。

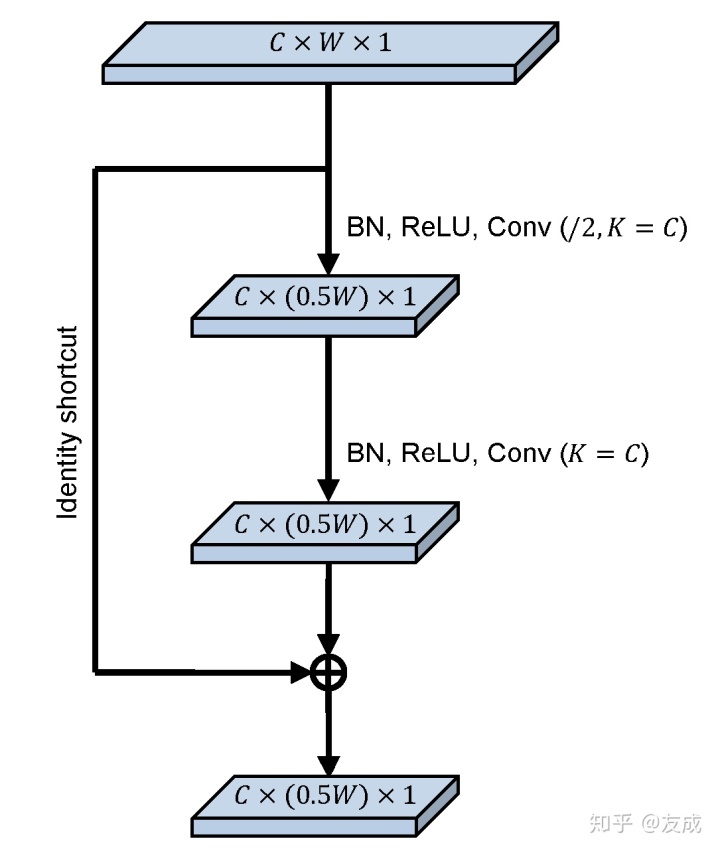

在残差模块中,输出特征图的宽度可以发生改变。例如,在下图中,将卷积层中卷积核的移动步长设置为2(用"/2"表示),那么输出特征图的宽度就会减半,变成0.5W。

输出特征图的通道数也可以发生改变。例如,在下图中,如果将卷积层中卷积核的个数设置为2C,那么输出特征图的通道数就会变成2C,也就是使得输出特征图的通道数翻倍。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

405

405

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?