1 TensorFlow Serving简单介绍

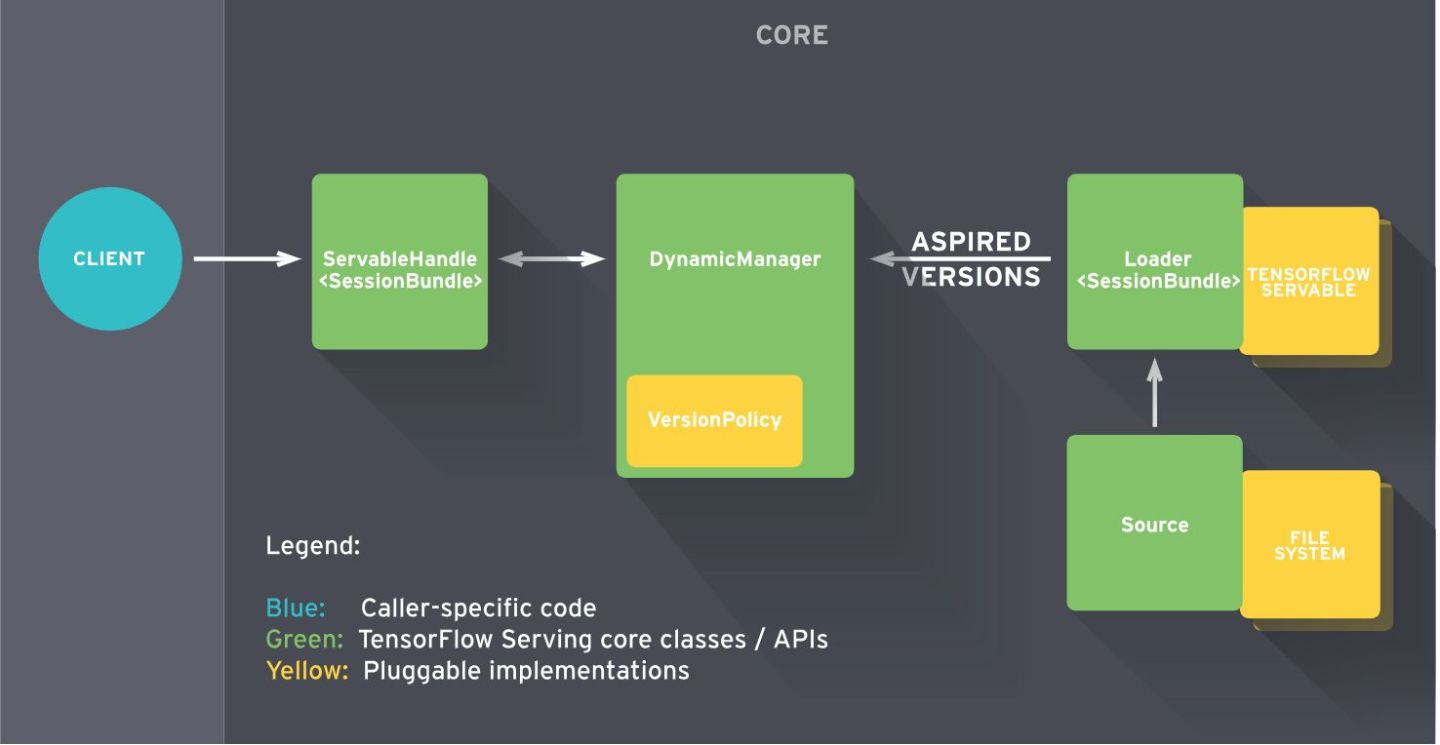

TensorFlow Serving 是一个用于机器学习模型 serving 的高性能开源库。它可以将训练好的机器学习模型部署到线上,使用 restful api或者grpc 作为接口接受外部调用,部署 TensorFlow Serving 后,你再也不需要为线上服务操心,只需要关心你的线下模型训练, 模型训练好打包成pd文件,传入tf-serving 中,调用即可。

2 docker 安装 tensorflow-serving ,using your gpu

TensorFlow Serving最简单的安装方法之一就是使用Docker,其他安装方式不在介绍。

2.1 step 1 安装 install nvida-docker

2.2 step 2 pull一个tfserver镜像

docker pull tensorflow/serving:latest-gpu

3 TensorFlow Serving gpu的使用

docker run --runtime=nvidia -p 8501:8501

--mount type=bind,

source=/tmp/tfserving/serving/tensorflow_serving/servables/tensorflow/my_model,

targ

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1045

1045

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?