点击蓝字关注我们

点击蓝字关注我们

AI研习图书馆,发现不一样的精彩世界

学习笔记

常见损失函数总结-图像分类下篇

一、前言

在深度学习中,损失函数扮演着至关重要的角色。通过最小化损失函数,使模型达到收敛状态,减少模型预测值的误差。因此,不同的损失函数,对模型的影响是十分重大的。

接下来,重点总结一下在实习工作实践中经常用到的损失函数:

图像分类:softmax,weighted softmax loss,focal loss,soft softmax loss,L-softmax Loss,Hinge,Exponential loss与Logistic loss

目标检测:Focal loss,L1/L2损失,IOU Loss,GIOU ,DIOU,CIOU

图像识别:Triplet Loss,Center Loss,Sphereface,Cosface,Arcface

什么是损失函数?

深度学习中的损失函数(loss function)是用来评估模型的预测值-f(x)与真实值-y的不一致程度,损失函数越小,代表模型的鲁棒性越好,损失函数能指导模型学习。

二、常见图像分类损失函数-下篇

2.3、softmax loss及其变种

假如log loss中的f(x)的表现形式是softmax概率的形式,那么交叉熵loss就是熟知的softmax with cross-entropy loss,简称softmax loss,所以说softmax loss只是交叉熵的一个特例。

softmax loss被广泛用于分类分割等任务,且发展出了很多的变种,有针对不平衡样本问题的weighted softmax loss,focal loss,针对蒸馏学习的soft softmax loss,促进类内更加紧凑的L-softmax Loss等一系列的改进。

2.3.1、softmax loss

softmax loss实际上是由softmax和cross-entropy loss组合而成,两者放一起数值计算更加稳定。推导过程如下:

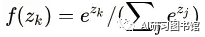

令z是softmax层的输入,f(z)是softmax的输出,则

本文总结了深度学习中常见的图像分类损失函数,包括softmax loss及其变种如weighted softmax loss、L-Softmax Loss。讨论了它们的作用和优化效果,如softmax优化类间距离,L-Softmax则使类内更加紧凑。还介绍了Hinge loss在支持向量机中的应用。

本文总结了深度学习中常见的图像分类损失函数,包括softmax loss及其变种如weighted softmax loss、L-Softmax Loss。讨论了它们的作用和优化效果,如softmax优化类间距离,L-Softmax则使类内更加紧凑。还介绍了Hinge loss在支持向量机中的应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5745

5745

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?