配置环境

为了快速部署,我们在colab(colab为我们免费提供了cuda等gpu环境以及pytorch等python环境)上使用免费的T4GPU进行部署

配置步骤

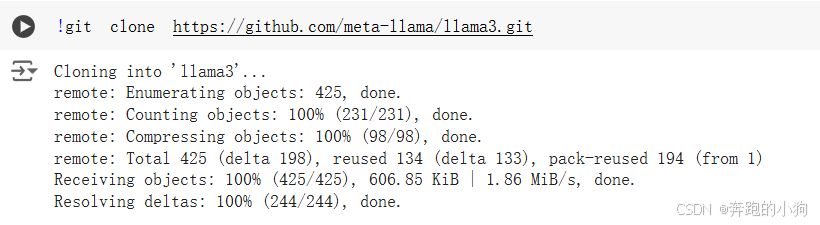

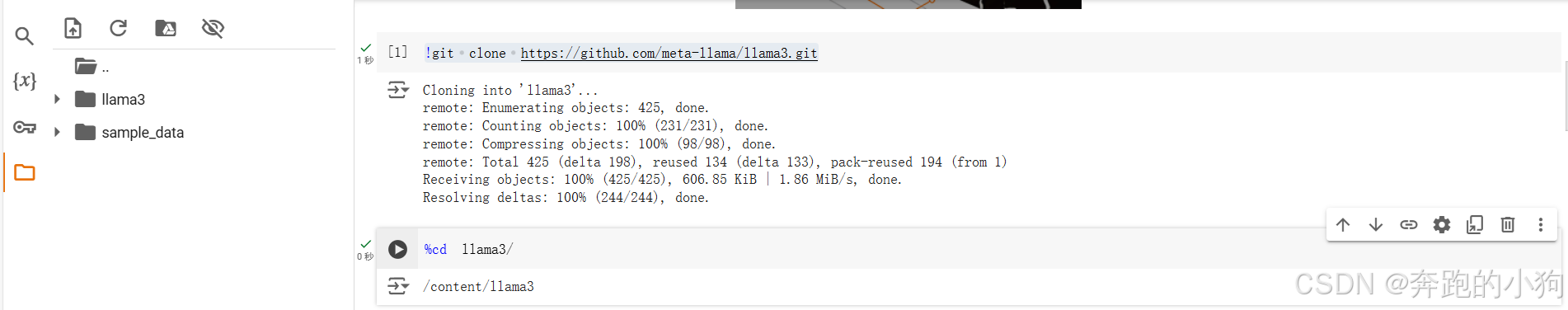

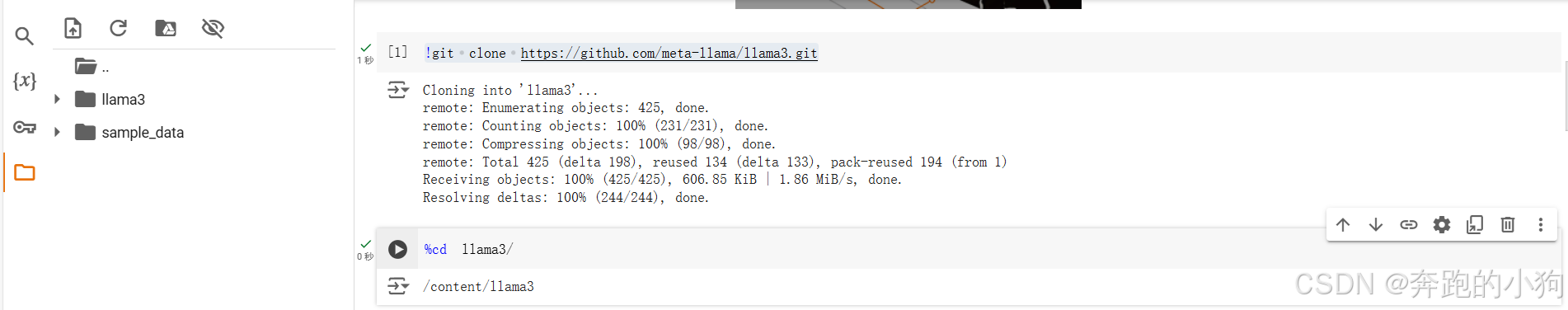

1、从github上下载llama源码

!git clone https://github.com/meta-llama/llama3.git

2、进入源码主文件夹

%cd llama3

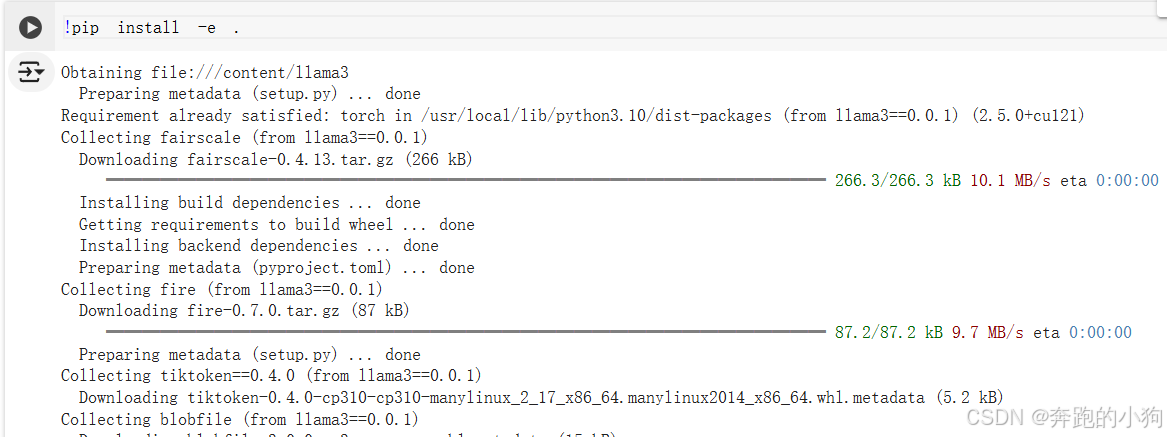

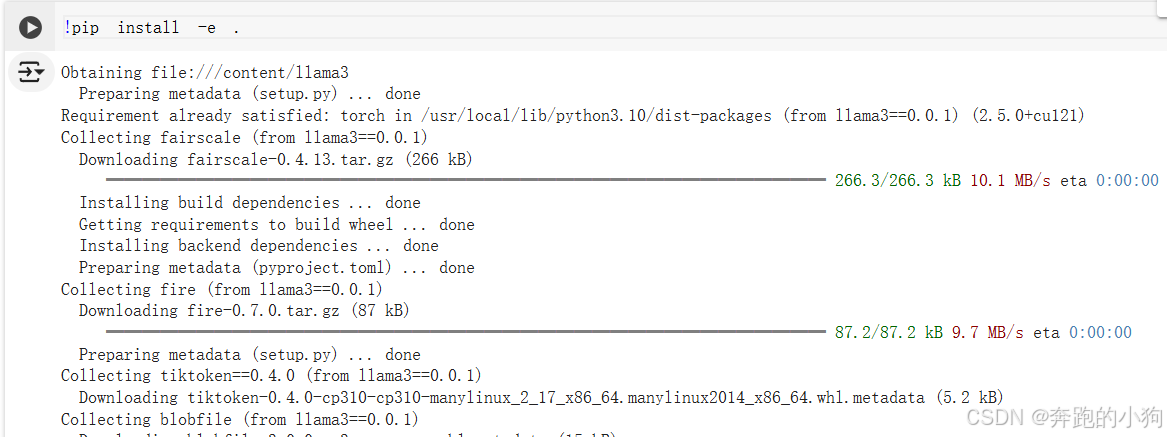

3、下载llama源码所需要的依赖包

!pip install -e .

<

<

为了快速部署,我们在colab(colab为我们免费提供了cuda等gpu环境以及pytorch等python环境)上使用免费的T4GPU进行部署

1、从github上下载llama源码

!git clone https://github.com/meta-llama/llama3.git

2、进入源码主文件夹

%cd llama3

3、下载llama源码所需要的依赖包

!pip install -e .

<

<

570

570

1206

1206

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?