6.1 支持向量机概述

6.1.1 为什么引入支持向量机

- 1.感知机的分类超平面不唯一

解决方法:增加约束,如SVM的最大化间隔 - 2.感知机无法解决非线性问题

解决方法:使用核方法,映射到高维空间

6.1.2 支持向量机

-

二分类模型

-

基本模型是定义在特征空间上的间隔最大的线性分类器,间隔最大使它有别于感知机

-

支持向量机还包括核技巧,这使它成为实质上的非线性分类器

-

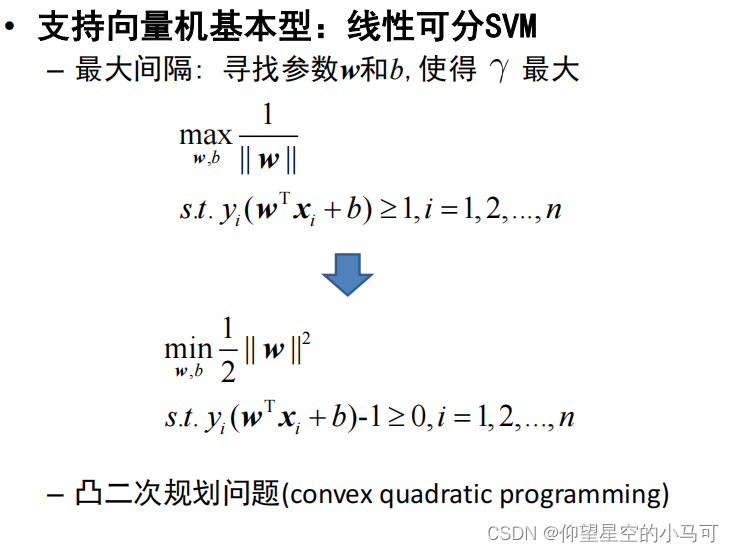

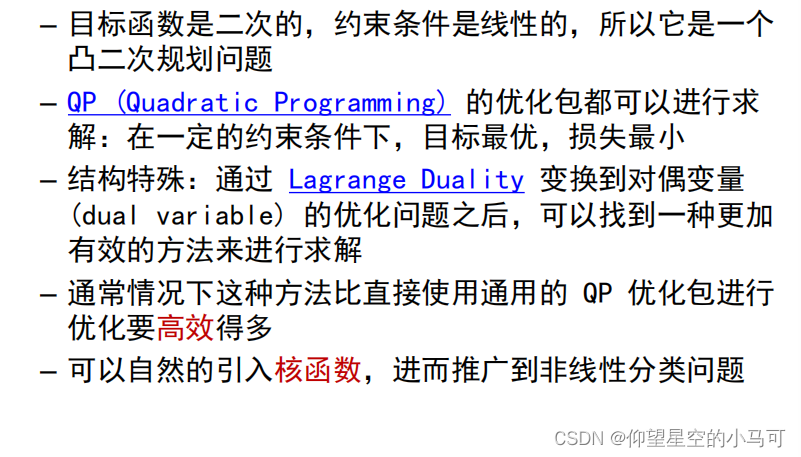

支持向量机的学习策略就是间隔最大化,可形式化为一个求解凸二次规划(convex quadratic programming)的问题,也等价于正则化的合页损失函数的最小化问题

-

支持向量机的学习算法是求解凸二次规划的最优化算法

-

线性可分支持向量机(linear support vector machine inlinearly separable case )

- 硬间隔最大化(hard margin maximization)

-

线性支持向量机(linear support vector machine)

- 训练数据近似线性可分时,通过软间隔最大化(soft marginmaximization)

-

非线性支持向量机(non-linear support vector machine)

- 当训练数据线性不可分时,通过使用核技巧(kernel trick)及软间隔最大化

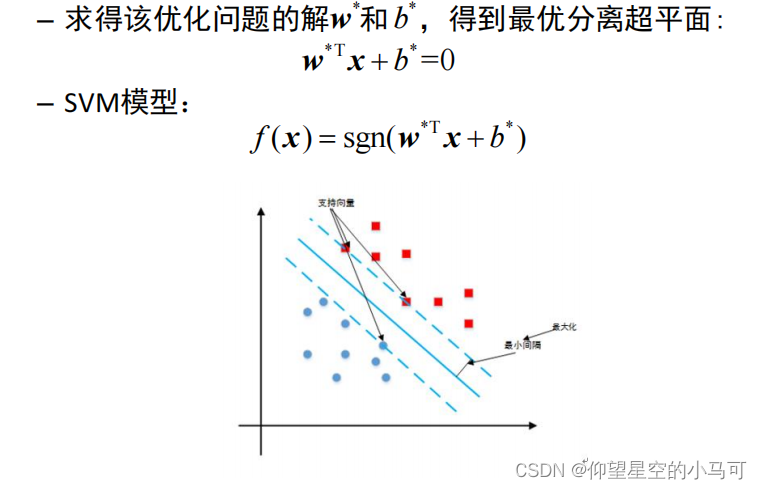

6.2 线性可分SVM与硬间隔最大化

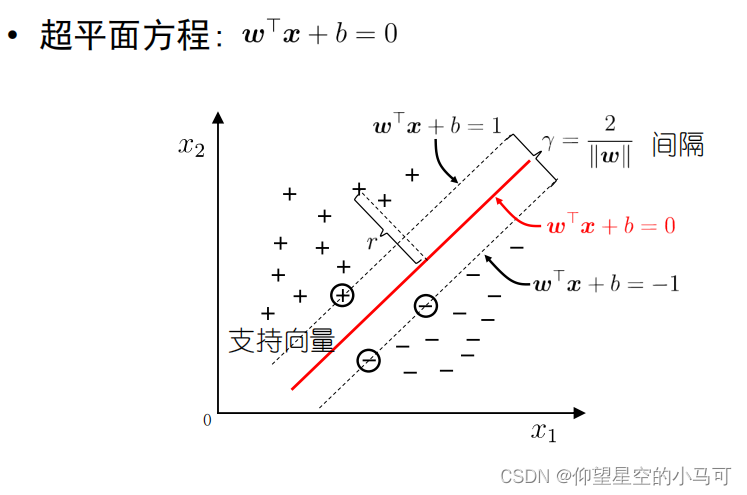

线性模型:在样本空间中寻找一个超平面,将不同类别的样本分开,由于分开的超平面可能有很多,寻找最优的一个,我们就可以用到SVM解决这个问题。

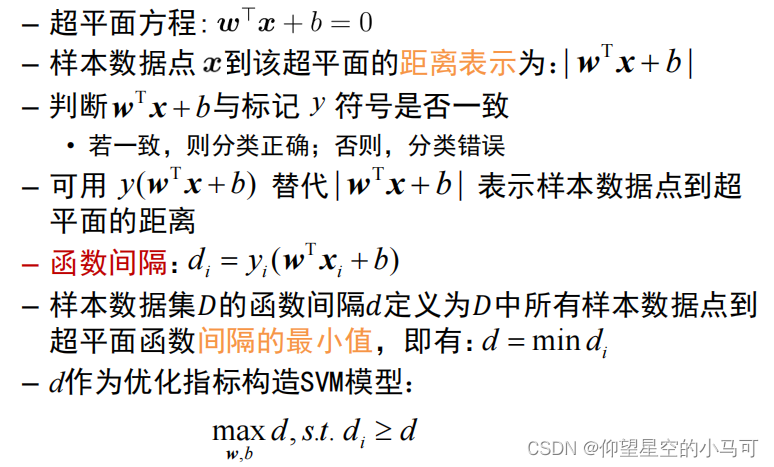

6.2.1 函数间隔:

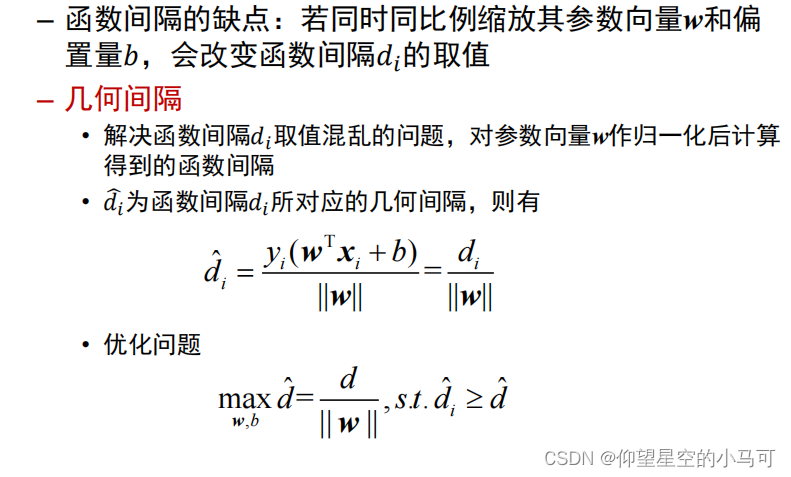

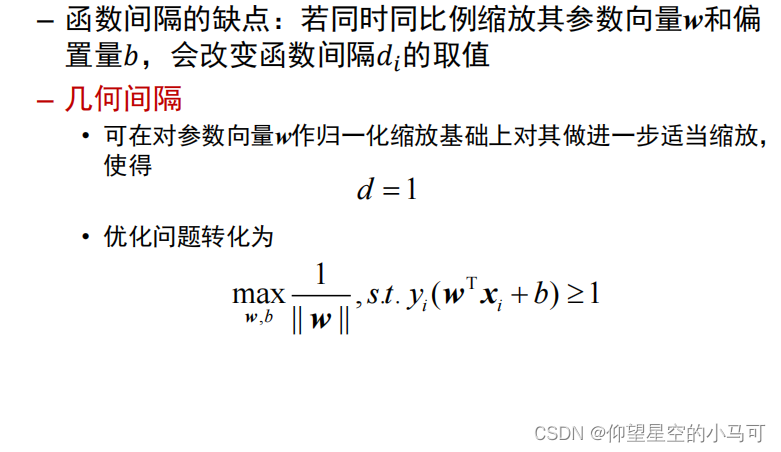

6.2.2 几何间隔

6.2.3 算法流程

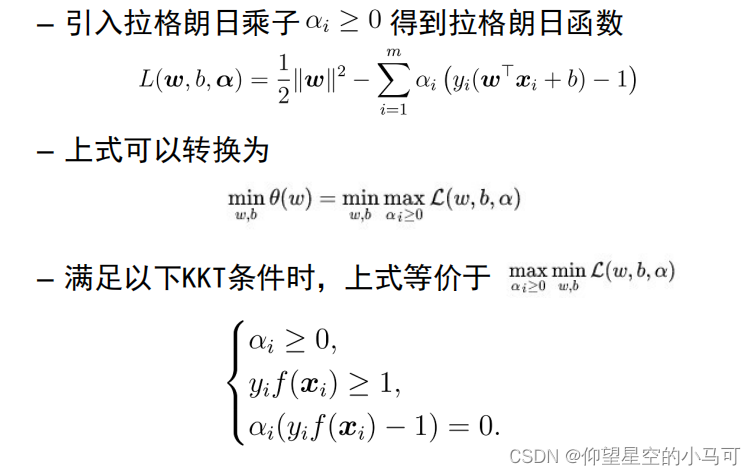

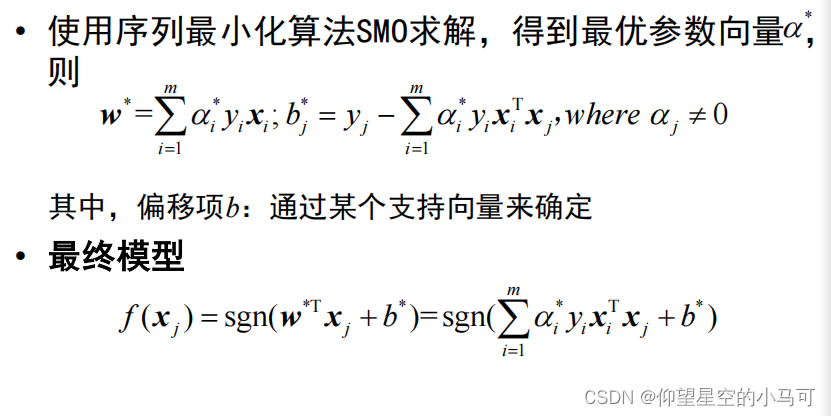

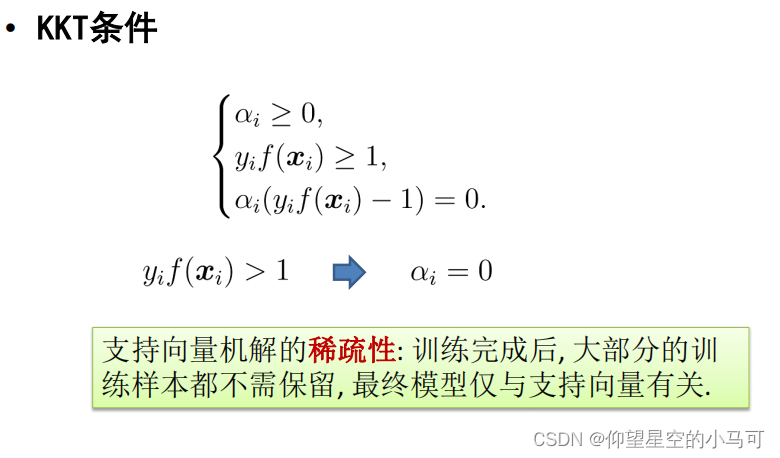

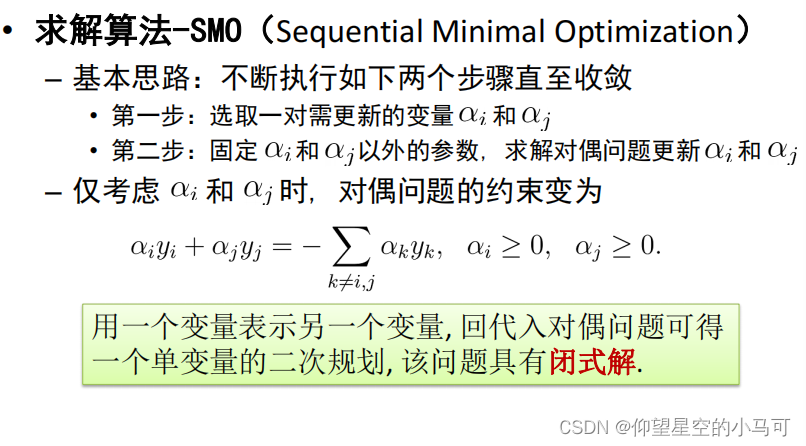

6.2.3.1 对偶问题

6.2.3.2 拉格朗日乘子法

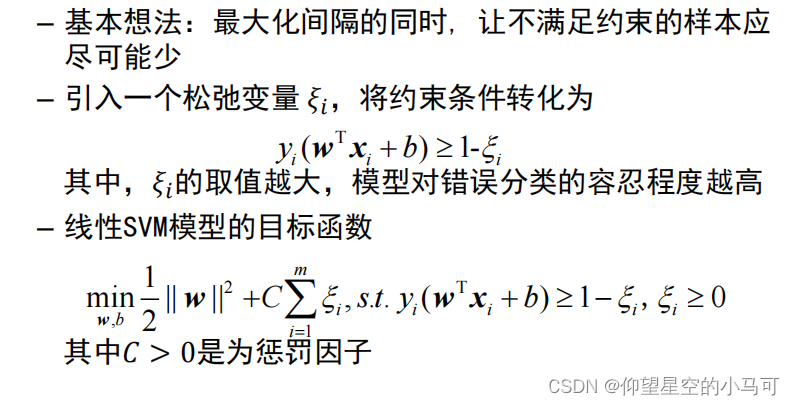

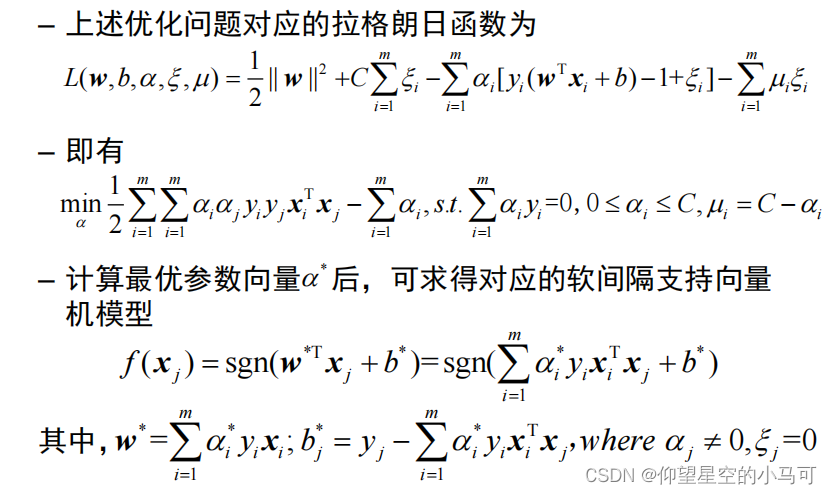

6.3 线性SVM与软间隔最大化

• 训练数据中有一些特异点(outlier),不能满足函数间隔大于等于1的约束条件

• 引入“软间隔”的概念, 允许支持向量机在一些样本上不满足约束

6.3.1 线性SVM模型

6.3.2 软间隔最大化

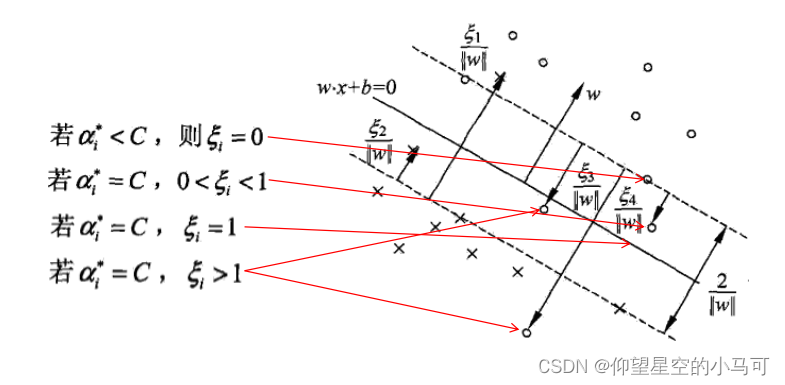

6.3.3 线性SVM的支持向量

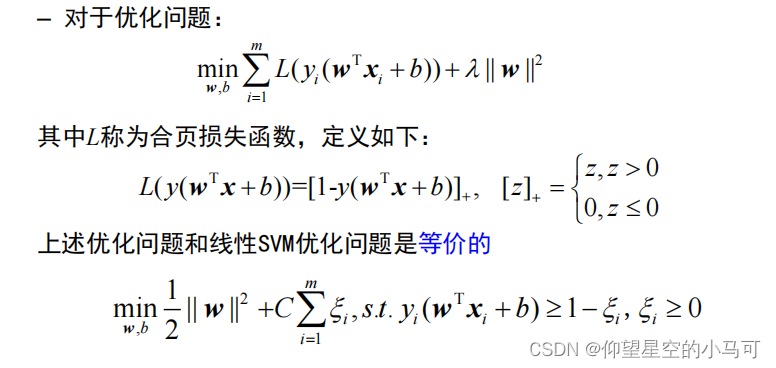

6.3.4 线性SVM的另一种解释:合页损失函数

1375

1375

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?