两个模型都是batch_size=8

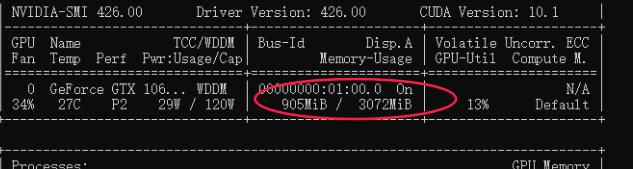

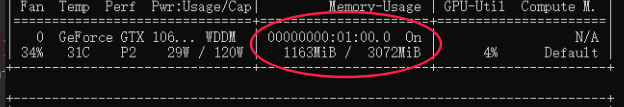

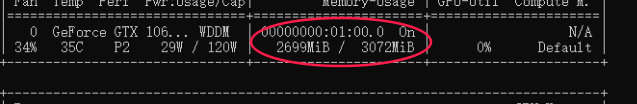

GPU原始使用量:

1、初始化模型一之后:

2、初始化模型二之后:

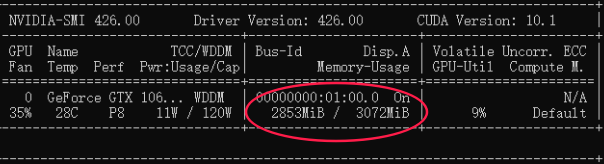

3、模型一推理一次8张图片之后:

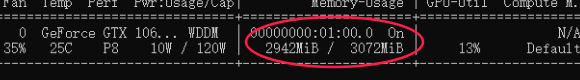

4、模型一再推理一次之后:

4、模型一再推理一次之后:

一下子占完了,后面再多次推理没问题。

**疑惑的地方,为什么第二次推理还要增加gpu的使用量,第一次运行按理说已经申请了内存啊** **??????**

5、模型二开始推理,就报不足,因为要申请gpu内存,模型一占却第二次推理时占完了:

File "D:\chl_files\anconda3\envs\pytorch_1.4\lib\site-packages\onnxruntime\capi\session.py", line 142, in run

return self._sess.run(output_names, input_feed, run_options)

onnxruntime.capi.onnxruntime_pybind11_state.RuntimeException: [ONNXRuntimeError] : 6 : RUNTIME_EXCEPTION : Non-zero status code returned while running Conv node. Name:'' Status Message: D:\3\s\onnxruntime\core\framework\bfc_arena.cc:114 onnxruntime::BFCArena::Extend Failed to allocate memory for requested buffer of size 134217728

解决方案:

改小两个模型的batch_size=6,就可以运行。

1897

1897

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?