1、机器学习的定义和解决的问题

1.1机器学习的定义

机器学习是赋予机器学习的能力,通过利用数据、模型训练、模型预测。

1.2机器学习解决的问题

1、分类问题:根据样本数据上提取一些特征,去判定其属于有限类别中的哪一个(类别是一个离散值)。比如垃圾邮件识别(结果类别:1、垃圾邮件 2、正常邮件)。

2、回归问题:根据样本数据上提取特征,预测一个连续值的结果。比如:预测电影票房。

3、聚类问题:根据数据样本抽取特征,让样本相近/相关的样本在一团体内。

分类和回归问题需要用已知结果的数据做训练,属于监督学习(监督学习要有样本和标签)

聚类的问题不需要标签,属于非监督学习(非监督学习只有数据没有标签)。

2、机器学习应用哪些领域,有哪些典型的应用?

机器学习应用在语音识别,自然语言处理,计算机视觉,电子商务等,制造业等。

机器学习典型应用:推荐系统、垃圾邮件分类

3、机器学习有哪些算法

1、回归算法

回归算法有两个重要的子类:线性回归、逻辑回归

线性回归拟合一条直线最佳匹配所有的数据,解决的是数值问题,也就是预测出来的是数字(回归问题),例如房价。而逻辑回归属于分类算法,预测出来的类别(分类问题),例如判断邮件是否为垃圾邮件,以及用户是否会点击此广告。

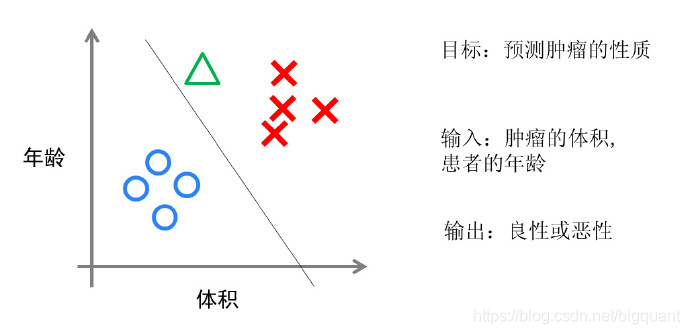

实现方面的话,逻辑回归只是对线性回归的计算结果上加上了一个Sigmoid函数,将数值结果转化为0~1之间的概率。例如在邮件预测中,概率大于0.5时,判定这封邮件是垃圾邮件。从直观上来说逻辑回归是画出了一条 分类线,如下图所示:

根据红蓝点我们训练出了一个逻辑回归模型,也就是图中的分类线,这时绿点出现在分类线的右侧,因此我们判断是红色。线性回归预测的值是线性的(直线),逻辑回归预测的基本上也都是线性的(也有划分为非线性分类线的逻辑回归,不过那样模型在模型数据较大的时候效率比较低)。这就意味着当两类之间的界线不是线性时,逻辑回归的表达能力不足(逻辑回归就是在线性回归上加上了Sigmoid函数,输出的是概率值)。下面的两个算法都可以拟合非线性的分类线。

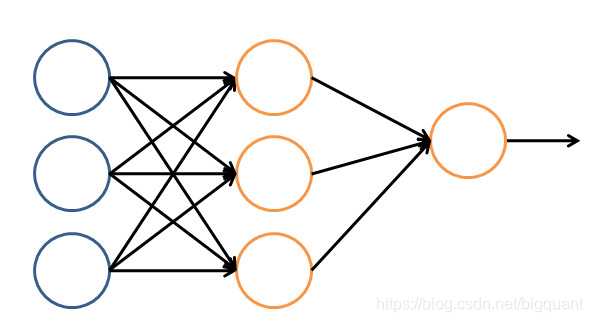

2.神经网络

下面是一个简单的神经网络的逻辑架构,在这个网络中,分成输入层、隐含层、输出层。输入层负责接收信号,隐含层负责数据的分解和处理,最后的结果被整合到输出层。

进入90年代,神经网络的发展进入了一个瓶颈期。其主要原因是尽管有BP算法的加速,神经网络的训练过程仍然很困难。因此90年代后期支持向量机(SVM)算法取代了神经网络的地位。

3.SVM(支持向量机)

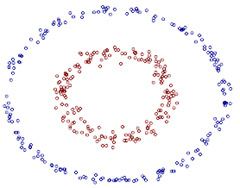

支持向量机诞生于统计学习界,同时在机器学习界大放光彩的经典算法。支持向量机在某种意义上来说是逻辑回归算法的强化,通过给予逻辑回归算法更严格的条件,支持向量机算法可以获得比逻辑回归更好的分类曲线。支持向量机通过跟高斯“核”的结合,支持向量机可以表达出非常复杂的分类界线,从而达到很好的分类效果。“核”事实上就是一种特殊的函数,最典型的特征就是可以将低维的特征映射到高维的空间。

我们如何在二维平面上划分出一个圆形的分类界线?在二维平面上可能会很困难,但是通过"核"可以将二维空间映射到三维空间,然后再使用一个线性平面就可以达到类似的效果。也就是说二维平面划分出的非线性界线可以等价于三维平面的线性分类界线。于是,我们可以通过在三维空间进行简单的线性划分就可以达到二维平面的非线性划分效果。

支持向量机是一种数学成分很浓的机器学习算法,在算法的核心步骤中,有一步证明,即将数据从低维映射到高维不会带来最后计算复杂性的提升。于是,通过支持向量机算法,既可以保持计算效率,又可以获得很好的分类效果。因此支持向量机在90年代后期一直占据着机器学习中最核心的地位,基本取代了神经网络算法。知道现在神经网络借着深度学习重新兴起,两者才又发生了微妙的平衡转变。

4.聚类算法

前面的算法中的一个显著的特征就是训练数据中包含了标签,训练出的模型可以对其他未知数据预测标签。

在下面的算法中,训练数据都是不含标签的,而算法的目的则是通过训练,推测出这些数据的标签。这类算法有一个统称,即无监督算法(前面有标签的数据的算法则是有监督算法)。无监督算法中最典型的代表就是聚类算法。

让我们还是拿一个二维的数据来说,某一个数据包含两个特征。我希望通过聚类算法,给他们中不同的种类打上标签,我该怎么做呢?简单来说,聚类算法就是计算种群中的距离,根据距离的远近将数据划分为多个族群。

聚类算法中最典型的代表就是K-Means算法。

5、降维算法

降维算法也是一种无监督学习算法,其主要特征是 将数据从高维降低到低维层次。在这里,维度其实表示的是数据的特征量的大小,例如,房价包含房子的长、宽、面积与房间数量四个特征,也就是维度为4维的数据。可以看出来,长与宽事实上与面积表示的信息重叠了,例如面积=长 × 宽。通过降维算法我们就可以去除冗余信息,将特征减少为面积与房间数量两个特征,即从4维的数据压缩到2维。于是我们将数据从高维降低到低维,不仅利于表示,同时在计算上也能带来加速。

刚才说的降维过程中减少的维度属于肉眼可视的层次,同时压缩也不会带来信息的损失(因为信息冗余了)。如果肉眼不可视,或者没有冗余的特征,降维算法也能工作,不过这样会带来一些信息的损失。但是,降维算法可以从数学上证明,从高维压缩到的低维中最大程度地保留了数据的信息。因此,使用降维算法仍然有很多的好处。

降维算法的主要作用是压缩数据与提升机器学习其他算法的效率。通过降维算法,可以将具有几千个特征的数据压缩至若干个特征。另外,降维算法的另一个好处是数据的可视化,例如将5维的数据压缩至2维,然后可以用二维平面来可视。降维算法的主要代表是PCA算法(即主成分分析算法)。

374

374

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?