前提准备

首先,我们要在一台纯净的CentOS7版本的linux虚拟机安装jdk,hadoop和zookeeper,配置好环境变量,这里如果不会,请看我另外两篇博客:

如何在linux虚拟机中安装hadoop,并搭建hadoop集群

如何在基于linux系统的hadoop集群中,安装配置hbase,hive,zookeeper

安装hadoop时请记得把 hadoop-native-64-2.6.0.tar 安装到hadoop安装路径的lib和lib/native目录下。

当然,这里的jdk,hadoop和zookeeper暂时还是单机安装。

我的配置

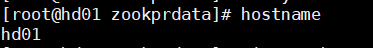

hostname

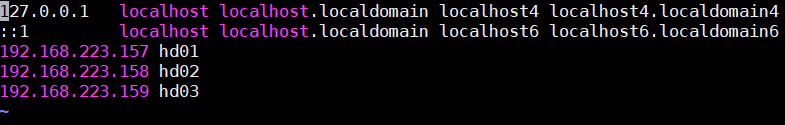

vi /etc/hosts

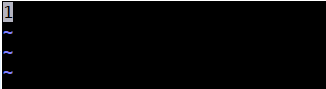

vi /opt/soft/zookpr/conf/zoo.cfg (zookeeper安装目录下conf中的zoo.cfg)

vi /opt/soft/hadoop/zookprdata/myid (对应上图中的配置目录和server节点)

开始搭建hadoop高可用集群

进入hadoop配置文件目录

cd /opt/soft/hadoop/etc/hadoop

修改hadoop配置:

vi mapred-site.xml

vi hdfs-site.xml

(这里的配置有点多,截图不方便,我直接贴了出来,但要注意把hostname和目录改成自己的,我这里是hd01,hd02,hd03三个hostname,以及/opt/soft/hadoop/data/jn这个目录。我们虽然还是单机安装,hd02,hd03还不存在,但这不影响我们这里的配置)

<configuration>

<property>

<name>dfs.nameservices</name>

<value>mycluster</value>

</property>

<property>

<name>dfs.ha.namenodes.mycluster</name>

<value>nn1,nn2</value>

</property>

<property>

<name>dfs.namenode.rpc-address.mycluster.nn1</name>

<value>hd01:9000</value>

</property>

<property>

<name>dfs.namenode.rpc-address.mycluster.nn2</name>

<value>hd02:9000</value>

</property>

<property>

<name>dfs.namenode.http-address.mycluster.nn1</name>

<value>hd01:50070</value>

</property>

<property>

<name>dfs.namenode.http-address.mycluster.nn2</name>

<value>hd02:50070</value>

</property>

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://hd01:8485;hd02:8485;hd03:8485/mycluster</value>

</property>

<property>

<name>dfs.ha.fencing.methods</name>

<value>sshfence</value>

</property>

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>/root/.ssh/id_rsa</value>

</property>

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/opt/soft/hadoop/data/jn</value>

</property>

<property>

<name>dfs.permissions.enable</name>

<value>false</value>

</property>

<property>

<name>dfs.client.failover.proxy.provider.mycluster</name> <value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hd03:50090</value>

</property>

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

</configuration>

vi core-site.xml

(注意把hostname和目录改成自己的,我这里是hd01,hd02,hd03三个hostname,以及/opt/soft/hadoop/tmp这个目录)

vi yarn-site.xml

(还是要注意把hostname改成自己的)

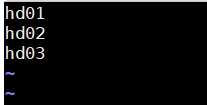

vi slaves

到这里单机搭建完成。

关掉虚拟机。

复制两台虚拟机,重新生成mac地址,修改ip地址,hostname(hd02和hd03),zookpr配置目录中的myid(hd02,hd03分别修改成2,3)。

在三台虚拟机中都分别执行以下两个命令:

ssh-keygen -t rsa -P “”

cat ~/.ssh/id_rsa.pub > ~/.ssh/authorized_keys

现在,我们要实现这三台虚拟机之间的免密连接。

在hd01上执行两个命令:

ssh-copy-id -i .ssh/id_rsa.pub -p22 root@hd02

ssh-copy-id -i .ssh/id_rsa.pub -p22 root@hd03

在hd02上执行两个命令:

ssh-copy-id -i .ssh/id_rsa.pub -p22 root@hd01

ssh-copy-id -i .ssh/id_rsa.pub -p22 root@hd03

在hd03上执行两个命令:

ssh-copy-id -i .ssh/id_rsa.pub -p22 root@hd01

ssh-copy-id -i .ssh/id_rsa.pub -p22 root@hd02

要求在任何一台虚拟机上使用"ssh root@[主机名或IP地址]" 连接另外两台时都不用输入密码。

到此为止,高可用集群配置完成。

初始化开启hadoop高可用集群

在三台虚拟机上都开启zookeeper和journalnode

/opt/soft/zookpr/bin/zkServer.sh start

hadoop-daemon.sh start journalnode

在hd01上:

hadoop namenode -format

hadoop-daemon.sh start namenode

在hd02上:

hdfs namenode -bootstrapStandby

hadoop-daemon.sh start namenode

然后在hd01上:

hadoop-daemons.sh start datanode

hdfs haadmin -transitionToActive nn1

stop-dfs.sh (关闭hdfs服务)

在三台虚拟机上都执行:

hdfs zkfc -formatZK

然后在hd01上:

start-all.sh

然后分别在三台虚拟机上用jps命令:列出本机所有java进程的pid

可能在hd02上会缺少 ResourceManager 那就再在hd02上执行命令:

start-yarn.sh

最后三台虚拟机jps后应该是这样:

再到浏览器查看三个地址:

192.168.223.157:50070

192.168.223.158:50070

192.168.223.157:8088

大功告成了!

725

725

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?