逻辑回归虽然叫做回归,但是它实际上做的是分类任务。以下是逻辑回归的一些基础知识。

1. 交叉熵推导

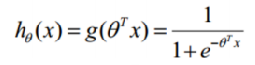

Sigmoid公式为:

g

(

z

)

=

1

1

+

e

−

z

g(z)=\frac{1}{1+e^{-z}}

g(z)=1+e−z1

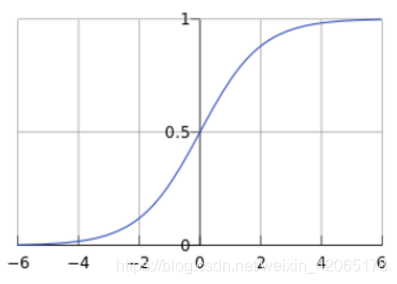

图像为:

因为Sigmoid函数的定义域为(

−

∞

-\infty

−∞,

+

∞

+\infty

+∞),值域为(0,1),概率正好也是这个区间,因此很适用于二分类问题。z相当于线性回归中的预测值,将其输入Sigmoid函数中就可以得到预测概率,有以下公式:

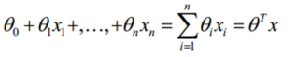

其中:

相当于线性回归中拟合函数。

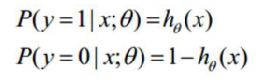

那么分类任务可写为:

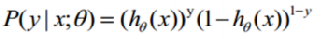

将其整合有:

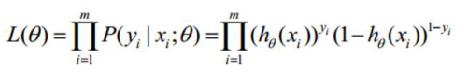

概率,乘法,让人想起似然函数:

似然函数的目的就是,寻找到最适合模型的参数θ,使最后的概率值最大。

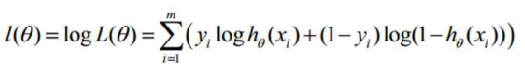

取对数似然,有:

l

(

θ

)

l(θ)

l(θ)的导数为正数,因此需要引入

−

1

m

-\frac{1}{m}

−m1将其转化为可用梯度下降来解决的任务:

J

(

θ

)

=

−

1

m

∑

i

=

1

m

(

y

i

l

o

g

h

θ

(

x

i

)

+

(

1

−

y

i

)

l

o

g

(

1

−

h

θ

(

x

i

)

)

)

J(θ)=-\frac{1}{m}\sum_{i=1}^m(y_ilogh_θ(x_i)+(1-y_i)log(1-h_θ(x_i)))

J(θ)=−m1i=1∑m(yiloghθ(xi)+(1−yi)log(1−hθ(xi)))

这就推导出了交叉熵损失函数的公式。

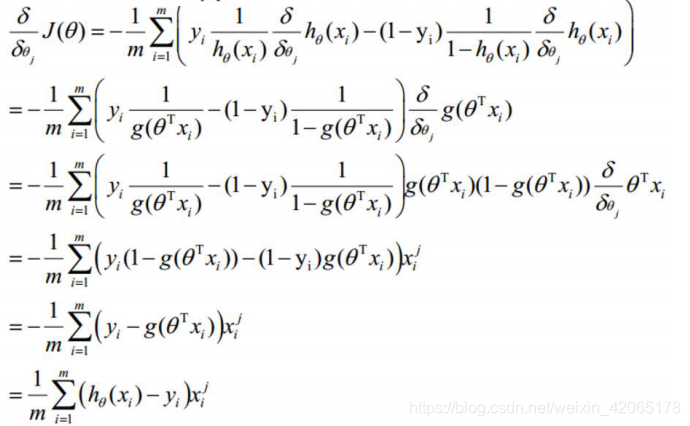

2.交叉熵(损失函数)求导过程

522

522

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?