1.下载ppocr的方向、检测、识别推理模型

推理模型是指人家已经训练好的,你直接可以拿来用的模型。

下载地址:

或者

或者可以使用官方的linux指令进行下来,这里我先下载到了windows里面来,因为我用的是ssh远程连接linux,可以将win的文件拖入到linux系统中,正常情况下请在linux系统中直接使用命令行下载,官方的git里面有下载方法。按照下图点击“推理模型”进行下载即可,此处下载的是中文检测、识别模型以及方向分类模型:

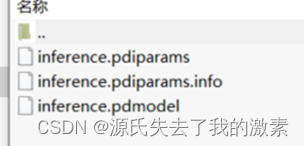

下载好的安装包打开查看一下,其中inference.pdiparams为模型参数文件,inference.pdmodel为模型结构文件,也就是我们的模型。这两个文件在转换onnx的时候都要用到。

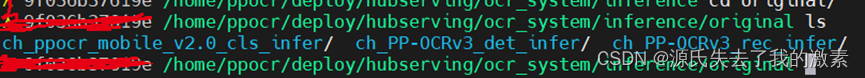

在下载好三个推理模型后,将三个文件包放入到我们的linux里面来,可以在win解压放进去,也可以在linux里面再进行解压。

二、Paddle2onnx转换

1.安装Paddle2onnx:

现阶段的paddle框架转其他部署框架只能通过paddle2onnx再转其他框架实现。因此我们需要安装Paddle2onnx,这里推荐直接使用安装语句:

pip3 install paddle2onnx

2.Paddle2onnx转换

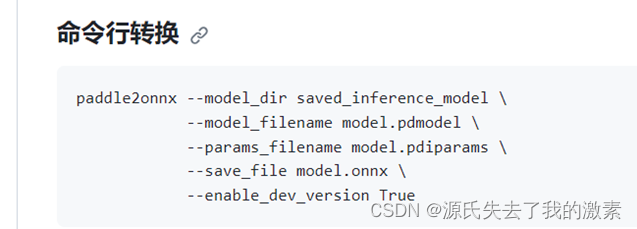

在paddle2onnx的git网站GitHub - PaddlePaddle/Paddle2ONNX: ONNX Model Exporter for PaddlePaddle 可以看到其转换指令,其中:

| --model_dir | 保存模型的路径 | |

| --model_filename | 模型结构 inference.pdmode文件 | 这两个文件在1. 下载ppocr的方向、检测、识别推理模型中均有介绍 |

| --params_filename | 模型参数 inference.pdiparams文件 | 这两个文件在1. 下载ppocr的方向、检测、识别推理模型中均有介绍 |

| --save_file | 保存onnx文件的路径以及保存onnx文件的名称 | |

| --enable_dev_version | 是否使用新版本 Paddle2ONNX(推荐使用),默认为 True |

3.Paddle3onnx 模型转换

完成上述操作与学习,即可开始转换模型,在original当前目录下,分别使用指令转换,此处以方向检测推理模型为例,其中保存目录为dl_onnc/:

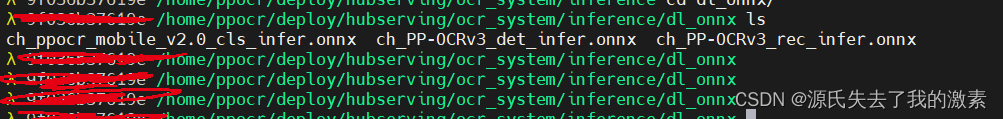

paddle2onnx --model_dir original/ch_ppocr_mobile_v2.0_cls_infer --model_filename inference.pave_file dl_onnx//ch_ppocr_mobile_v2.0_cls_infer.onnx --enable_dev_version True可以查看转换结果:

514

514

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?