所属类别:

监督学习之聚类算法

原理:

KNN是通过测量不同特征值之间的距离进行分类。即,如果一个样本在特征空间中的k个最相似(最邻近)的样本中的大多数属于某一个类别,则该样本也属于这个类别。其中k通常是不大于20的整数。

例子:

在如上图形中,要求判断绿色的园应当被划分到哪个类别。

如果k=3,即根据与绿色园最近邻的三个形状来划分它的所属类别。由于与其最近邻的三个图形中红色三角形所占比例为2/3,蓝色正方形所占比例为1/3,故绿色园应当被划分到红色三角形的那一类中去。

如果k=5,即根据与绿色园最近邻的五个形状来划分它的所属类别。由于与其最近邻的五个图形中红色三角形所占比例为2/5,蓝色正方形所占比例为3/5,故绿色园应当被划分到蓝色正方形的那一类中去。

由此可见,KNN算法的结果很大成都取决于k的取值。

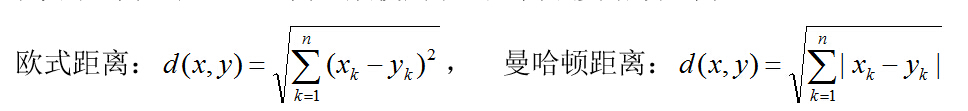

在KNN中,常用对象之间的距离作为各个对象之间的非相似性指标。其中的距离一般使用欧式距离或者曼哈顿距离:

算法步骤:

1.计算测试数据与其它各个训练数据之间的距离。

2.按照距离递增关系进行排序。

3.选取距离最小的k个点。

4.确定前k个点所在类别的出现频率。

5.返回前k个点中出现频率最高的类别作为测试数据的预测类别。

python实现:

import numpy as np

import operator

#创建数据集

def createDataSet():

# 四组二维特征

group=np.array([[1.0,2.0],[1.3,0.2],[0.2,1.3],[0.3,3.4]])

# 四组特征的标签

labels=['a','a','b','b']

return group,labels

# kNN算法,分类器

def classify(inX,dataSet,labels,k):

# numpy函数shape[0]返回dataSet的行数

dataSetSize = dataSet.shape[0]

# 在列向量方向上重复inX共1次(横向),行向量方向上重复inX共dataSetSize次(纵向)

diffMat = np.tile(inX, (dataSetSize, 1)) - dataSet

# 二维特征相减后平方

sqDiffMat = diffMat ** 2

# sum()所有元素相加,sum(0)列相加,sum(1)行相加

sqDistances = sqDiffMat.sum(axis=1)

# 开方,计算出距离

distances = sqDistances ** 0.5

# 返回distances中元素从小到大排序后的索引值

sortedDistIndices = distances.argsort()

# 定一个记录类别次数的字典

classCount = {}

for i in range(k):

# 取出前k个元素的类别

voteIlabel = labels[sortedDistIndices[i]]

# dict.get(key,default=None),字典的get()方法,返回指定键的值,如果值不在字典中返回默认值。

# 计算类别次数

classCount[voteIlabel] = classCount.get(voteIlabel, 0) + 1

# python3中用items()替换python2中的iteritems()

# key=operator.itemgetter(1)根据字典的值进行排序

# key=operator.itemgetter(0)根据字典的键进行排序

# reverse降序排序字典

sortedClassCount = sorted(classCount.items(), key=operator.itemgetter(1), reverse=True)

# 返回次数最多的类别,即所要分类的类别

return sortedClassCount[0][0]

if __name__ == '__main__':

# 创建数据集

group, labels = createDataSet()

# 测试集

test = [1.1, 0.2]

# kNN分类

test_class = classify(test, group, labels, 3)

# 打印分类结果

print(test_class)

由于k-近邻算法没有进行数据的训练,直接使用未知的数据与已知的数据进行比较,得到结果。因此,可以说k-近邻算法不具有显式的学习过程。

手写数字识别系统(sklearn实现):

sklearn官方文档

数据集下载

数字图片是32x32的二进制图像,为了方便计算,我们可以将32x32的二进制图像转换为1x1024的向量。

import numpy as np

import operator

from os import listdir

from sklearn.neighbors import KNeighborsClassifier as kNN

#将32x32的二进制图像转换为1x1024向量。

def img2vector(filename):

#创建1x1024零向量

returnVect = np.zeros((1, 1024))

#打开文件

fr = open(filename)

#按行读取

for i in range(32):

#读一行数据

lineStr = fr.readline()

#每一行的前32个元素依次添加到returnVect中

for j in range(32):

returnVect[0, 32*i+j] = int(lineStr[j])

#返回转换后的1x1024向量

return returnVect

#手写数字分类测试

def handwritingClassTest():

#测试集的Labels

hwLabels = []

#返回trainingDigits目录下的文件名

trainingFileList = listdir('trainingDigits')

#返回文件夹下文件的个数

m = len(trainingFileList)

#初始化训练的Mat矩阵,测试集

trainingMat = np.zeros((m, 1024))

#从文件名中解析出训练集的类别

for i in range(m):

#获得文件的名字

fileNameStr = trainingFileList[i]

#获得分类的数字

classNumber = int(fileNameStr.split('_')[0])

#将获得的类别添加到hwLabels中

hwLabels.append(classNumber)

#将每一个文件的1x1024数据存储到trainingMat矩阵中

trainingMat[i,:] = img2vector('trainingDigits/%s' % (fileNameStr))

#构建kNN分类器

neigh = kNN(n_neighbors = 3, algorithm = 'auto')

#拟合模型, trainingMat为训练矩阵,hwLabels为对应的标签

neigh.fit(trainingMat, hwLabels)

#返回testDigits目录下的文件列表

testFileList = listdir('testDigits')

#错误检测计数

errorCount = 0.0

#测试数据的数量

mTest = len(testFileList)

#从文件中解析出测试集的类别并进行分类测试

for i in range(mTest):

#获得文件的名字

fileNameStr = testFileList[i]

#获得分类的数字

classNumber = int(fileNameStr.split('_')[0])

#获得测试集的1x1024向量,用于训练

vectorUnderTest = img2vector('testDigits/%s' % (fileNameStr))

#获得预测结果

# classifierResult = classify0(vectorUnderTest, trainingMat, hwLabels, 3)

classifierResult = neigh.predict(vectorUnderTest)

print("分类返回结果为%d\t真实结果为%d" % (classifierResult, classNumber))

if(classifierResult != classNumber):

errorCount += 1.0

print("总共错了%d个数据\n错误率为%f%%" % (errorCount, errorCount/mTest * 100))

if __name__ == '__main__':

handwritingClassTest()

400

400

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?