一、随机变量的相互独立性

(一)概念

*注:事件独立是变量独立的基础,原因是X∈x,Y∈y

(二)相互独立的充要条件

1、联合分布等于边缘分布乘积

2、概率密度等于边缘密度乘积

(三)独立变量的分布可加性

二、随机变量的相关性

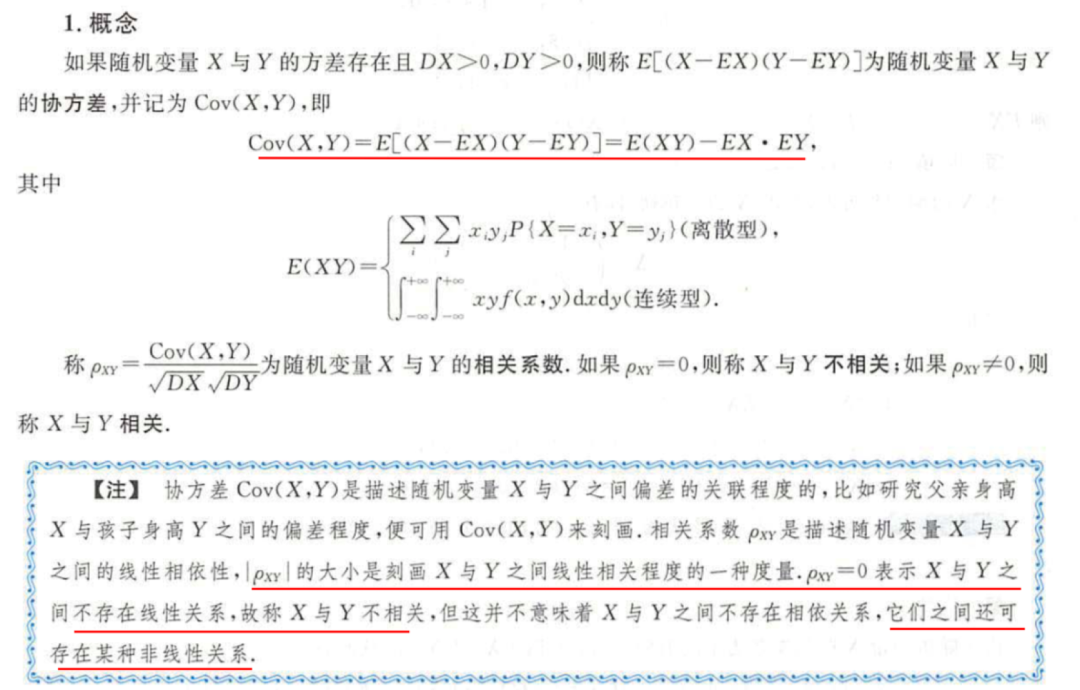

(一)概念

三、不相关和相互独立的判定

在期望中有两条关于独立的性质:a. 独立⇒EXY = EY·EXb. 独立⇒D( X+Y ) = DY + DX - 2Cov( X,Y )由于X、Y的相关性取决于COV (X,Y) ,计算式为EXY - EYEX,这步容易搞混淆,即“变量不相关不能推出独立”的结论(除非(X,Y)服从正态分布、X和Y服从0-1分布)。具体判定过程如下:1、不相关的判定是相关系数或协方差系数是否等于0,或者EXY - EY·EX=0。

2、相互独立的判定需要利用变量的分布判定,即联合分布是否等于各边缘分布之积、概率密度是否等于边缘概率密度之积。

3、事件独立⇒变量独立⇒变量不相关,若变量相关,则不独立。(这里和级数敛散性判定一样)

参考文献

[1]李林.概率论与数理统计辅导讲义.国家开放大学出版社.2020.4

[2]李林.精讲精练880题(数学三).国家开放大学出版社.2020.5

[3]张宇.考研数学基础三十讲.高等教育出版社.2019.8

[5]张宇.题源探析经典1000题(数学三).北京理工大学出版社.2020.3

[6]张宇.考研数学闭关修炼.中国政法大学出版社.2020.5

本文探讨了随机变量的相互独立性及其充要条件,包括联合分布与边缘分布的关系,以及概率密度的性质。同时,阐述了随机变量的相关性概念,指出不相关与独立之间的区别和联系,强调了事件独立、变量独立与不相关的递进关系,并提供了相关判定方法。内容参考了多本概率论与数理统计的教材。

本文探讨了随机变量的相互独立性及其充要条件,包括联合分布与边缘分布的关系,以及概率密度的性质。同时,阐述了随机变量的相关性概念,指出不相关与独立之间的区别和联系,强调了事件独立、变量独立与不相关的递进关系,并提供了相关判定方法。内容参考了多本概率论与数理统计的教材。

490

490

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?