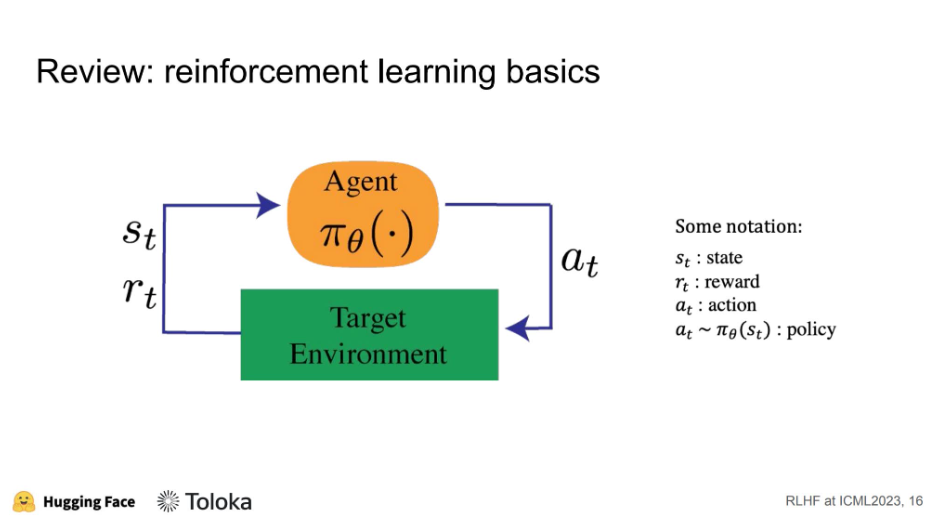

人类反馈强化学习(RLHF)是近年来越来越受欢迎的机器学习方法,这种方法能让智能系统在环境中学习,以最大化某种特定目标,目前用于提高大语言模型的性能。

这种方法通过引入“奖励”和“惩罚”信号,让系统自行探索环境并采取最佳行动策略,很大程度上减轻了传统强化学习中需要大量试错的问题,让智能系统可以更快速高效学习。

今天要和大家分享的资料自然就是关于人类反馈强化学习的,是来自Hugging Face研究科学家 Nathan Lambert和Toloka AI Dmitry Ustalov在ICML 2023上的教程《Reinforcement Learning from Human Feedback: A Tutorial》讲解。

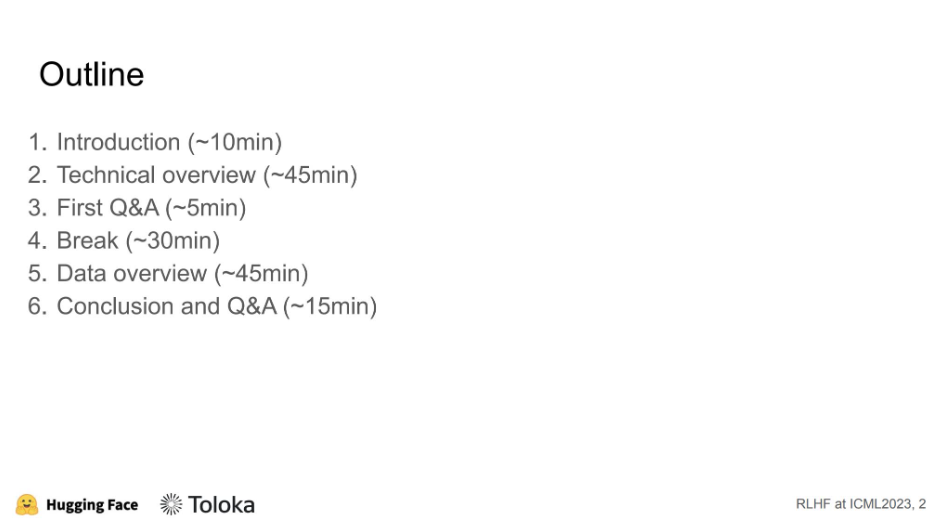

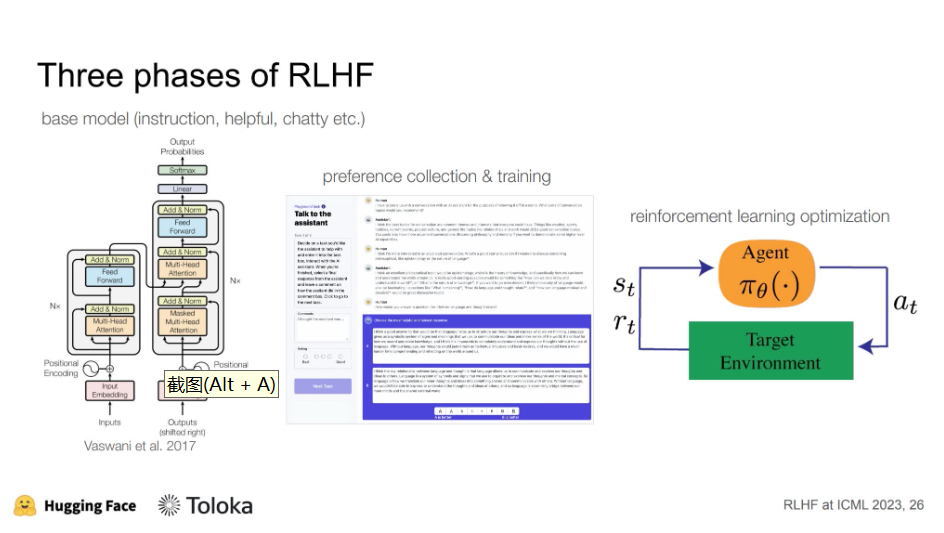

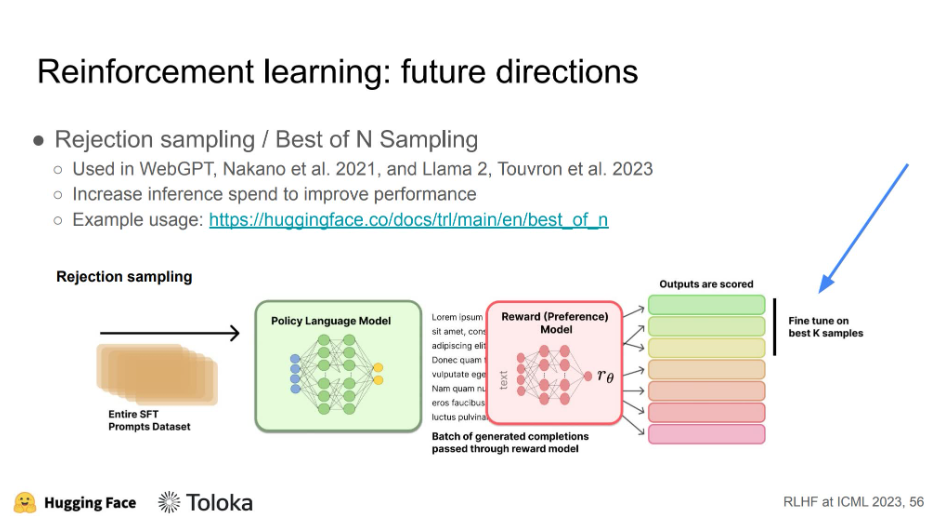

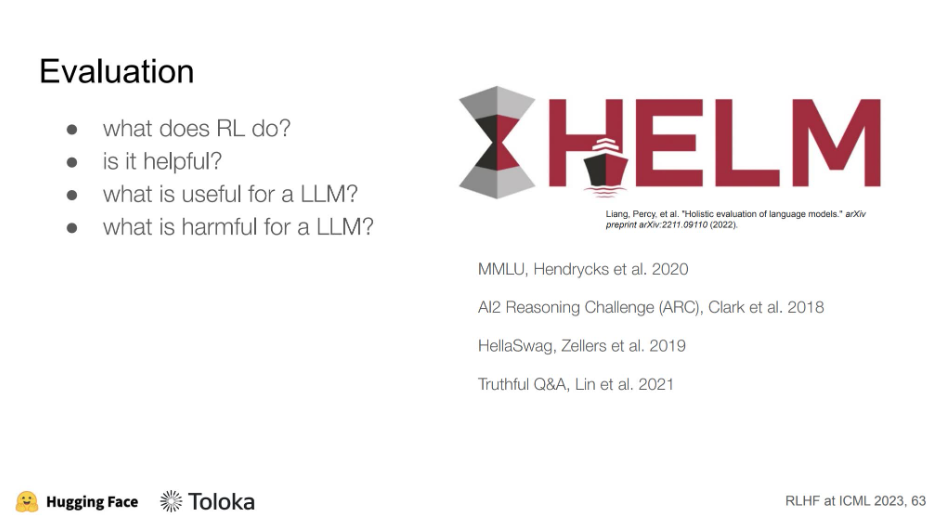

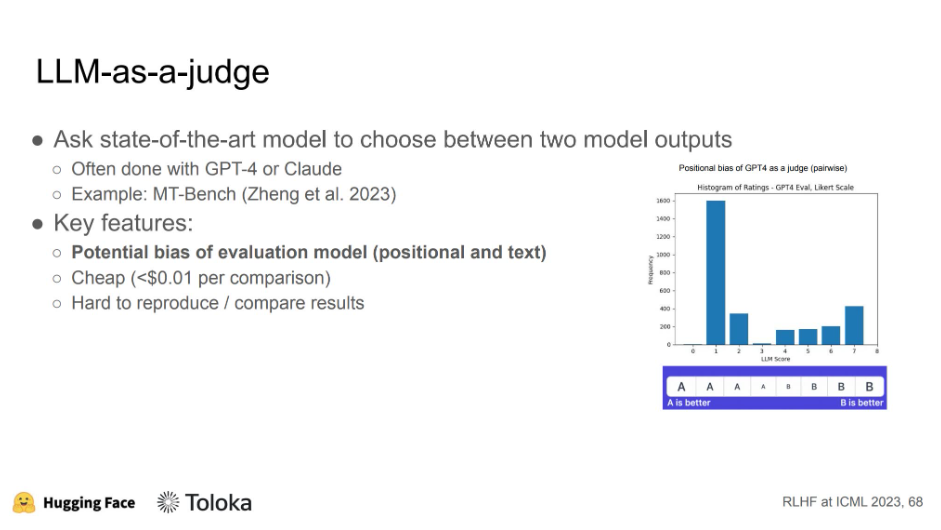

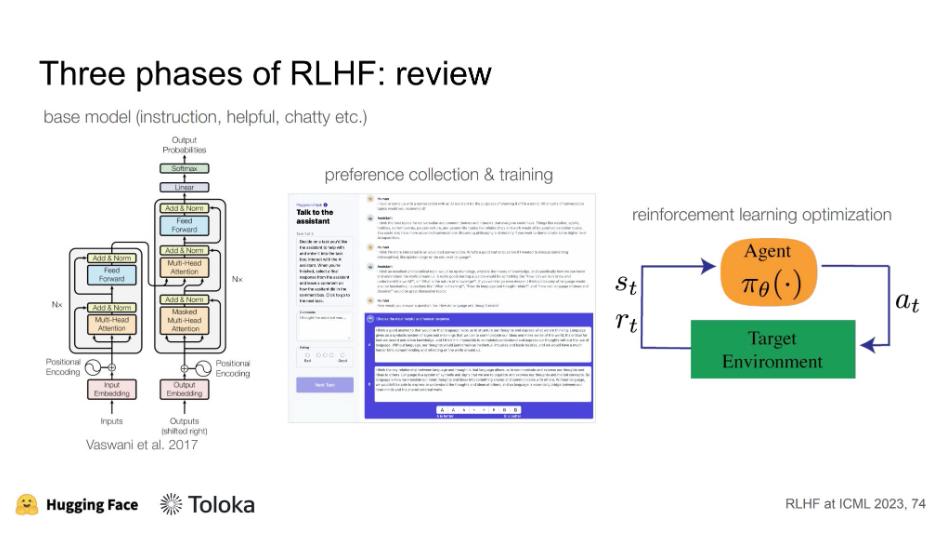

这份宝藏教程涵盖了一个成功的RLHF项目的两个核心部分:RLHF背后的核心机器学习技术,以及用于收集人类反馈数据的人在循环中的方法。

教程共167页,全面详细地解析了人类反馈强化学习,附47分钟的讲解视频,学完相信同学们会对人类反馈强化学习有更深刻的了解。

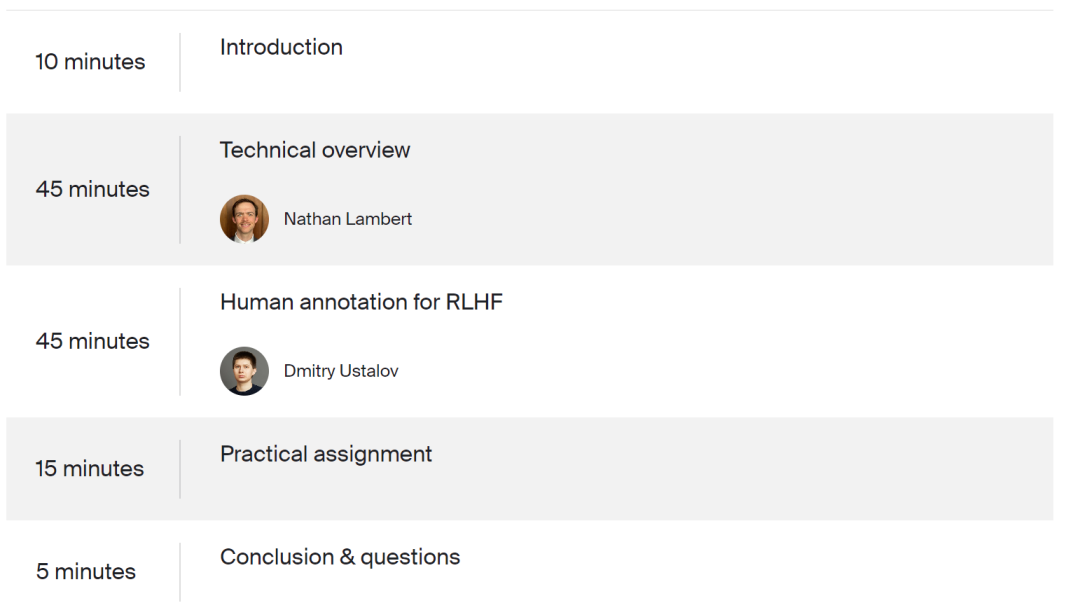

教程概述

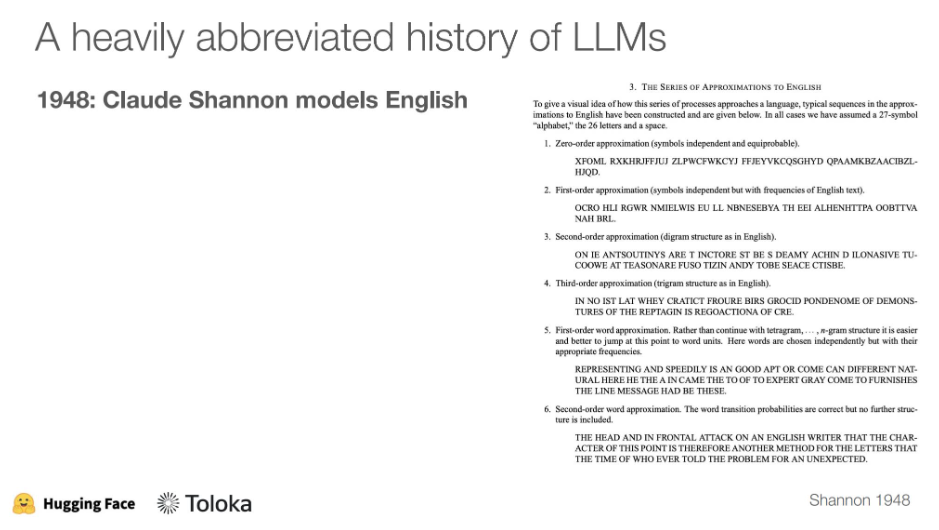

教程部分内容

关注下方《学姐带你玩AI》🚀🚀🚀

回复“RLHF”免费领取完整基教程+讲解视频

码字不易,欢迎大家点赞评论收藏!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?