今天盘点了 ICLR 2024 顶会中有关多模态融合领域的最新研究成果,共22篇,方便同学们更高效地了解最新的融合方法、快速获得论文创新点的启发。

论文主要涉及大模型+多模态融合、自动选择和构建模态、视觉Transformer的3D对象检测、动态多模态融合的深度平衡、基于Transformer的系统融合方法等热门主题。

论文和代码需要的同学看文末

1.Progressive Fusion for Multimodal Integration

多模态融合的渐进式融合

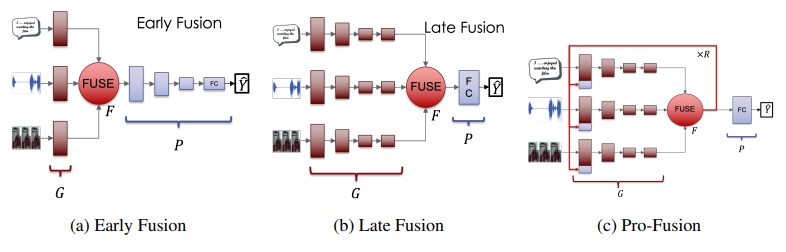

简述:多模态信息融合可以提升机器学习模型的性能。通常,模型会分别处理不同模态的数据,然后再将这些信息合并。但这种方法可能会丢失一些信息。另一方面,早期就将不同模态的信息合并的方法又会有特征不一致和样本复杂度高的问题。本文提出了一种叫做“渐进融合”的方法,通过在模型的不同层次之间建立联系,使得深层融合的信息能够被浅层使用,这样既避免了信息丢失,又保持了后融合的优点。作者在多个任务上测试了这个方法,并证明了它的有效性和通用性。

2.Orthogonal Sequential Fusion in Multimodal Learning

多模态学习中的正交序列融合

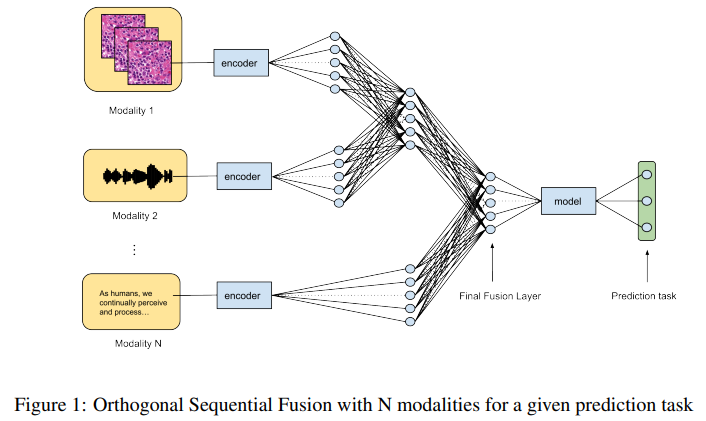

简述:多模态学习中,将不同来源的数据整合起来是一大挑战。传统方法通常是一次性融合所有数据,这可能会导致不同数据类型的表示不均匀。本文提出了一种新的融合方法,叫做正交顺序融合(OSF),它按顺序一步步合并数据,并且可以对不同类型的数据进行选择性加权。这种方法还可以增强正交性,也就是提取每种数据类型的独特信息。作者们通过不同的应用展示了这种方法的有效性,并证明了它在准确性上优于其他融合技术。

这篇文章总结了ICLR2024会议中关于多模态融合领域的22篇重要论文,涵盖了大模型融合、自动模态选择、3D对象检测、动态融合平衡、Transformer融合方法等多个热点话题。研究者们提出了创新的融合策略,如渐进融合、正交序列融合和平衡多任务框架,以解决信息丢失、特征不一致等问题,以及在处理缺失模态和不平衡数据方面的解决方案。

这篇文章总结了ICLR2024会议中关于多模态融合领域的22篇重要论文,涵盖了大模型融合、自动模态选择、3D对象检测、动态融合平衡、Transformer融合方法等多个热点话题。研究者们提出了创新的融合策略,如渐进融合、正交序列融合和平衡多任务框架,以解决信息丢失、特征不一致等问题,以及在处理缺失模态和不平衡数据方面的解决方案。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

489

489

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?