作为机器学习中的一个重要步骤,特征选择可以从原始特征集中挑选出最相关、最有用的特征,以构建更加准确、高效和可解释的模型。

这种优势让它在提高模型性能,减少过拟合并降低计算成本方面遥遥领先,也因此被图像处理、金融风险评估、医疗诊断等领域广泛应用,相关研究数目繁多,且基本都是围绕特征选择的4大类主流方法:过滤法、包装法、嵌入法、混合法展开,可谓是成果颇丰。比如SCIS上的进化多目标方法DDFS,以及Nature子刊上结合bGGO算法的深度学习方法。

本文介绍这4大类主流特征选择方法,每一类都举例了代表性方案,方便同学们理解并pick合适的方法,高效涨点。如果大家有需要发论文,也可以直接看我总结好的10种特征选择创新方案,基本都是最新的,也有代码。

全部方案+开源代码需要的同学看文末

Filter(过滤法)

按照发散性或相关性对各个特征进行评分,设定阈值或者待选择特征的个数进行筛选。这种方法不考虑模型的复杂性和预测能力,只根据数据的统计属性来评估特征的重要性。比如,可以使用卡方检验、互信息、方差分析等统计度量来选择特征。

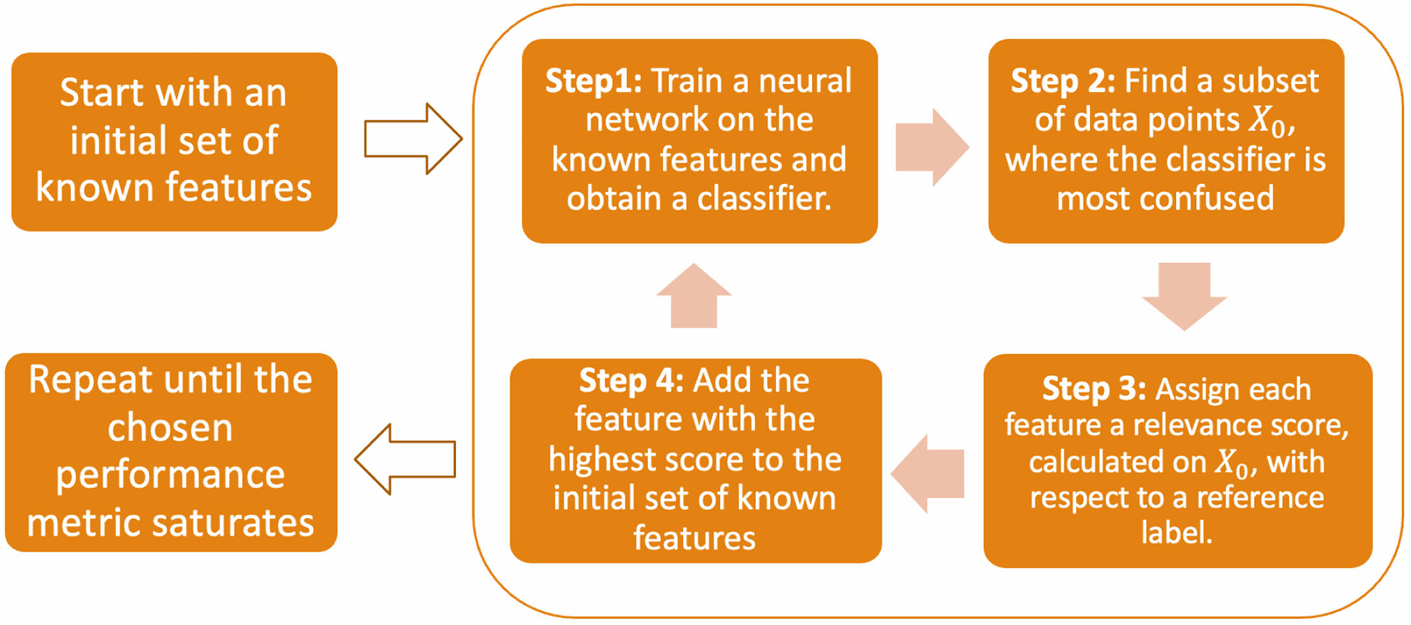

创新方法:DisCo-FFS

一种基于距离相关性的特征选择方法,用于在高能物理领域中的机器学习任务,特别是顶夸克标记问题。该方法通过评估特征与分类器输出之间的统计依赖性,从大量理论驱动的特征集合中选择出与分类任务最相关的特征子集。

具体来说,DisCo-FFS使用距离相关性作为评分函数,衡量给定特征集对于分类器输出的相关性,然后迭代地选择最能提高分类性能的特征。

Wrapper(包装法)

根据目标函数,每次选择若干特征,或者排除若干特征。这种方法将特征选择过程视为模型选择过程的一部分,通过搜索特征子集的不同组合来评估模型的性能,通常涉及到模型的训练和验证。

包装法通常比过滤法更耗时,但能找到更适合特定模型的特征子集。常见的包装法包括递归特征消除、前向选择和后向消除等。

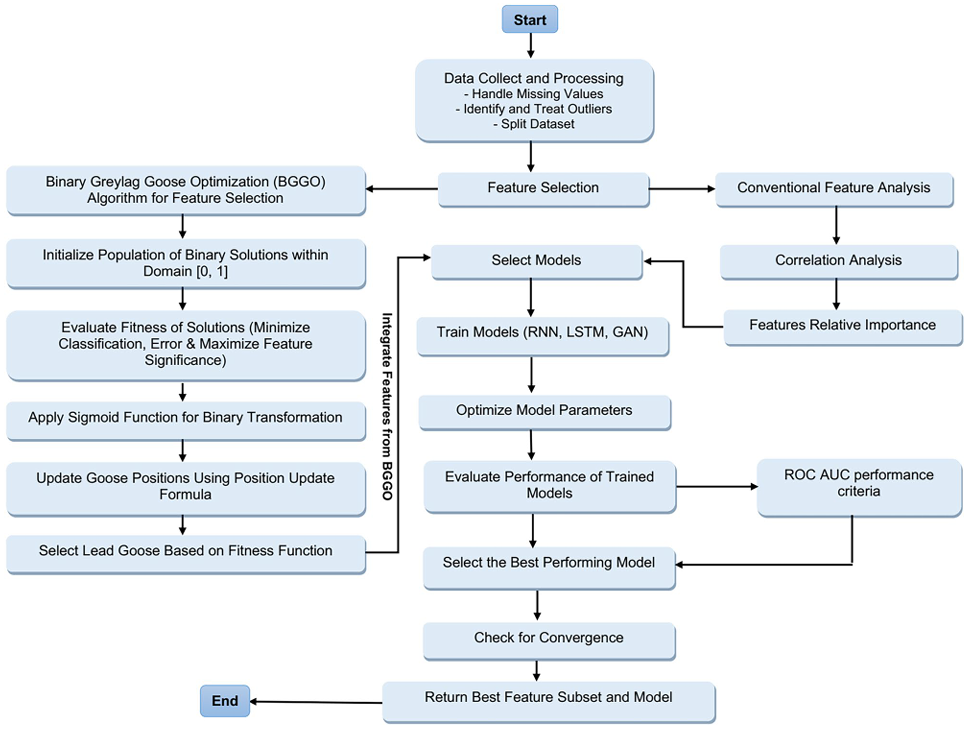

创新方法:结合bGGO

通过结合二进制灰雁优化(bGGO)算法进行特征选择,特别是生成对抗网络(GAN),以提高斜坡稳定性分类的准确性。通过这种方法,我们能够识别出影响斜坡稳定性的关键因素,并利用这些因素训练模型,最终实现了在斜坡稳定性评估中具有竞争性能的高准确率(在627个样本的数据集上达到了95%的准确率)。

Embedded(嵌入法)

先使用某些机器学习的模型进行训练,得到各个特征的权值系数,根据系数从大到小选择特征。这种方法在模型训练过程中进行特征选择,模型的参数或结构会提供关于特征重要性的信息,可以用来选择特征。比如,决策树和它的衍生算法在构建过程中就会进行特征选择。

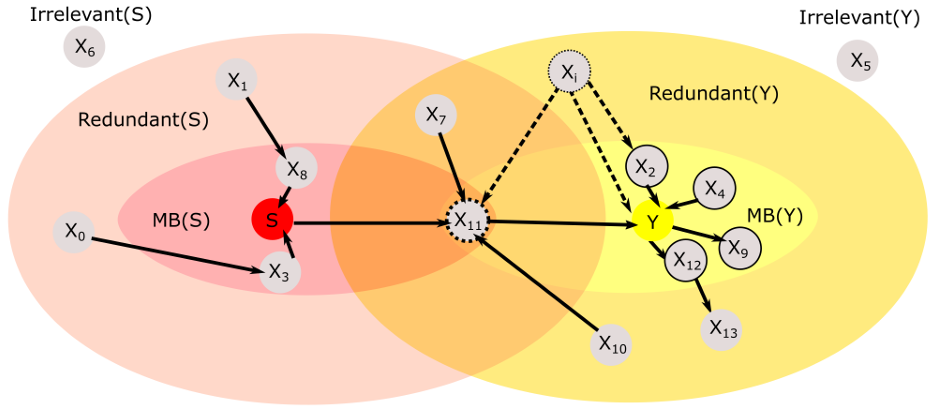

创新方法:SFCF

一种新的在线特征选择方法,在五个数据集上实现了平均EO提升52%、稀疏性提升98%和运行时间减少99%的显著性能提升。

具体来说,SFCF(Structure-based Fair Feature Selection)通过构建两个因果图来模拟特征、标签和受保护信息之间的复杂关系,并移除那些与受保护特征因果相关但与标签无关的特征,以消除偏见。此外,它还考虑了在大量特征被移除时,原本对预测多余的特征可能变得可接受的情况,从而在准确性和公平性之间取得平衡。

Hybrid(混合法)

结合了过滤法、包装法和嵌入法等多种特征选择方法,通过多阶段或并行的方式,充分利用各种方法的优点,旨在提高特征选择的准确性和稳定性。这种方法优势在于,它不仅能够快速去除无关特征,还可以通过复杂的模型评估来选择最佳的特征子集,从而提高模型的性能和泛化能力。

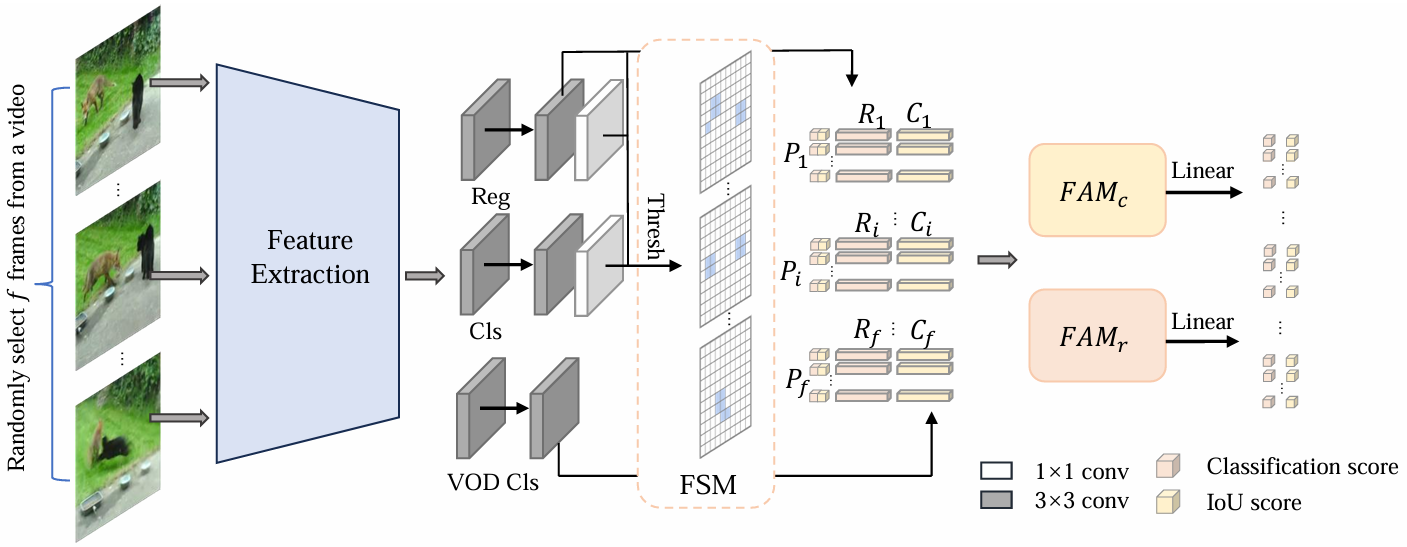

创新方法:YOLOV++

一种实用视频对象检测方法,通过特征选择和聚合策略,在保持计算效率的同时显著提高了检测准确性。具体来说,它首先使用特征选择模块减少候选特征的数量,然后通过特征聚合模块利用目标帧与参考帧之间的关系来指导特征的聚合,从而有效地利用视频帧间的时间信息,以提高检测性能。

在ImageNet VID数据集上,YOLOV++使用单个3090 GPU实现了92.9%的AP50准确率,同时保持超过30 FPS的推理速度。

关注下方《学姐带你玩AI》🚀🚀🚀

回复“特征选择”获取全部方案+开源代码

码字不易,欢迎大家点赞评论收藏

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?