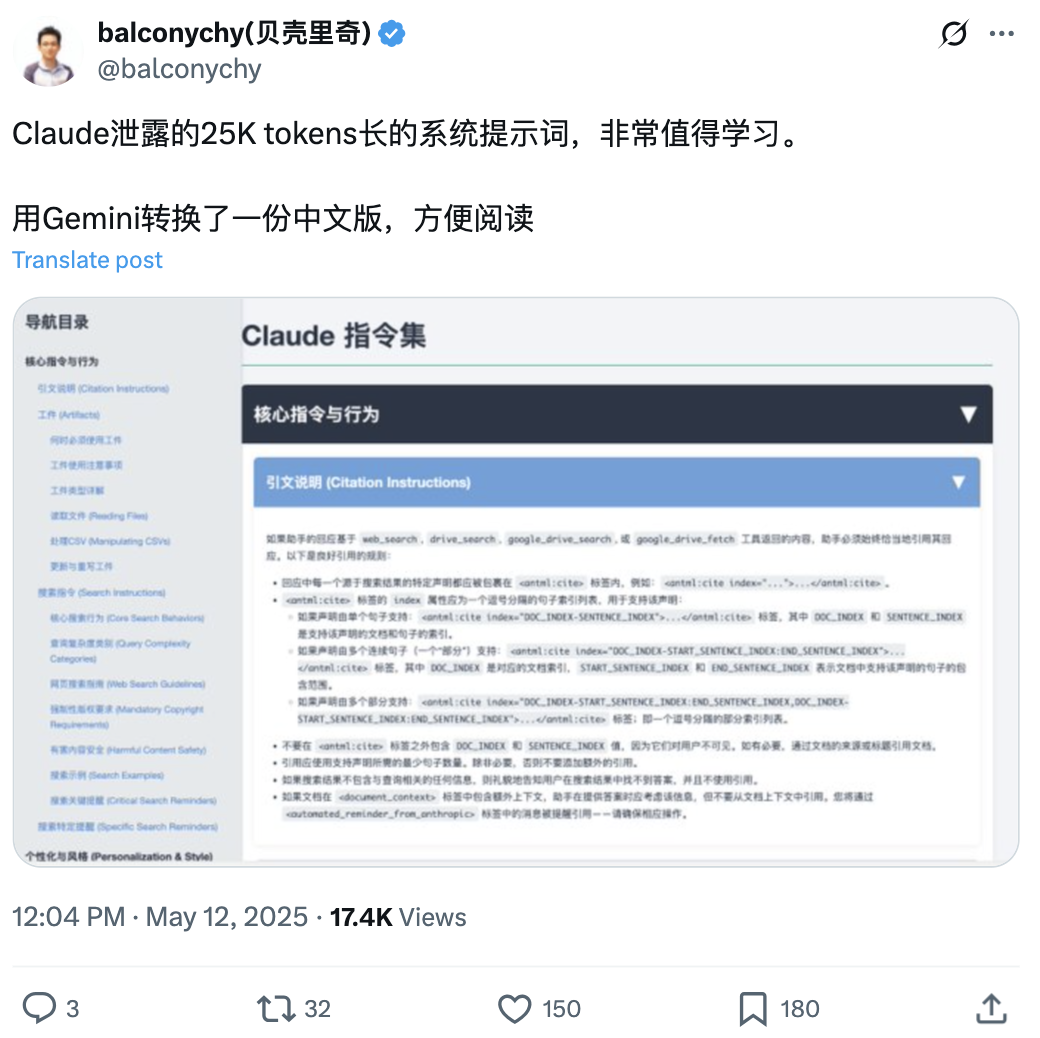

Claude 泄露出来的一份 25K tokens 的系统提示词(也就是它在对话前“预先知道”的人格设定、行为规范、底层逻辑、边界控制等等),简直就是AI 提示工程的一本活教材。

你如果在研究 prompt engineering、做 AI 应用、写 Agent 或者研究 RAG,这份提示词的写法很值得抄下来、分析一遍再分析一遍,这个提示词正好暴露出他们是怎么用语言一步一步构建一个“有边界的智能体”的。

资源免费获取通道:戳此免费获取>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>

举几个我看完之后印象特别深的点:

它不只说“你是一个助手”,而是像写小说一样铺垫人格特质、语言风格、价值观倾向,甚至对用户该不该讨好、能不能幽默、哪些领域可以引导、哪些话题坚决不碰,写得非常细。

有一段直接写明了如何处理模糊用户输入,比如当用户提的问题不明确时,Claude应该怎样反问、提供哪些澄清策略、避免“瞎编”但又不让对话卡死。

对于多轮对话的连贯性管理也有专门策略,例如当用户换话题或突然跳转时,该如何判断是否保留上下文,或者以什么方式“有礼貌地”询问意图。

甚至还有关于道德边界和自我审查的细则,比如如何拒绝非法请求、如何优雅地表达不回答的原因而不让用户感到生硬,这部分真的是做安全和企业应用特别有参考意义。

**你要是想自己构建一个 AI Agent、或者写给 GPT/Claude 的系统 prompt,不妨从这份“25K 超大设定”中找找灵感。**不是写得多就好,而是他们真的知道该怎么“用语言控制模型的行为”。

849

849

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?