本篇博文主要介绍强化学习reforcement learning

文章目录

What is reinforcement learning(RL)

RL不知道好还是不好

RL的结构:

下面举例子讲RL:

每盘棋局结束的时候,才能得到reward,学习的过程就是最大化reward的过程。

下面的network可以选择CNN,实际做的时候是看的参数FNN

reward是采取行为时立即得到,return是整个episode中reward的加和(total reward),就是我们想要最大化的。

难点:如何找到一组参数让R越大越好

Policy Gradient

每个行为都会影响接下来的互动

拿来训练的actor与跟环境互动的actor是同样的。(on-policy)

不同时,就称为off-policy

Actor-Critic

两种方法都是可以算出来出reward的,只不过背后的假设是不一样的。

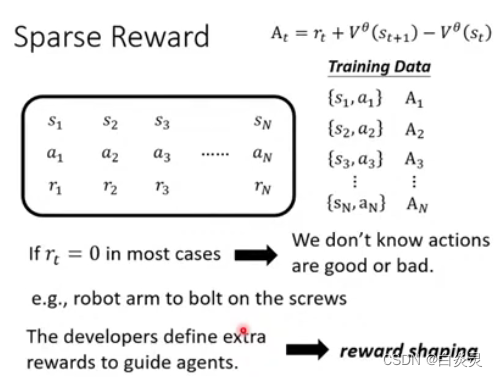

Reward Shaping

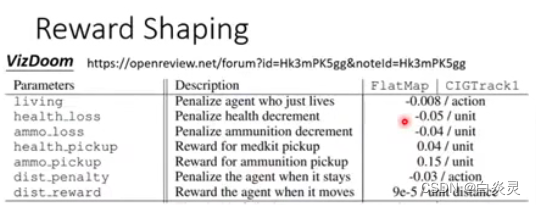

reward shaping在RL中使用的例子:

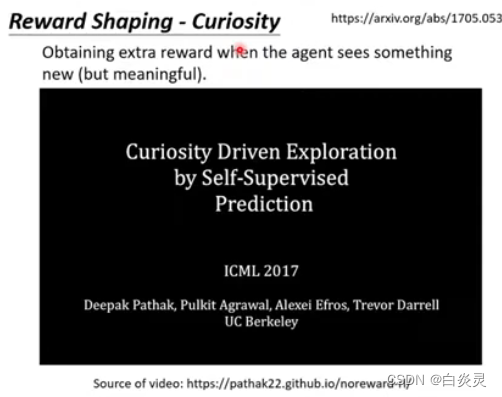

不断看到新东西

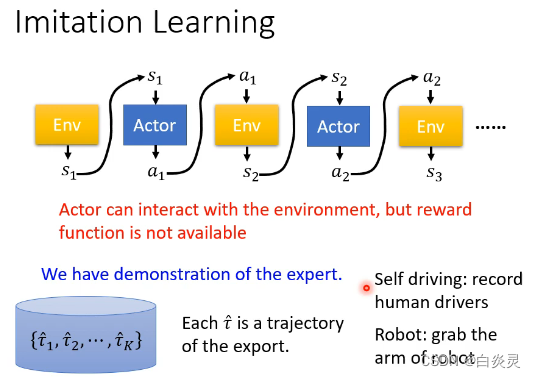

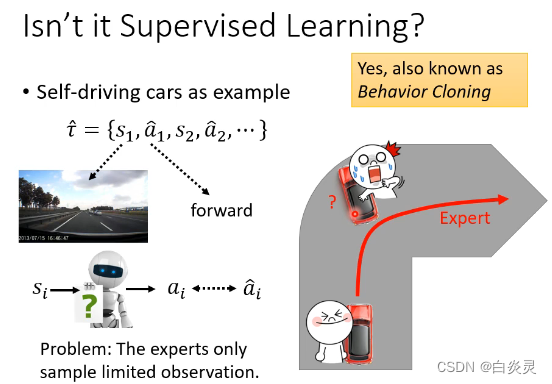

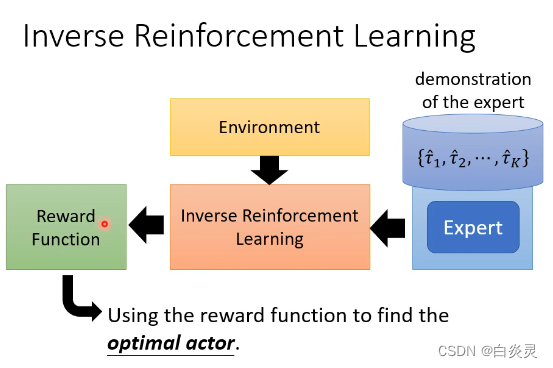

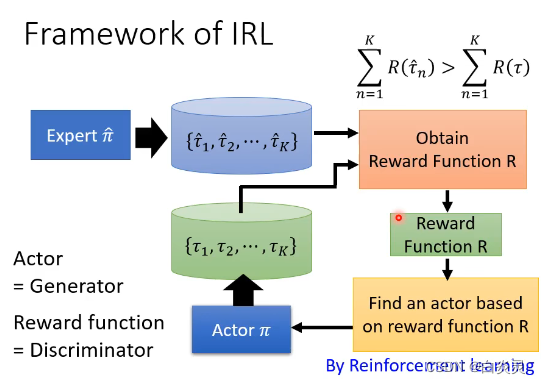

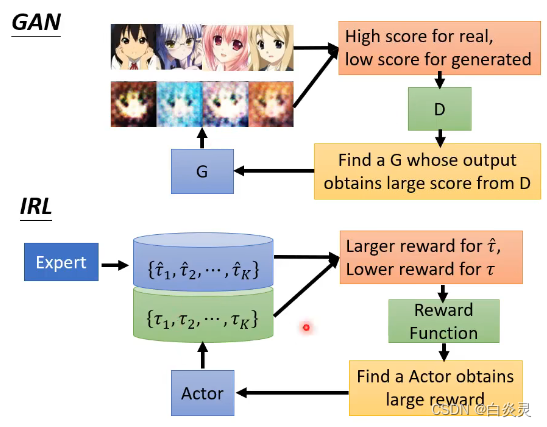

No Reward:Learning from demonstration

真实环境中,有时候根本不知道怎么定reward

还有一些其他的问题,the agent will copy every behavior, even irrelevant actions.

2304

2304

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?