文章目录

蓝耘 | 蓝耘元生代智算云详细使用教程,蓝耘云,蓝耘元生代智算云是一个面向企业及个人用户,兼具效率与成本优势的智算云。支持裸金属调度和容器调度。裸金属调度能赋予用户更广阔的自定义空间;容器调度则依托方便快捷的调度能力,可帮助纳管合作伙伴闲置的算力资源,并实现快速构建,分钟级打造出一个专属品牌的算力平台,客户仅需提供企业品牌 logo、网址以及负责人信息即可轻松完成。

一、前言

在数字浪潮汹涌澎湃的时代,程序开发宛如一座神秘而宏伟的魔法城堡,矗立在科技的浩瀚星空中。代码的字符,似那闪烁的星辰,按照特定的轨迹与节奏,组合、交织、碰撞,即将开启一场奇妙且充满无限可能的创造之旅。当空白的文档界面如同深邃的宇宙等待探索,程序员们则化身无畏的星辰开拓者,指尖在键盘上轻舞,准备用智慧与逻辑编织出足以改变世界运行规则的程序画卷,在 0 和 1 的二进制世界里,镌刻下属于人类创新与突破的不朽印记。

主要应用于 AI 训练、推理、视觉特效和渲染及教科研等计算密集型场景,为用户提供按需付费、随时随地可获取的 GPU 算力云服务,在满足客户业务应用和 GPU 算力随需扩展的双重需求的同时,响应用户在管理成本、技术投入及效率方面的成本控制诉求,全面提升整体计算效率,加速 AI 创新成果转化。

二、蓝耘元生代智算云介绍

2.1 功能模块

- 智算算力调度模块:

支持裸金属调度和容器调度。裸金属调度能赋予用户更广阔的自定义空间;容器调度则依托方便快捷的调度能力,可帮助纳管合作伙伴闲置的算力资源,并实现快速构建,分钟级打造出一个专属品牌的算力平台,客户仅需提供企业品牌 logo、网址以及负责人信息即可轻松完成。

- 应用市场模块:

部署了很多镜像,如 sdcomfyui、sdwebui、yolo、2d 转 3d 建模的 triposr 等,用户可以点击部署镜像,选择计费方式后立即购买,部署成功后,通过 ssh 命令和密码即可启动应用进入相应操作界面。

- AI 协作开发模块:

深度契合 AI 开发中的团队协作场景需求,通过前台、中台和后台的全方位协同满足开发训练需求。前台为开发工程师集成了常用的开发套件、存储调用、镜像仓库及高灵活度的资源调度,并通过计算网络轨道调优、numa 亲和性调度、分布式缓存等一系列后台优化进一步提升训练效率,支持自定义任务在同一组 leaf 交换机上运行。中台面向用户运维团队提供集群基础设施级监控指标,助力高端玩家高效追踪训练任务各阶段、各项目的资源使用情况,优化资源分配,确保了算力的充分利用,有效避免资源的浪费与闲置。后台主要为非技术人员提供运营和财务等相关的功能。

2.2 服务模式

- 公有云服务:

面向中小型商业客户和各类 C 端 AIGC 开发者,以公有云形式提供弹性算力服务,用户按需购买或订阅资源,无需自建硬件。

- 私有化部署:

针对数据安全和性能要求较高的大型企业用户,可在其内部进行私有化部署,以完善高效的算力解决方案,为数据隐私和自主运营保驾护航。

- 按年度订阅:

对于算力资源丰富但技术能力相对薄弱的云服务商、地方政府智算中心,在授权许可下,向其开放使用权限,并按年收取技术服务费。

2.3 技术优势

- 全场景覆盖:

基于 Kubernetes 原生云设计,依托行业领先的灵活基础设施和大规模 GPU 算力资源,实现从数据准备、代码开发、模型训练到推理部署等全场景覆盖,高效赋能用户 AI 研发全流程。

- 高效集约:

可实现计算资源统一分配调度、训练数据集中管理并加速、集群环境快速部署与迁移,满足客户在 AI 模型构建、训练和推理业务全流程中对 GPU 算力灵活性及多样化的需求,助力 AI 创新发展提质增速。

- 开放兼容:

打造集应用市场、预训练大模型、数据集管理、AI 开发工具、模型镜像等功能于一体的生态体系,致力于构建一个充满活力的 AI 社区,为 AI 应用和镜像制作者开辟多元化的变现途径。

三、智算云注册使用

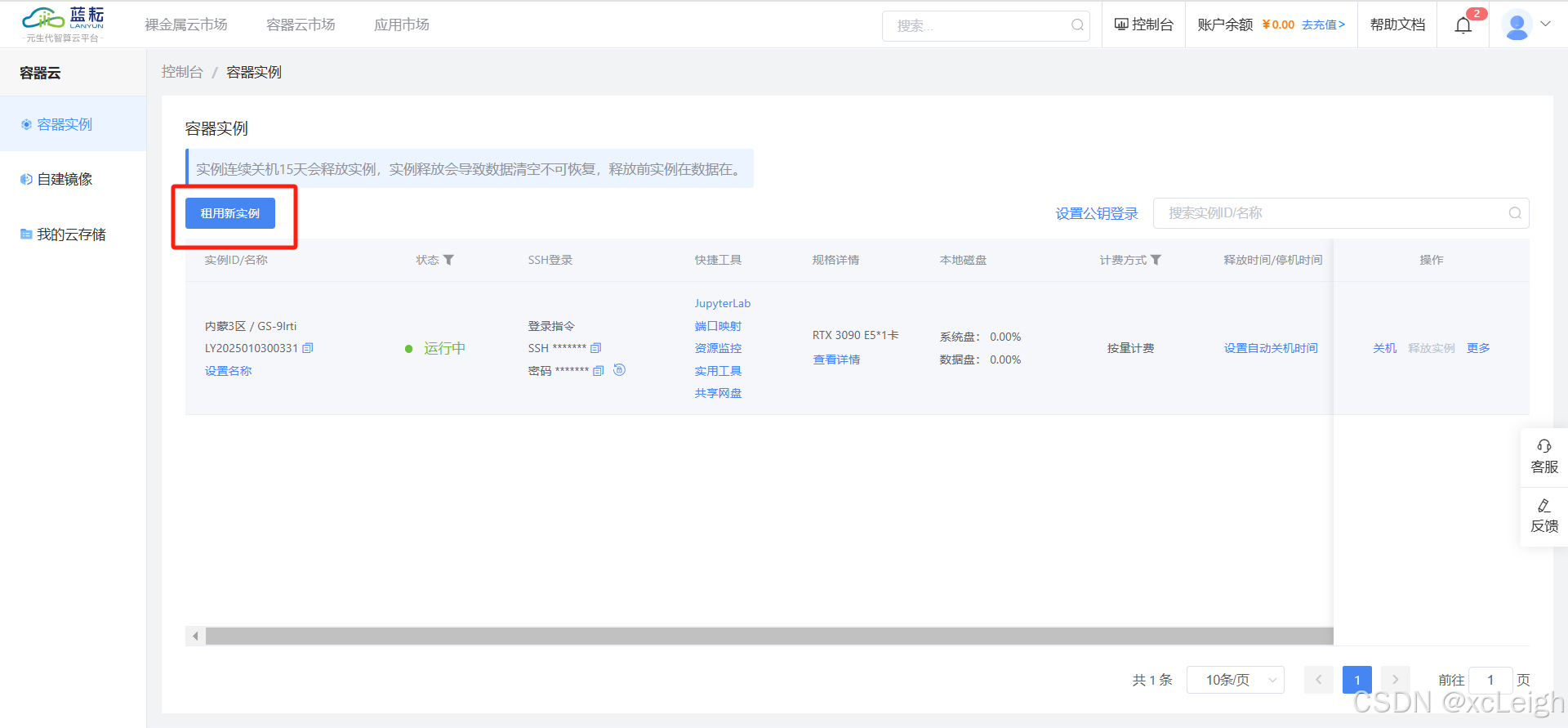

- 1.登录后,点击页面顶部导航栏中的 “控制台” 按钮,进入 “容器实例” 页面,选择 “租用新实例”。

- 2.根据自身需求和预算,从实例列表中选择合适的服务器配置,页面右侧会显示每种配置的详细价格信息。

- 3.在结算时,可以使用之前领取的代金券来抵扣费用。新用户通常有一定时长的免费使用优惠,如 3090 显卡服务器可免费使用 66 小时,4090 显卡服务器可免费使用 43 小时。

3.1 注册申请

实例购买操作: 根据下图步骤配置使用

3.2 租用新实例

PyTorch 是由 Facebook 的人工智能研究团队(FAIR)开发的。它于 2017 年发布,从一开始就受到了广泛关注。其开发的初衷是为了提供一个动态计算图的深度学习框架,使得研究人员和开发者能够更灵活地构建和训练神经网络。

四、服务器使用

4.1 连接服务器

- 开启无卡模式:

登录服务器后,进入 “无卡模式” 设置界面并开启该模式。在无卡模式下,每小时仅需 0.1 元,可将数据集从本地传输到服务器。

- 使用 FileZilla 进行服务器连接:

1.打开 FileZilla 并点击顶部的 “文件”。

2.选择 “站点管理器” 并新建站点,选择协议为 “SFTP - SSH File Transfer Protocol”。

3.输入服务器信息,包括主机(link.lanyun.net)、端口(通常为 13272)、用户(root)和密码,然后选择连接。

4.2 配置开发环境

1.在本地安装 PyCharm 专业版。

2.打开工程项目,然后进入 “settings→project interpreter→add”。

3.点击 “SSH interpreter”,设置一个新的服务器配置,包括服务器地址、端口号、用户名和密码等信息。

4.添加 Python 解释器,通常远程 Python 解释器的路径为 /root/miniconda3/bin/python,如果使用了虚拟环境,则路径为 /root/miniconda3/envs/{环境名}/bin/python。

5.对文件位置进行设置,确保 “Deployment path” 与 “Sync folders” 中的路径保持一致。

4.3 使用应用市场

1.点击 “应用市场”,其中部署了很多镜像,如 sdcomfyui、sdwebui、yolo、2d 转 3d 建模的 triposr 等。

2.点击部署镜像,选择计费方式,立即购买,之后会跳转到工作台,等待部署成功。

3.部署成功后,使用 win+r 键打开命令行,复制粘贴 ssh 命令,并复制 ssh 密码输入,即可启动应用进入相应的操作界面。

4.4 数据管理

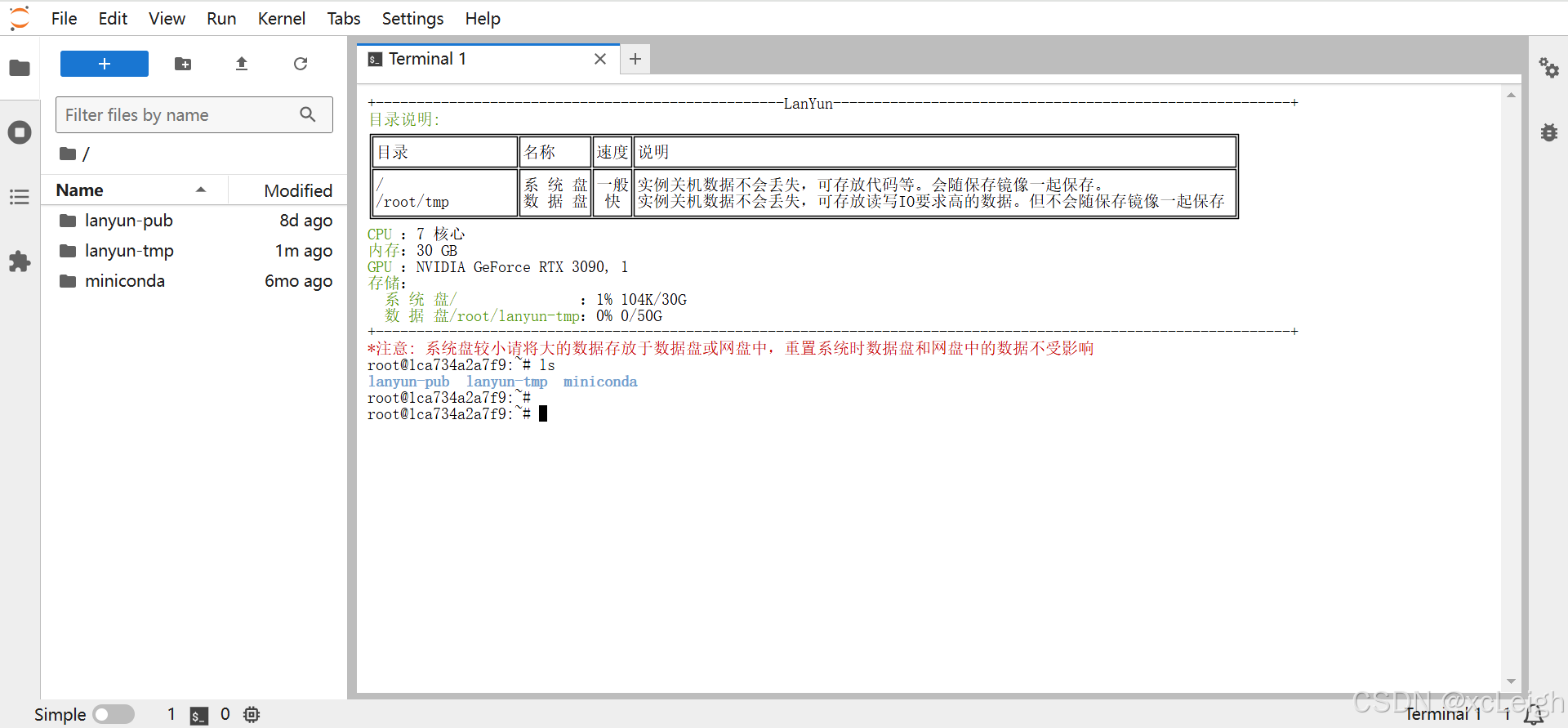

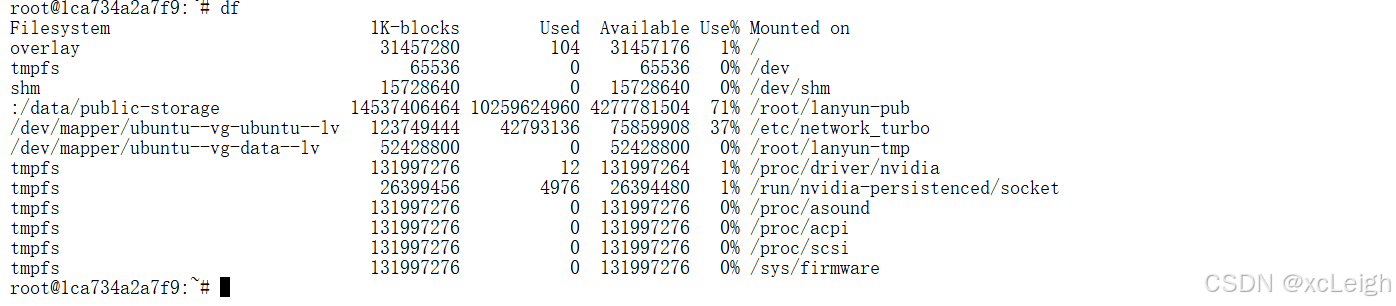

1.上传的数据通常存储在服务器的 /root/lanyun-tmp/ 目录中,可将本地数据上传至此位置。

2.在服务器上可对数据进行整理、预处理等操作,以满足模型训练和推理的需求。

4.5 模型训练与推理

1.在应用市场中选择适合的深度学习模型镜像并部署。

2.根据模型的要求,准备好训练数据和相关配置文件,并上传至服务器。

3.在相应的操作界面中,设置训练参数,如学习率、批次大小、训练轮数等,然后启动训练任务。

4.训练完成后,可使用训练好的模型进行推理,输入相应的测试数据,获取模型的输出结果。

4.6 监控与管理

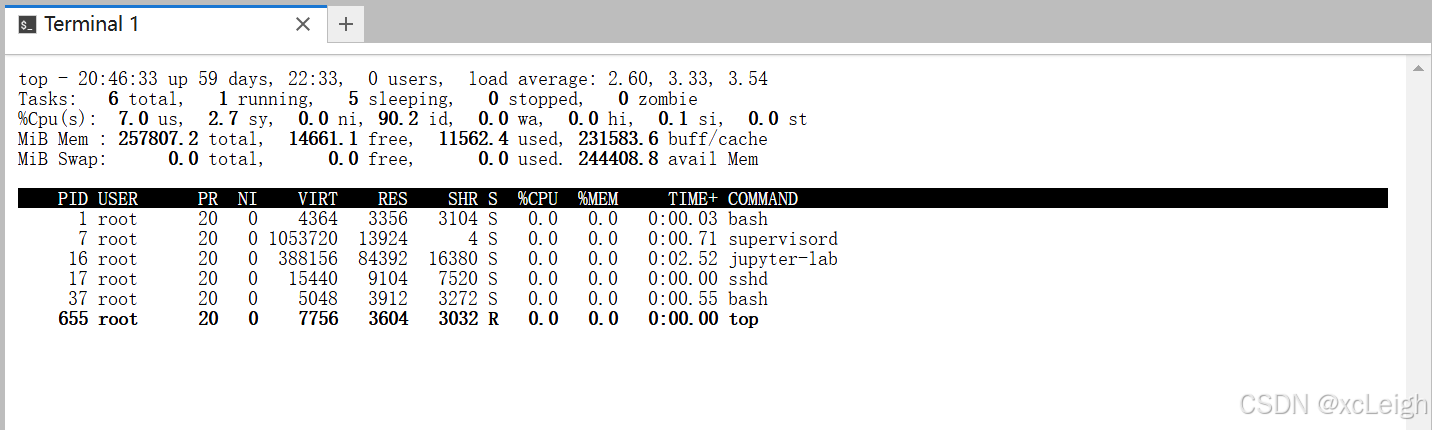

1.在平台的控制台中,可以查看服务器的运行状态,包括 CPU、GPU 使用率、内存使用情况等。

2.对于正在运行的任务,可查看任务的进度、日志等信息,及时了解任务的运行情况。

3。根据实际需求,可对服务器进行重启、停止、删除等操作。

4.7 Linux命令操作

操作步骤: 控制台 》容器实例 》快捷工具 》JupyterLab

今天就介绍到这里了,更多功能快去常识吧……

结束语

亲爱的朋友,无论前路如何漫长与崎岖,都请怀揣梦想的火种,因为在生活的广袤星空中,总有一颗属于你的璀璨星辰在熠熠生辉,静候你抵达。

愿你在这纷繁世间,能时常收获微小而确定的幸福,如春日微风轻拂面庞,所有的疲惫与烦恼都能被温柔以待,内心永远充盈着安宁与慰藉。

至此,文章已至尾声,而您的故事仍在续写,不知您对文中所叙有何独特见解?期待您在心中与我对话,开启思想的新交流。

🚍 蓝耘元生代智算云平台:https://cloud.lanyun.net//#/registerPage?promoterCode=0131

① 🉑提供云服务部署(有自己的阿里云);

② 🉑提供前端、后端、应用程序、H5、小程序、公众号等相关业务;

如🈶合作请联系我,期待您的联系。

亲,码字不易,动动小手,欢迎 点赞 ➕ 收藏,如 🈶 问题请留言(评论),博主看见后一定及时给您答复,💌💌💌

蓝耘元生代智算云介绍与使用指南

蓝耘元生代智算云介绍与使用指南

552

552

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?