1 梯度消失和梯度爆炸产生的原因

https://blog.csdn.net/yhily2008/article/details/80790476

https://zhuanlan.zhihu.com/p/33006526

在神经其网络的参数训练过程中,BP(Back Propagation)算法非常重要。BP神经网络工作流程分两步:(1)正向传播输入信号,输出分类信息(对于有监督学习而言,基本上都可归属于分类算法);(2)反向传播误差信息,调整网络的权值(通过微调网络参数,让下一轮的输出更加准确)。

产生梯度消失的根源是:深度神经网络的反向传播

我们构建深度神经网络是为了拟合由输入到输出的映射关系,

将损失函数计算的偏差通过梯度反向传播的方式来更新网络的权重,

拟合从输入到输出映射关系的最优的模型的过程就是为网络节点找到合适的参数的过程。

最优模型的条件下loss达到最小值。数学中计算函数最小值的方法适用于此,梯度下降法

以下从两个角度来分析梯度消失和梯度爆炸产生的原因:深层网络和选择了不合适的激活函数。

(1)深层网络的角度

图片来自:https://zhuanlan.zhihu.com/p/33006526

f 表示每一层的激活函数,那么输出节点可以表示为,fi+1 = f(fi*wi+1) 目标基于梯度下降的方法,按负梯度的方向对权值进行调整。

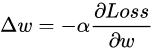

权值调整量的表达式为(α表示学习率):

根据链式求导法逐层计算。

如果△w值大于1,随着网络层数的不断加深,最终梯度将以指数形式增加(梯度爆炸<

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5470

5470

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?