参考自:https://blog.csdn.net/tsyccnh/article/details/79163834

信息量

信息量是对事件发生概率的一个度量,事件发生的概率越小,事件所包含的信息量越多。

举个例子:巴西进入世界杯,中国进入世界杯,这个事件从直觉来说是第二个小概率事件所包含的信息量多

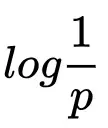

所以香农提出了一个定量衡量信息量的公式:

熵

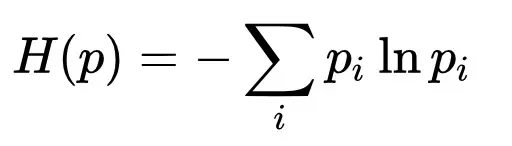

熵是表示一种事件不确定性的一种衡量,对于一个存在不确定性的系统,熵值越高,不确定性的因素越大,熵值为0,表示没有任何不确定性:

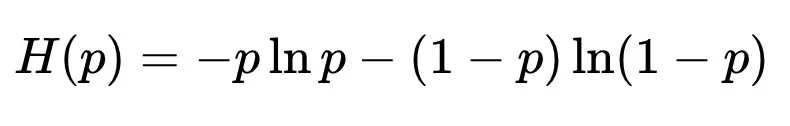

从公式可以看出,熵值就是对系统中各事件的信息量的期望值。对于一个只存在两种可能性系统,他的熵值即为:

所以系统中不确定最大,即熵值为0的时候,即每个概率相等的时候。

相对熵(KL散度)

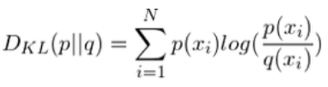

用于衡量两个分布之间的差异程度,公式:

kl散度的解释:用P描述目标问题,而不是Q来描述目标问题所得到的信息增量

交叉熵

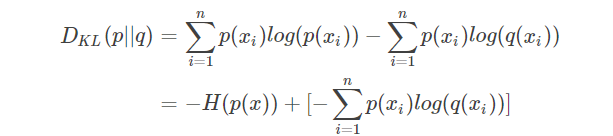

将KL散度的公式进行化简:

公式的第一项化简后是P的熵,即真实分布的熵,这个是固定不变的,所以我们在优化的KL散度的时候,只需要关注后面一项,即为交叉熵

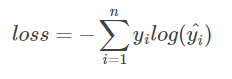

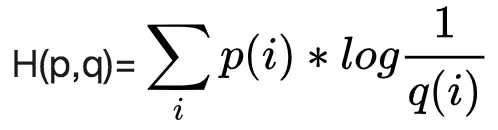

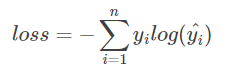

交叉熵用来很好衡量预测概率和真实概率之间差异,计算公式:

其中P(i)是真实分布,Q(i)是预测分布

交叉熵在机器学习中的应用:

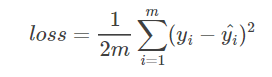

对于回归问题来说,经常使用MSE作为loss函数。

在分类问题中即使用交叉熵作为loss函数

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?