Movie Summarization via Sparse Graph Construction

电影场景的5个转折点:

Screenplay Summarization Using Latent Narrative Structure

DEGREE: A Data-Efficient Generation-Based Event Extraction Model

Character Identification on Multiparty Conversation: Identifying Mentions of Characters in TV Shows

Narrative Theory for Computational Narrative Understanding

Towards Coherent and Consistent Use of Entities in Narrative Generation

Neural Language Taskonomy: Which NLP Tasks are the most Predictive of fMRI Brain Activity?

SNAC: Coherence Error Detection for Narrative Summarization

NARRASUM: A Large-Scale Dataset for Abstractive Narrative Summarization

TRAINING LANGUAGE MODELS TO SUMMARIZE NARRATIVES IMPROVES BRAIN ALIGNMENT

SummScreen: A Dataset for Abstractive Screenplay Summarization

A Survey of Machine Narrative Reading Comprehension Assessments

Nattative text是叙述性的文本,读者需要general world knowledge来进行推测与理解文本为什么如此进行。

narrative elements:

Social science perspective:

Situation model: 人类主要关注于叙述性文本中空间和事件间相互的信息。这些事件可以通过时间、地点和主要人物进行检索。类似于一个Clip中的场景。

Story structure theory:一个故事是存在一个内在结构的。比如故事发生的时间、场景和设定;故事所包含的角色;每个角色的主要目的。

education research:story elements including main character, setting (i.e., time and location), problem, attempted solution, and ultimate solution are often used to assess students’ narrative comprehension.

NLP perspective:

需要理解空间、时间、因果、动机才算理解narrative elements。

Target Narrative Element:

1.event.更加细粒度的是一个activity.

2.character

3.setting

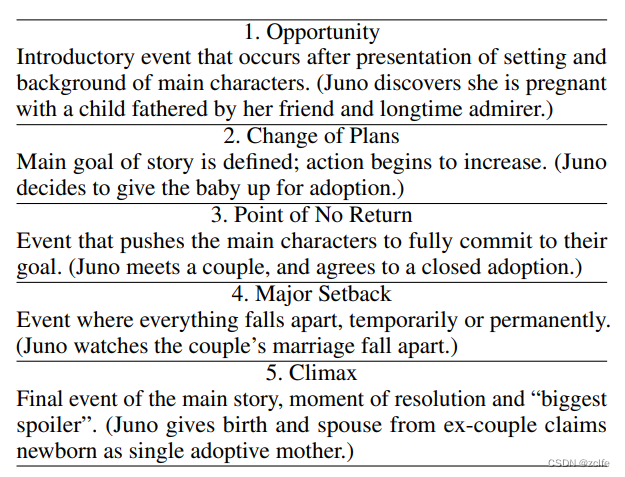

4.Functional Structure

TVSHOWGUESS: Character Comprehension in Stories as Speaker Guessing

文章提出了TVSG的模型,试图用对话、场景描述以及历史场景来理解匿名角色。

对于这个任务人类可以很好地完成,但是机器却无法很好地做到。

Visual Semantic Role Labeling for Video Understanding

A Dataset for Movie Description

该数据集是根据descriptive video service提供对于视觉内容的叙述构建成的,dvs不同于电影的剧本,dvs更加贴合电影的视觉内容。

Video Description: A Survey of Methods, Datasets, and Evaluation Metrics

Video Description有三个阶段:1.传统方法阶段,2.统计方法,3.深度学习

1.传统方法:主要是利用模板来进行视频的描述例如SVO(主体、动作、对象)(clip)来做prompt。

传统方法一般有两个阶段,第一阶段为identification,主要要识别在video中的实体,第二个阶段是语句的生成,套用到模板中。

2.统计方法:传统方法遇到更复杂的数据集时就表现的很差了。因为,首先,开放领域视频包含不可预见的各种主体、对象、活动和场所。其次,由于人类语言的复杂性,这些数据集通常会有多个有意义的描述。第三,要描述的视频通常很长,可能会延续数小时。

CLIP-Event: Connecting Text and Images with Event Structures

Video Event Extraction via Tracking Visual States of Arguments

通过object的细化状态来进行事件的抽取。

object detection and tracking检测object在每一帧中的位置。

每一帧中的object的状态是由object feature和location组成的。

多帧中的object motion的状态是由单帧中object的状态聚合得到的。

object之间的交互是根据object中的union box得到的,将union box中的feature进行mean pooling,再将交互进行聚合得到object interaction embedding

这个任务最难的是将事件中涉及的语义对象抽取出来。

看消融实验上,有的模块不是那么有效比方OIE。

5716

5716

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?