马尔科夫过程/链:

满足“未来只与现在有关,与过去无关”的随机过程

MRP:

=马尔科夫过程+奖励+折扣因子

计算方法:

- Bellman矩阵(O(n^3),适合小规模)

- 动态规划(适合白盒但现实条件下是白盒很少)

- 蒙特卡洛(基于采样和统计)

- 时序差分

MDP:

=MRP+“刺激”(对环境而言,刺激就是agent的action)所以MDP就是环境本身。

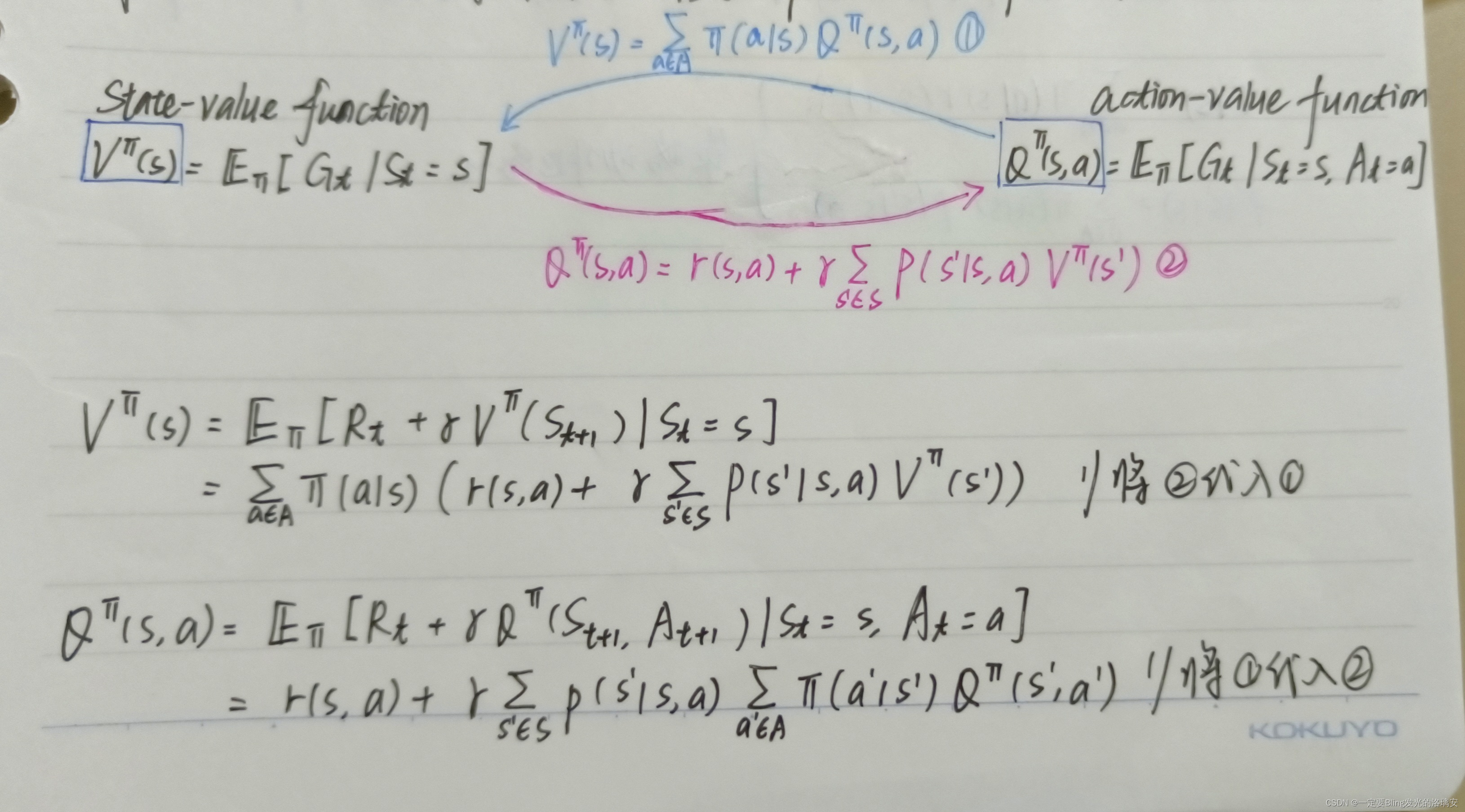

state-value function & action-value function

上述公式很重要❗描述了现在的状态/动作价值函数和未来的关系,以及之间的转化关系。

哦~好像刷新了历史最短篇幅记录,不过 I don’t care,打算在CSDN更新有关笔记,代码放在上github上,明天更的是基于DP的策略迭代和价值迭代(悬崖寻路和冰湖环境)

感觉从头开始快不得,去年的组会至今也有半年了吧,重拾之后再理解确实有些新的体会。打算将theory和codes一起吃透,毕竟最终公式还是要转换为代码的,“纸上得来终觉浅,绝知此事要躬行”嘛。

从头编写环境、动作,然后更新环境…听起来也不是那么轻松哦~

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?