针对问题:

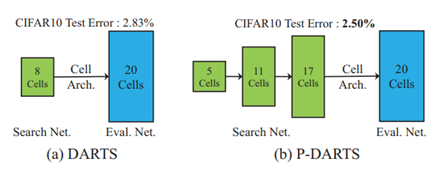

(1)DARTS在CIFAR10上实验时,直接将搜索阶段到的8个cell的网络在实际应用阶段扩充到20个cell,normal cell和reduction cell结构保持不变,在浅层网络搜索到的最优结构在深层网络上表现不一定也会最优。

(2)在进行架构搜索时由于跳跃连接加速前向/反向传播,经常导致更快的梯度下降,因此在优化架构参数时其分配的权重较大,最后搜索到的结构往往包含大量的跳跃连接,但是其不含参数,对视觉表征学习贡献小,使得模型稳定性欠佳。

解决方法:

(1)采用渐近搜索策略,逐步延长网络的深度:

针对增加深度对GPU内存的负担,在每个阶段使用搜索空间近似对低权重操作进行删减:

(2)提出搜索空间正则化:

①使用操作级别的dropout减少跳跃连接在训练期间的优势。

②控制跳跃连接出现的次数为M,如果跳过连接的数量少于M,在这个cell中搜索具有最大架构权重的 M 个跳跃连接操作,并将其他的权重设置为 0,然后使用修改的架构参数重新构建单元。

其中 ②应用在 ①之上。

P-DARTS论文概要

于 2022-03-05 15:19:56 首次发布

630

630

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?