摘要

在开放世界中,特征的数量是不增加的,模型仅在一部分观察到的特征上进行训练,而没有在测试数据上出现的新特征上进行训练,新的特征来自不同的领域。因此文章就提出了一种新的用图表示学习的学习方法。主题框架包含了两个部分:1. 一个骨干网络(例如,前馈神经网络)作为一个较低的模型以特征作为输入和输出的预测标签。2. 一个图神经网络作为一个较高的模型学会通过消息传递由观察数据构建的特性数据图来推断新特性的嵌入。基于我们的工作架构上,我们设计了两种训练策略,一种自建督方法和一种归纳学习方法来赋予模型推断的能力并缓解特征层面上的过拟合。并对具有新特征的测试数据的泛化误差进行了理论分析,它剖析了训练特征和算法对泛化性能的影响。

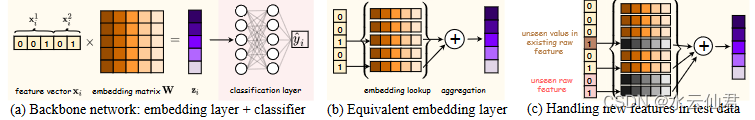

图1:(a)在具有部分特征的训练数据和具有增强特征空间的测试数据上定义了开放世界特征外推问题。现有的神经模型如果没有重新训练,就无法处理新的特征。(b)我们的方法与人类大脑中的思维过程类似。想象一个人被训练使用特征年龄,职业来预测自己的收入,并使用新特性教育测试用例。从获取观测结果到给出最终的预测有四个过程。

大脑的思维过程

1)知觉:观察被我们的感官所认识;

2)抽象:感知到的信息与我们认知中的概念是一致的;

3)推理:我们在我们的记忆中寻找类似的概念和观察结果来理解和吸收新的知识;

4)决策:通过新的理解和抽象,我们为预测做出最终的决定。

模拟大脑思维过程

我们提出的框架包含两个模块:一个主干网络,它可以是一个前馈神经网络,和一个图神经网络。

- 主干网络首先将输入特征映射到嵌入,可以看作是观察感知。

- 然后,我们将观察数据矩阵(每一行代表一个实例的特征向量)视为特征-数据二部图,它明确地定义了特征和实例之间的邻近性和局部性结构。然后利用图神经网络在潜在空间(抽象)中传递相邻的特征和实例。

- GNN将在现有特征的基础上归纳地计算新特征的嵌入,模拟我们大脑中从熟悉概念到新概念的推理过程。

- 新获得的同时捕获语义和特征级关系的嵌入将用于获得具有不可见特征的新数据的隐藏表示,并做出最终决策。

图2 说明了用神经网络模型外推新的特征空间的可行性。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?