书生浦语大模型全链路开源体系

以高质量开源赋能创新

大模型成为发展通用人工智能的重要途径。

- 2021年之前是针对特定任务,一个模型解决一个问题(ImageNet竞赛2012、人脸识别2014、围棋比赛2016、AlphaFold2021)

- 最近两年在向通用大模型发展,一个模型应对多种任务、多种模态。

InternLM2 概述

书生浦语的开源历程

- 2023年6月7日InternLM开源

- 2024年1月17日InternLM2开源

书生浦语2.0(InternLM2)的体系

| 尺寸 | 模型基座(可塑性强) | 多能力强化(推荐用于微调) | 对话交互优化 |

|---|---|---|---|

| 7B 轻量化 | InternLM2-Base | InternLM2 | InternLM2-Chat |

| 20B 综合能力强 | InternLM2-Base | InternLM2 | InternLM2-Chat |

InternLM2:回归语言建模的本质

新一点数据清洗过滤技术

- 多维度数据价值评估

- 高质量预料驱动的数据富集

- 有针对性的数据补齐

InternLM2的主要亮点

- 超强的上下文

- 综合性能全面提升。代码、数学、推理、知识、语言、考试,20B的模型比肩GPT3.5。

- 优秀的对话和创作体验。想象力ok。

- 工具调用能力整体升级。日程安排。

- 突出的数理能力和实用的数据分析功能。高准确率,复杂运算和求解,加入代码解释器后,在GSM8K和MATH上超过GPT4。上传表格,分析表格文件,概述,绘制趋势图(调用maiplot),要求模型使用机器学习算法做预测(sklearn)。

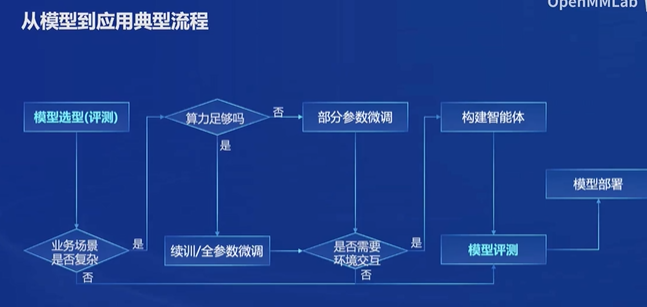

从模型到应用

- 应用:智能客服、个人助手、行业应用

- 从模型到应用是有GAP的,需要一个复杂的流程

书生浦语全链条开源开放体系

开发了全链条的工具

数据

- OpenDataLab:书生万卷1.0(2TB),书生万卷CC(400GB)

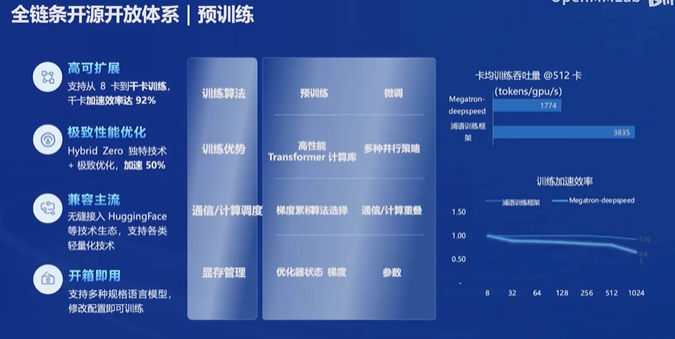

预训练

微调

- XTuner开源框架

- 增量续训:新知识、垂直领域知识

- 有监督微调:可以降低微调成本

评测

- 2024年1月30日,OpenCompass2.0 司南大模型评测体系

- CompassRank:中立全面的性能榜单

- CompassKit:大模型评测全站工具链。

- 数据污染检查

- 更丰富的模型推理接入

- 长文本能力评测

- 中英文双语主观评测

- CompassHub:高质量评测基准社区

- 希望构建大模型评测基准社区

- OpenCompass助力大模型产业发展和学术研究,广泛应用于头部大模型企业和科研机构,获得Meta官方推荐

- 根据评测结果洞见未来,形成年度榜单综合性客观评价,语言、知识、推理、数学、代码、智能体。国内部分大模型已经接近GPT4水平,国内模型在中文场景有优势,开源社区未来可期。

- 整体能力仍有较大提升空间

- 复杂推理仍是短板

- “理科”能力和模型尺寸关联性高

- 模型主客观性能需综合参考

部署

- LMDeploy

- 部署通常是模型上线环节的最后一个环节

- LMDeploy在A100上的部署效率高于vLLM

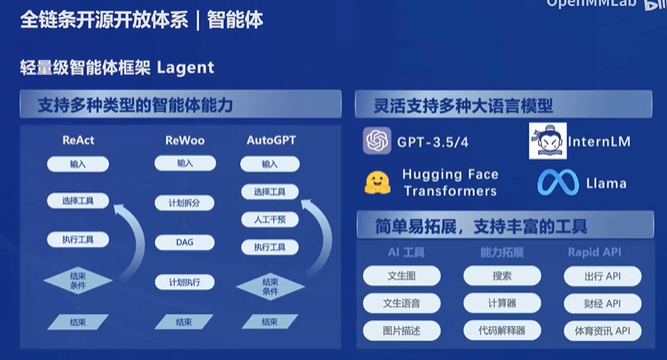

智能体

- 轻量级智能体框架Lagent

- 有很多内置工具,可以直接使用,比如代码解数学题、零样本泛化

- 多模态智能体工具箱AgentLego,是一个工具集合。可以将语言模型拓展为多模态智能体。

- 封装了OpenMMLab,SD,SAM等等模型。

746

746

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?