一、问题引入

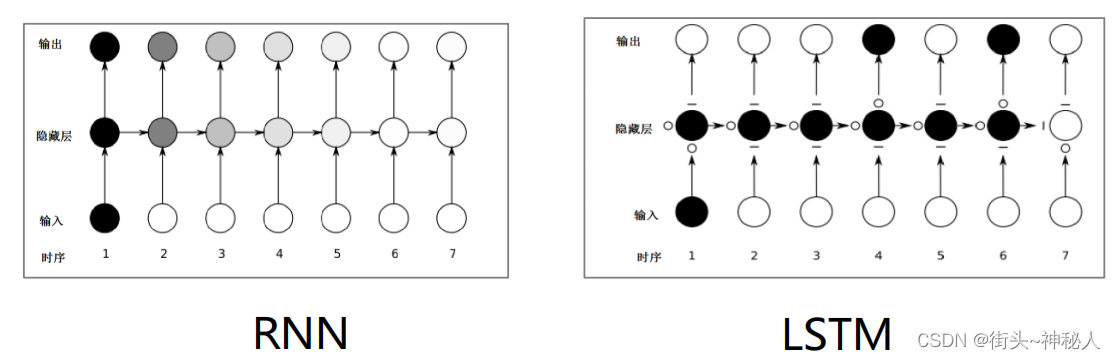

长短期记忆神经网络:LSTM(long short-term memory)作为一种改进之后的循环神经网络,不仅能够解决 RNN无法处理长距离的依赖的问题,还能够解决神经网络中常见的梯度爆炸或梯度消失等问题,在处理序列数据方面非常有效。对RNN问题请看RNN结构解析这篇文章。

LSTM基本思想

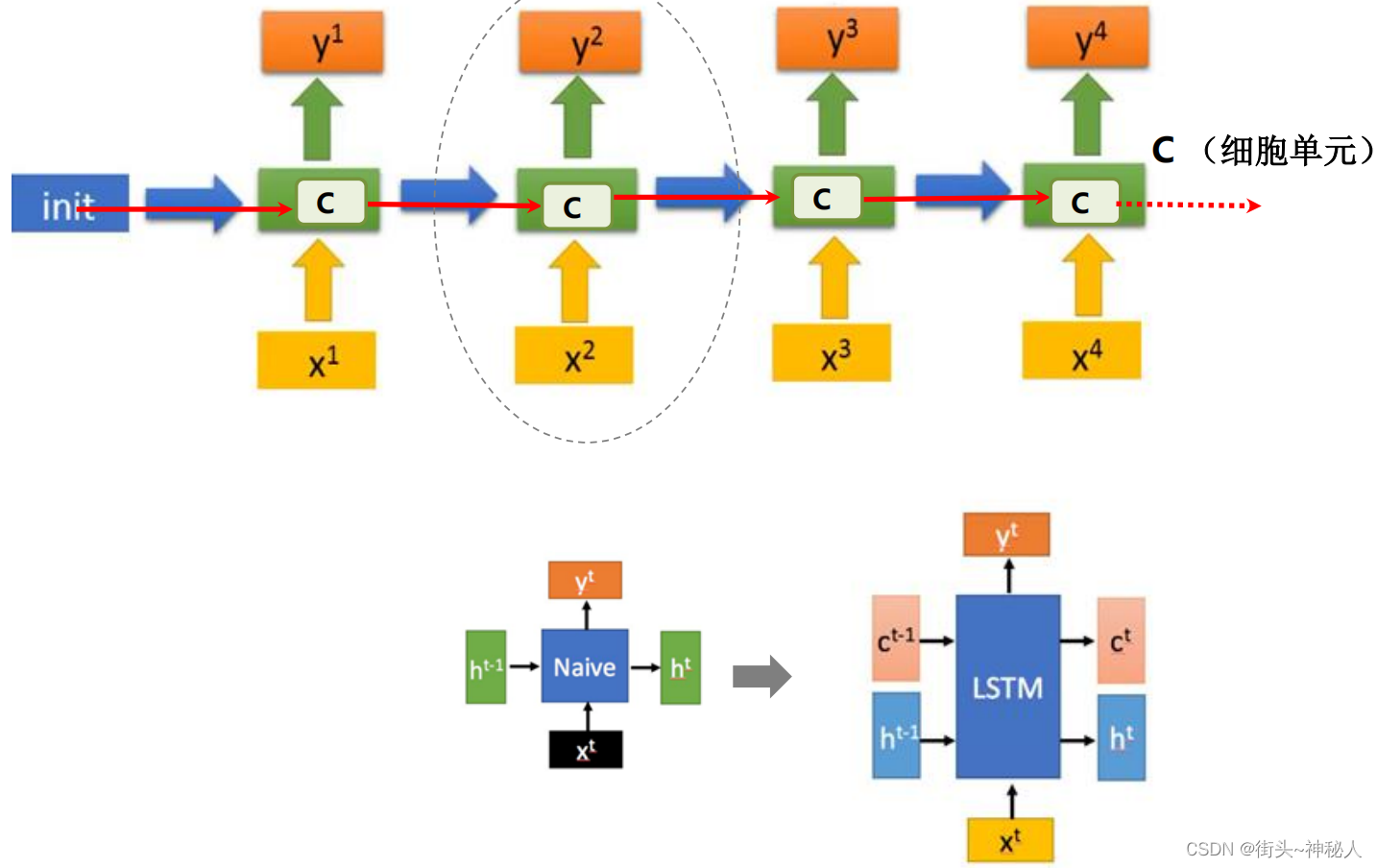

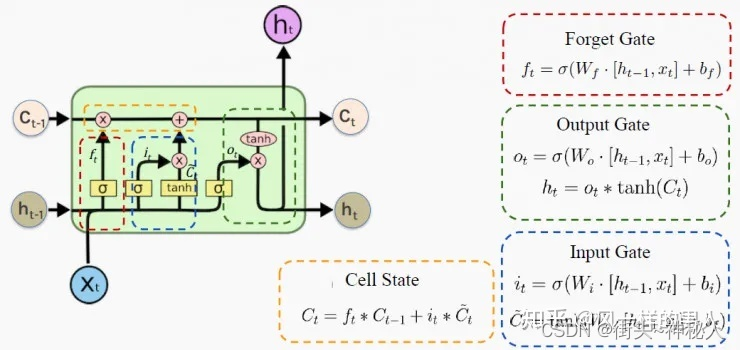

LSTM单元不仅接受 xt 和 ht-1,还需建立一个机制(维持一个细胞状态Ct) 能保留前面远处结点信息在长距离传播中不会被丢失。LSTM 通过设计“门”结构实现保留信息和选择信息功能。

二、LSTM结构

①网络结构

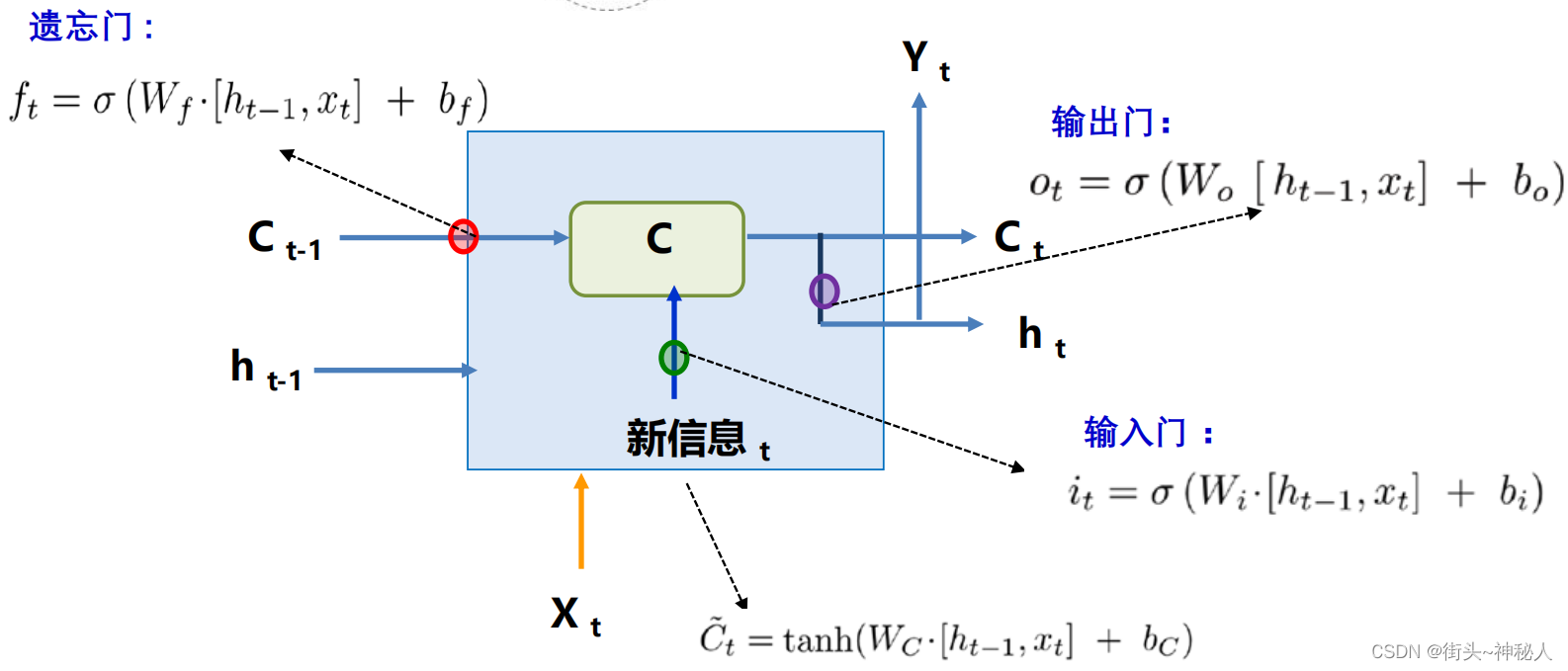

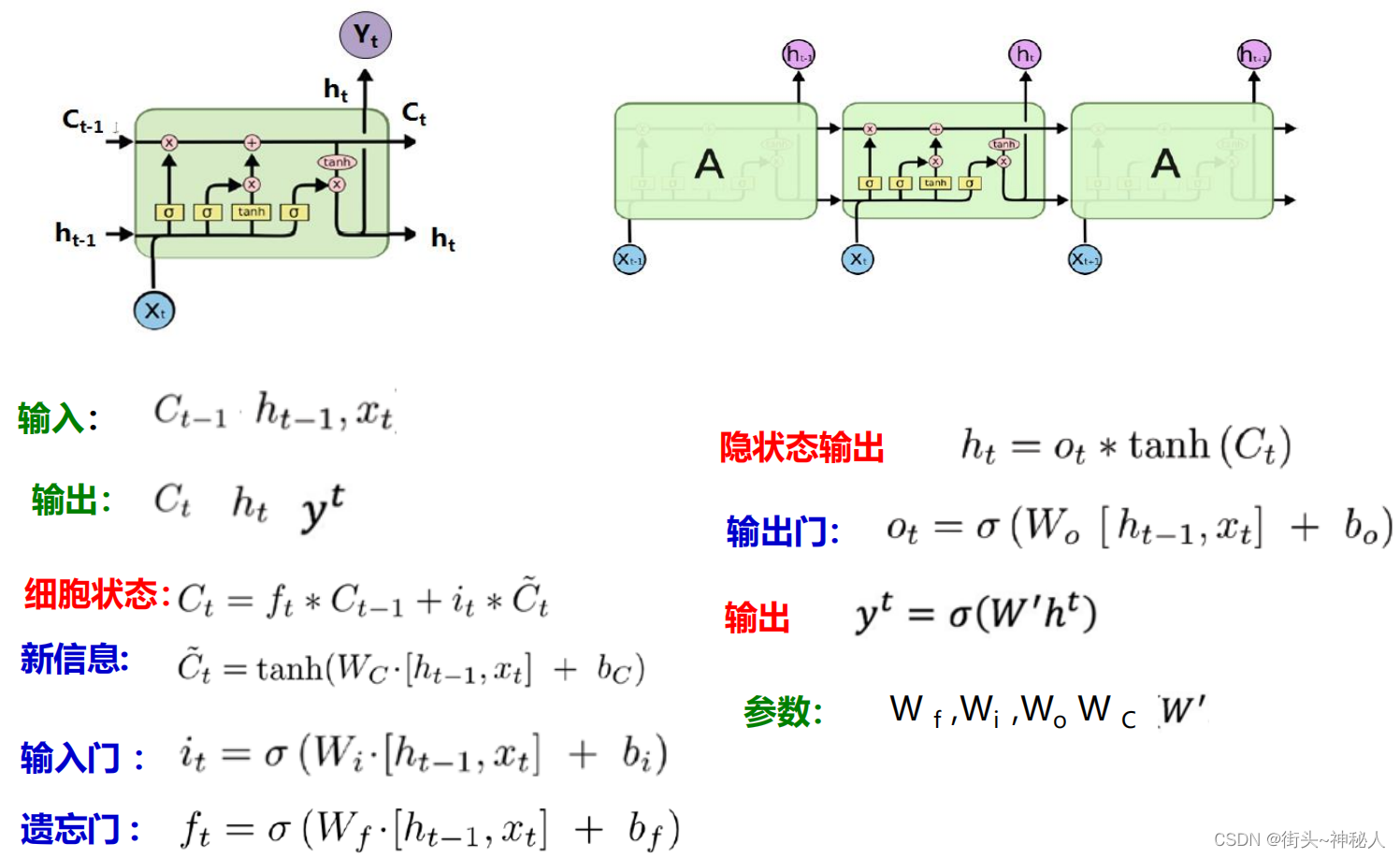

②单元结构

由遗忘门、输出门、输入门组成。

ht是隐藏状态,表示短期记忆;ct是细胞状态,表示长期记忆。

三、GRU

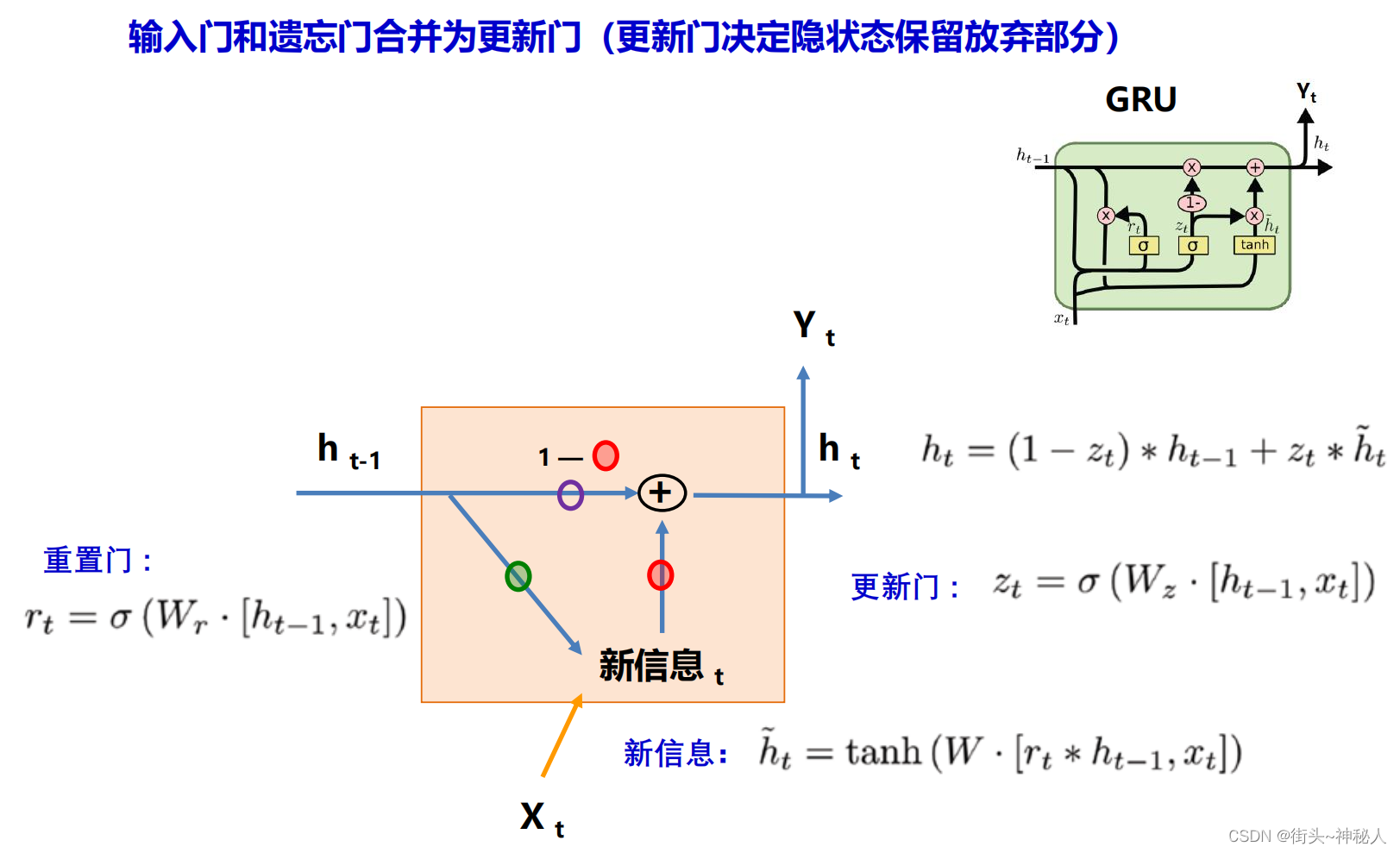

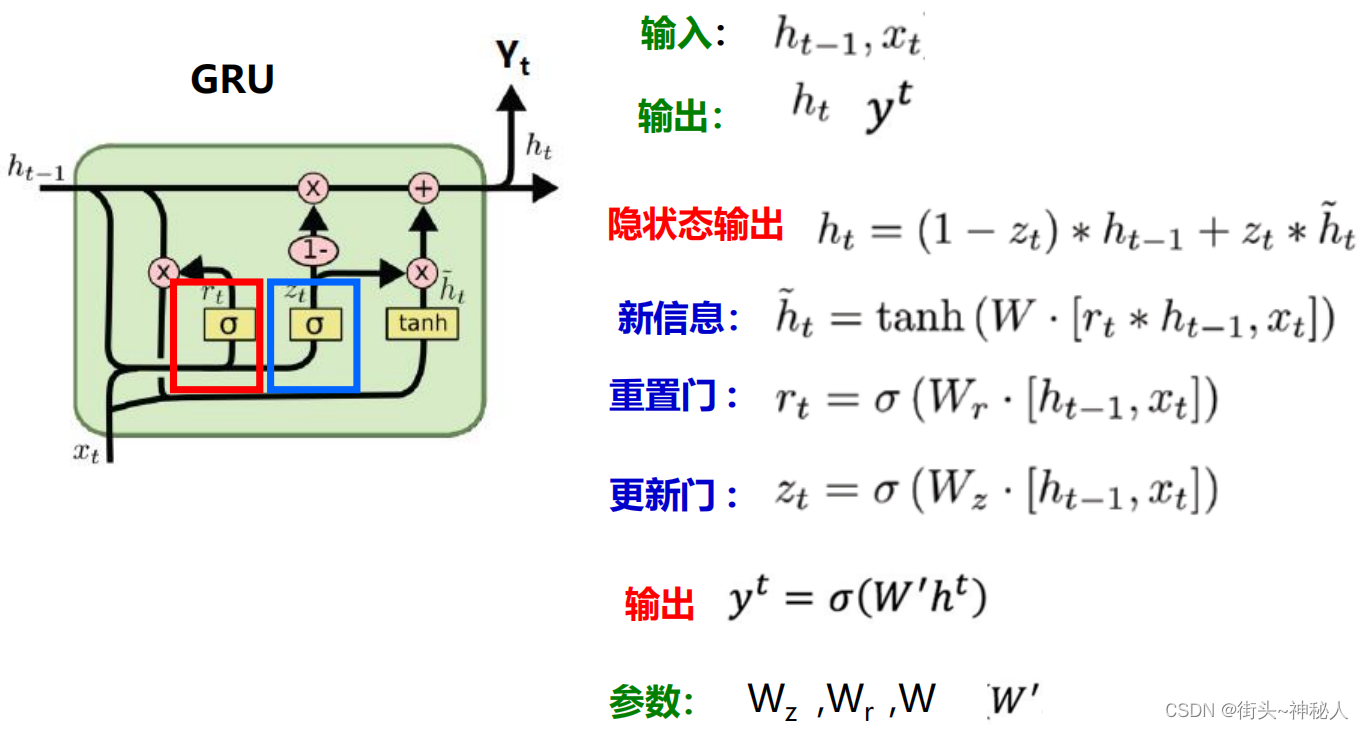

LSTM细胞的一种变体被称为门控循环单元,简称GRU(Gated Recurrent Unit)。GRU 是Kyunghyun Cho等人在2014年的一篇论文中提出的。LSTM 简化: 输入门和遗忘门合并为更新门(更新门决定隐状态保留放弃部分)。

GRU是LSTM细胞的简化版本,速度比LSTM快一点,而且性能似乎也与LSTM相当,这就是它为什么越来越受欢迎的原因。

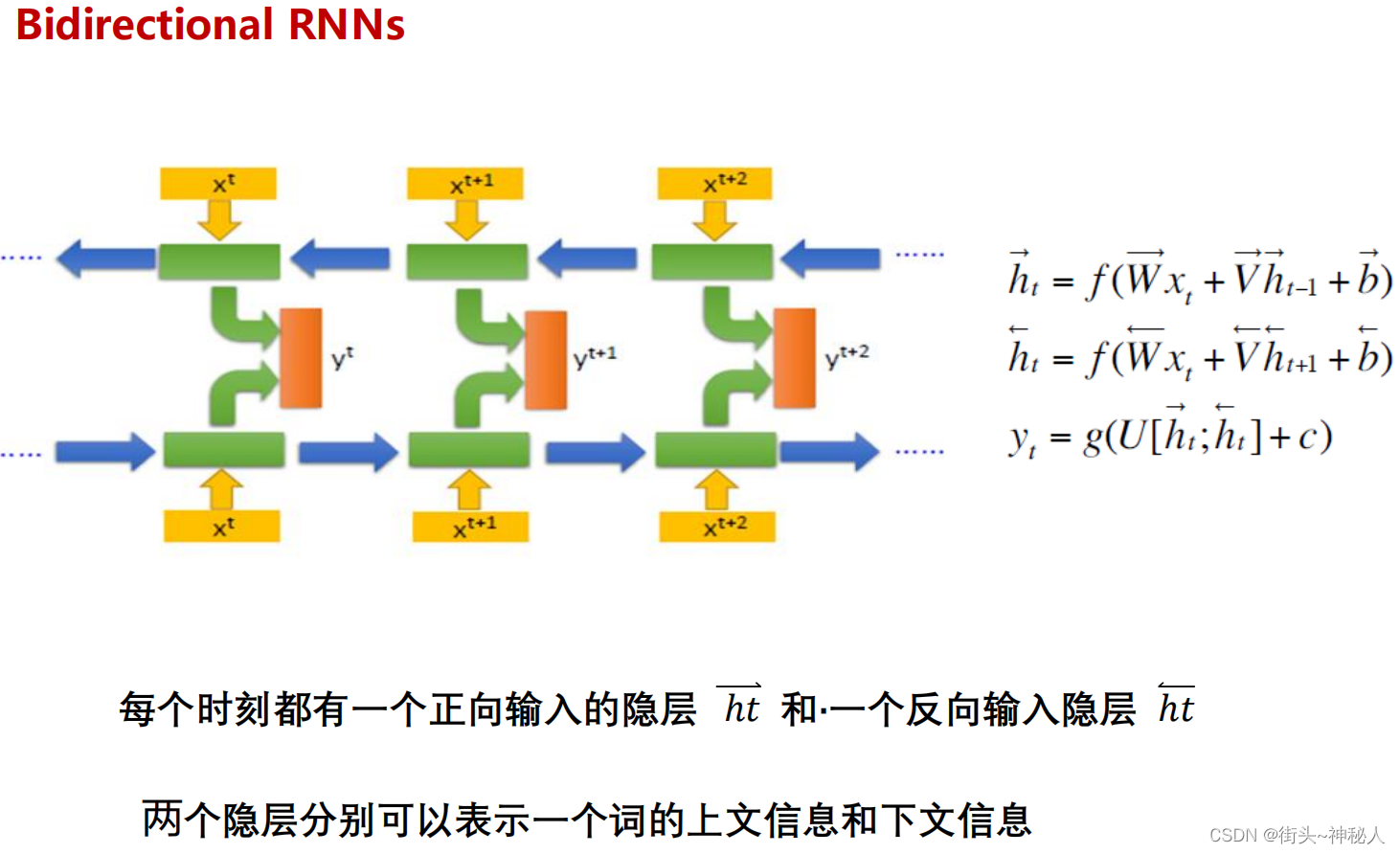

双向LSTM

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?