逻辑回归logistic regression的概念已经被classification代替掉。

对于一个问题是否是logistic regression或classification已经不重要了。

回归和分类对比

1.回归问题

目标:使得pred=y

方法:减少pred和y的差距(pred和y的平方差)

2.分类

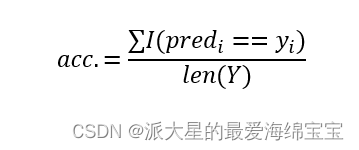

目标:最大化benchmar或accuracy等

方法1:减少dist(pθ(y|x),pr(y|x)),在θ条件上的y的条件概率分布与真实情况下的条件概率分布,使两者越接近越好

方法2:减少散度diviergence(pθ(y|x),pr(y|x))

问题

问题一:为什么不直接最大化accuracy

直接最大化accuracy会有以下两个问题

问题1:梯度为0,当数值weights变化时,accuracy没有变化。

对于分类,有一个阈值,假设阈值为0.5时,即使你的预测从0.4上升到0.49,更加接近真实值,但是因为没有超过阈值0.5,所以最后的accuracy值依然没有发生改变。相当于x变了,y没有变,y对x求的梯度为0.

问题2:梯度不连续,正确的数量不连续时。

当weights发生很小的变化时,也可能会跨过阈值,导致accuracy突变,使得梯度不稳定或者梯度爆炸。

问题二:为什么叫逻辑回归

使用sigmod

争议:(龙良曲老师总结)

MSE->regression

cross entropy->classification

使用两种不同方法求解loss,可以看作不同的问题

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?