目录

总纲

经典的网络

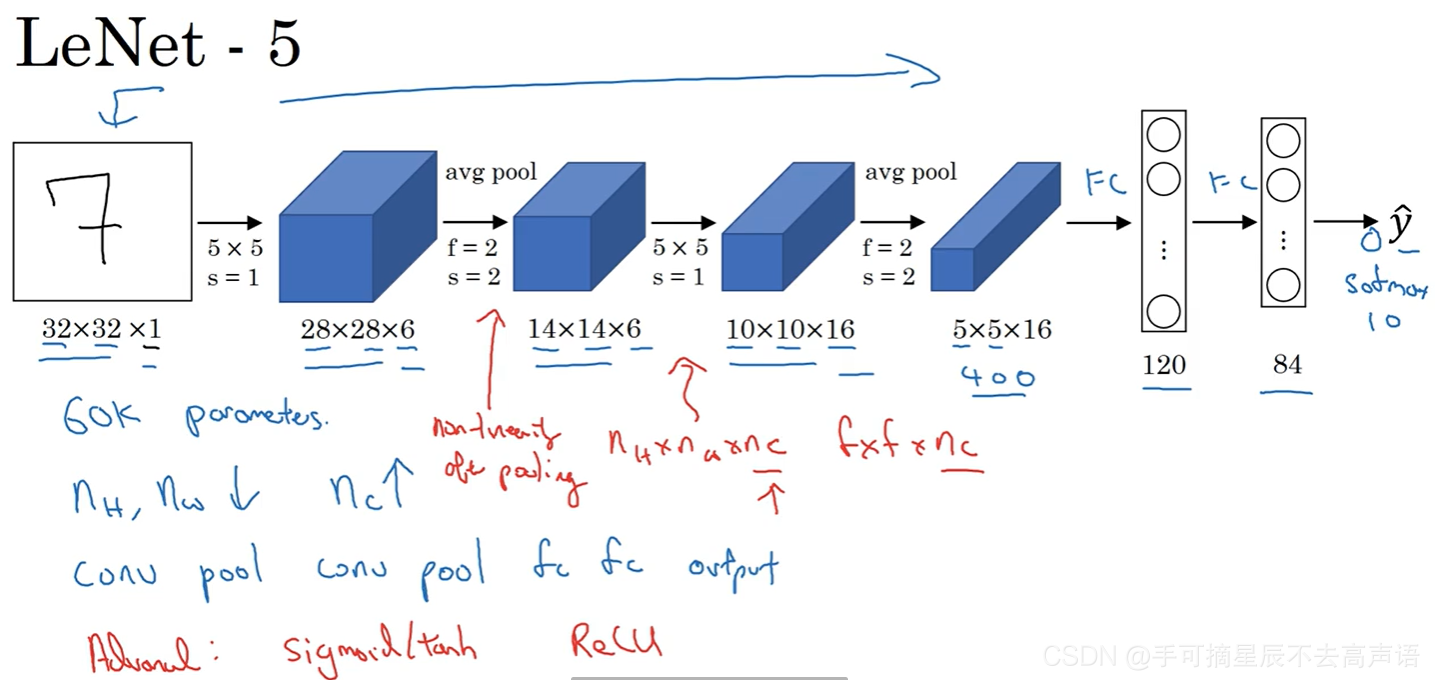

- LeNet-5

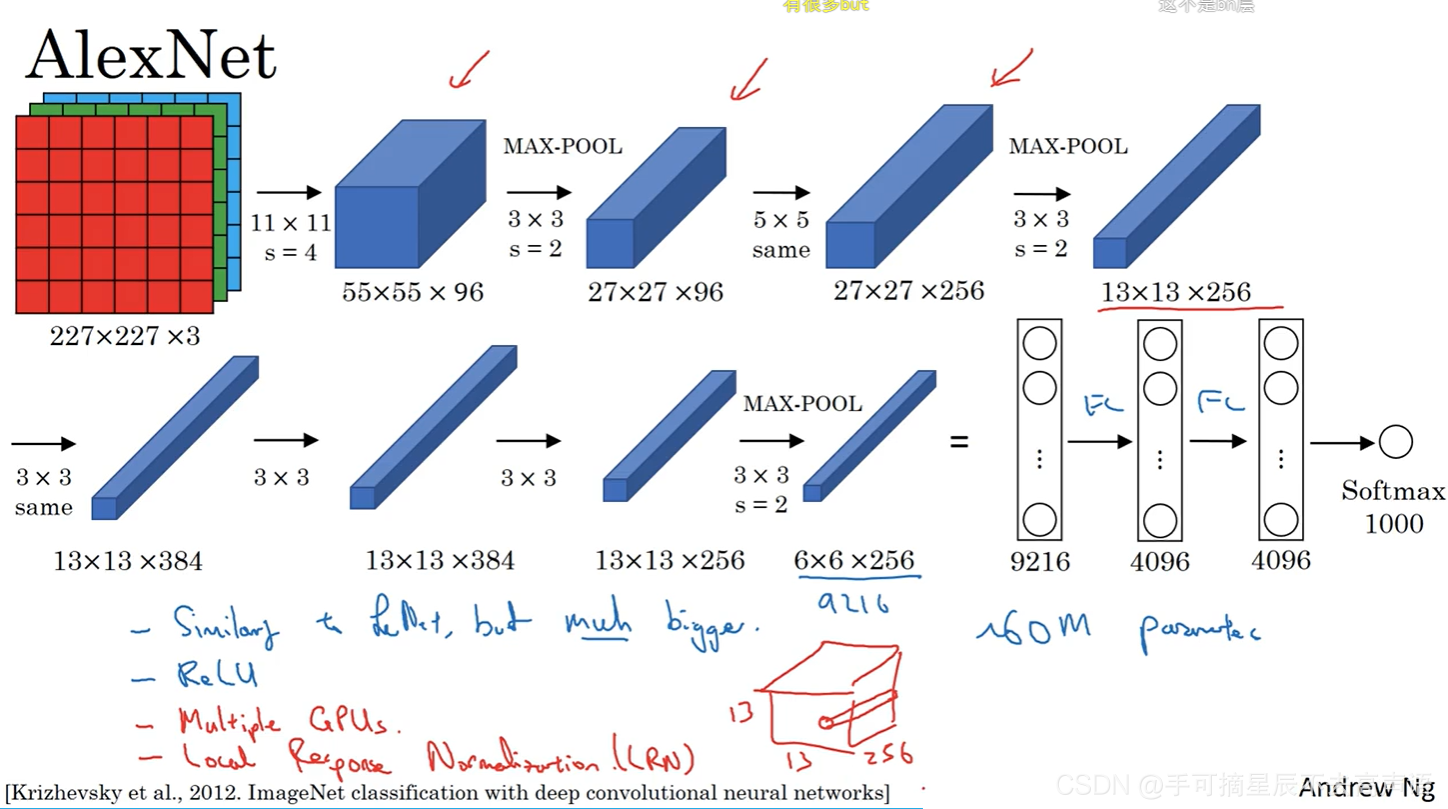

- AlexNet

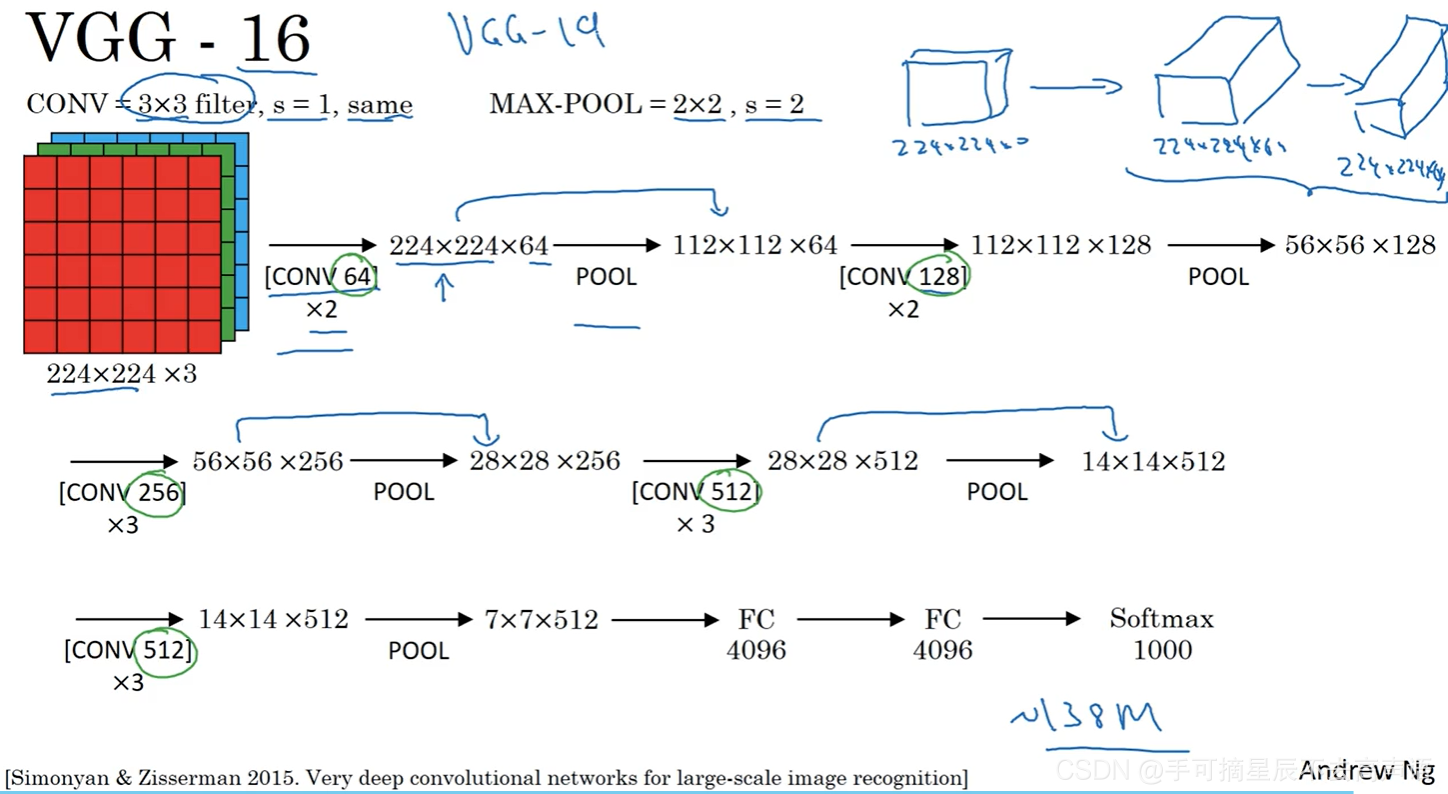

- VGG

ResNet

Inception

一、经典网络

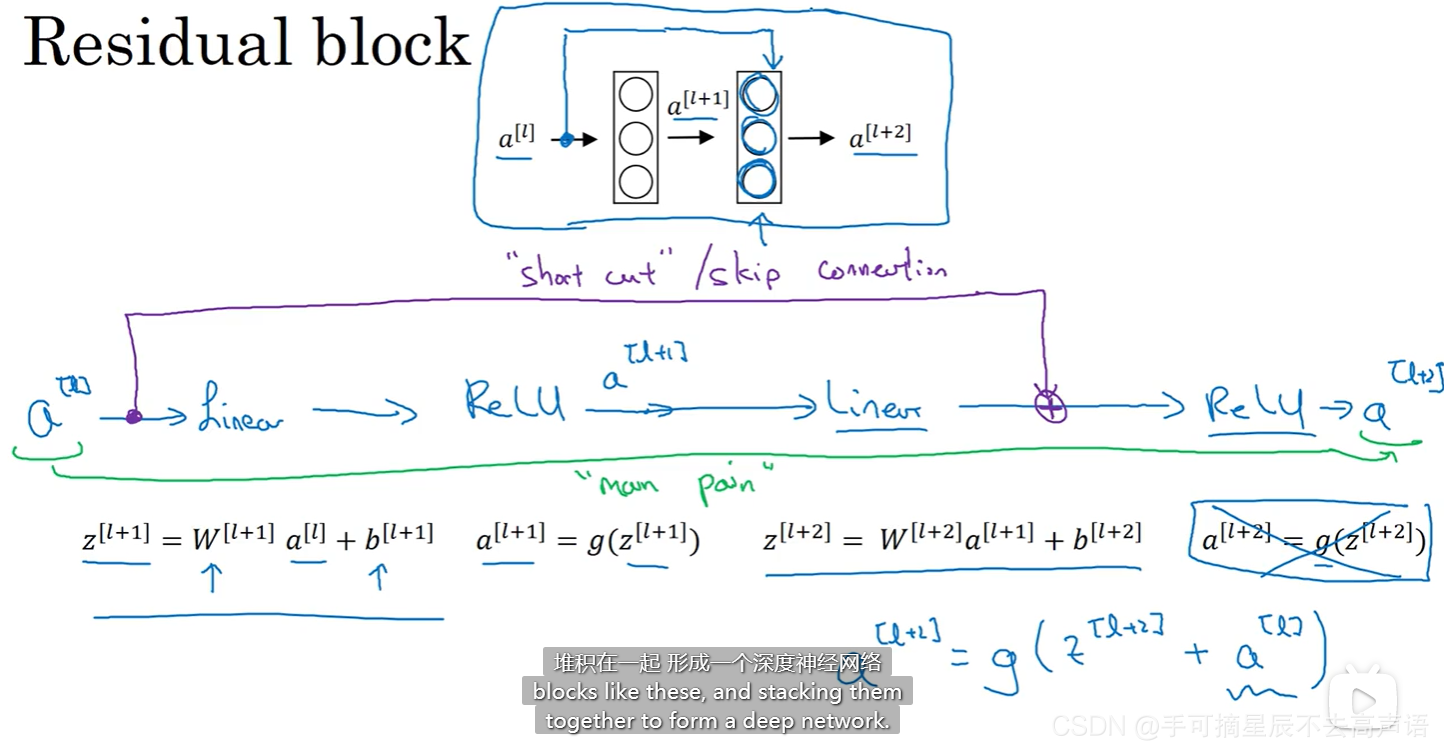

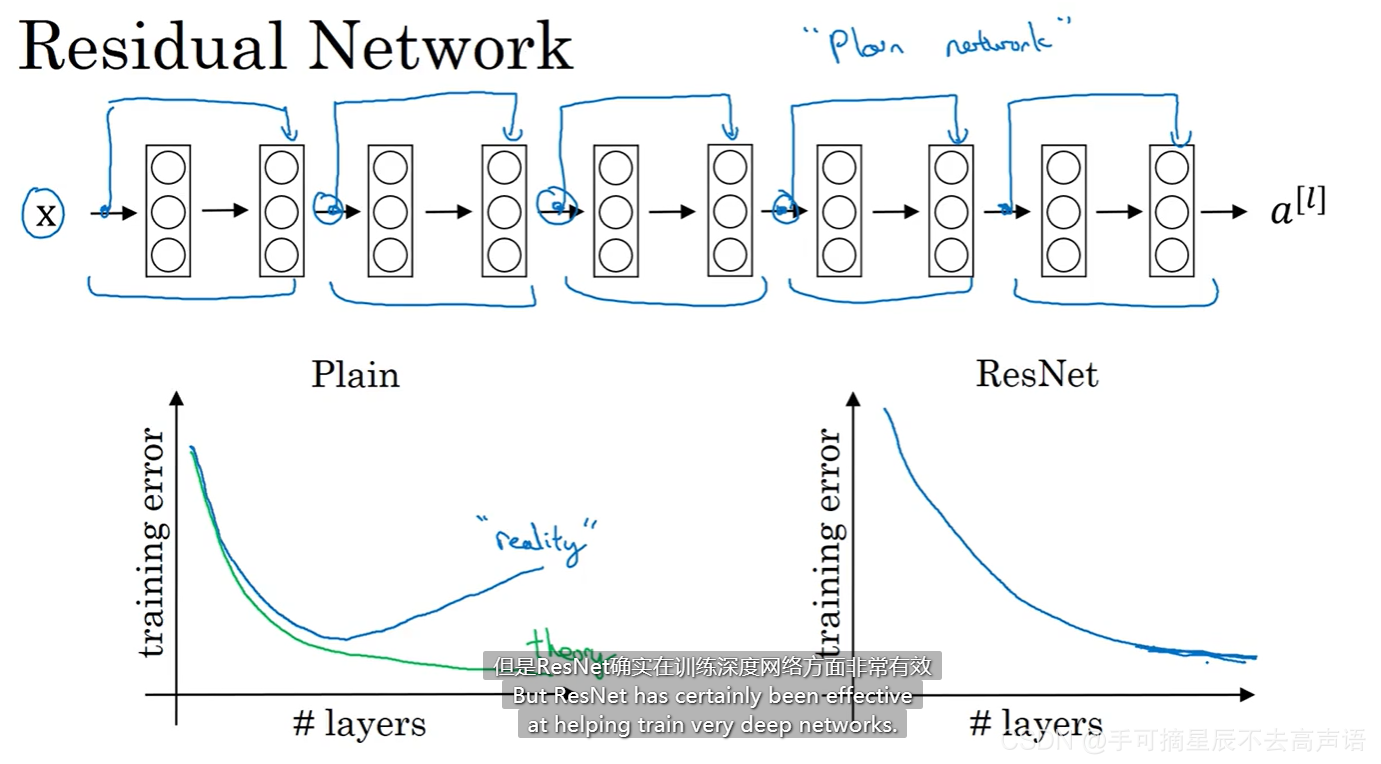

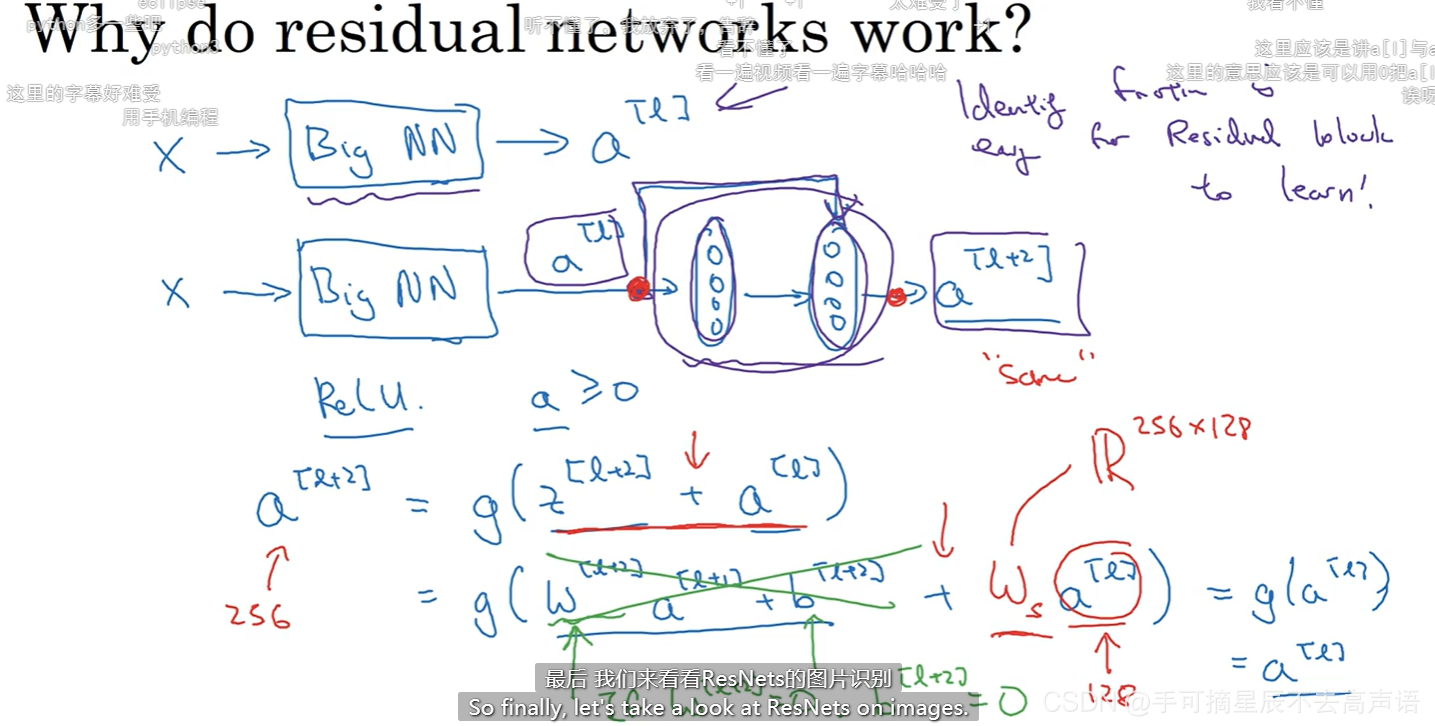

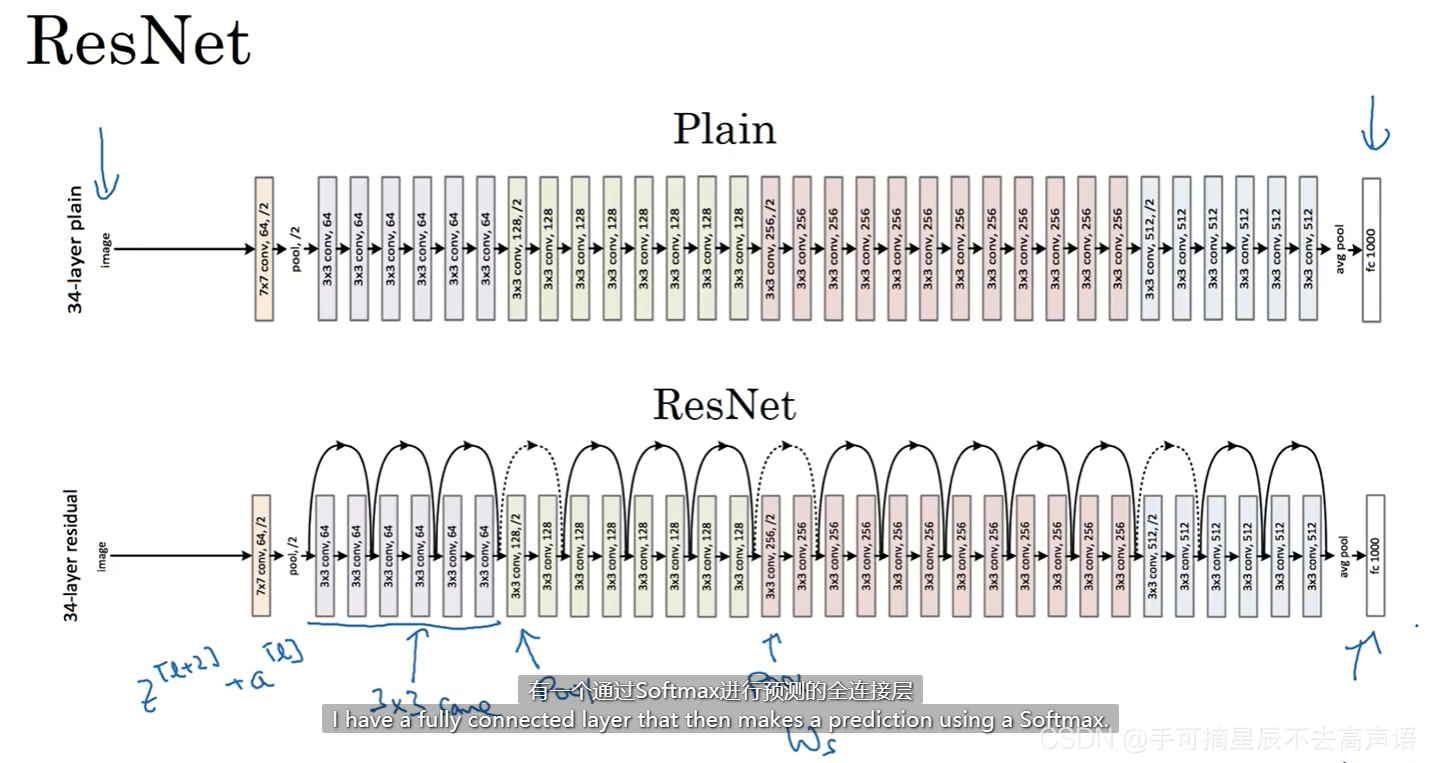

二、Residual Networks(ResNets)

一般前后维度设计成相同的,如果不同的话,那就添加一个w来设置成相同的维度

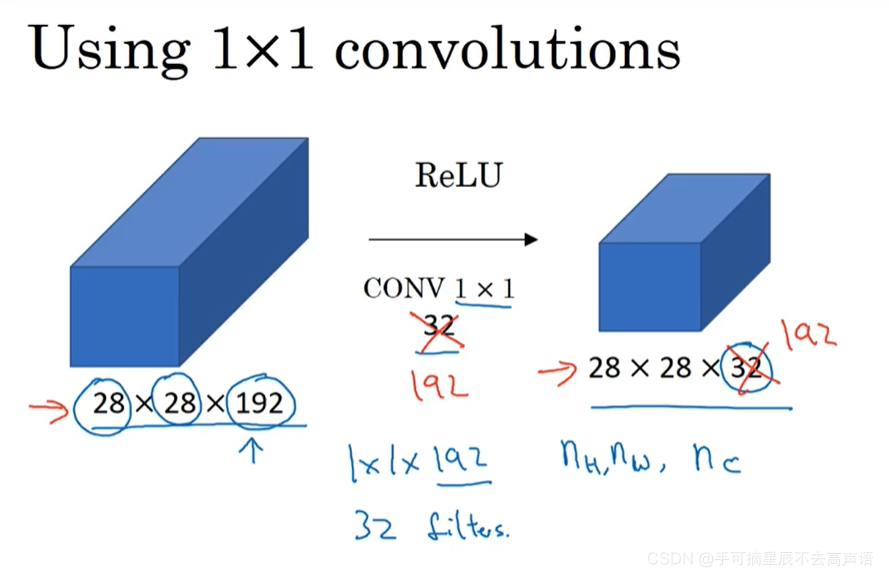

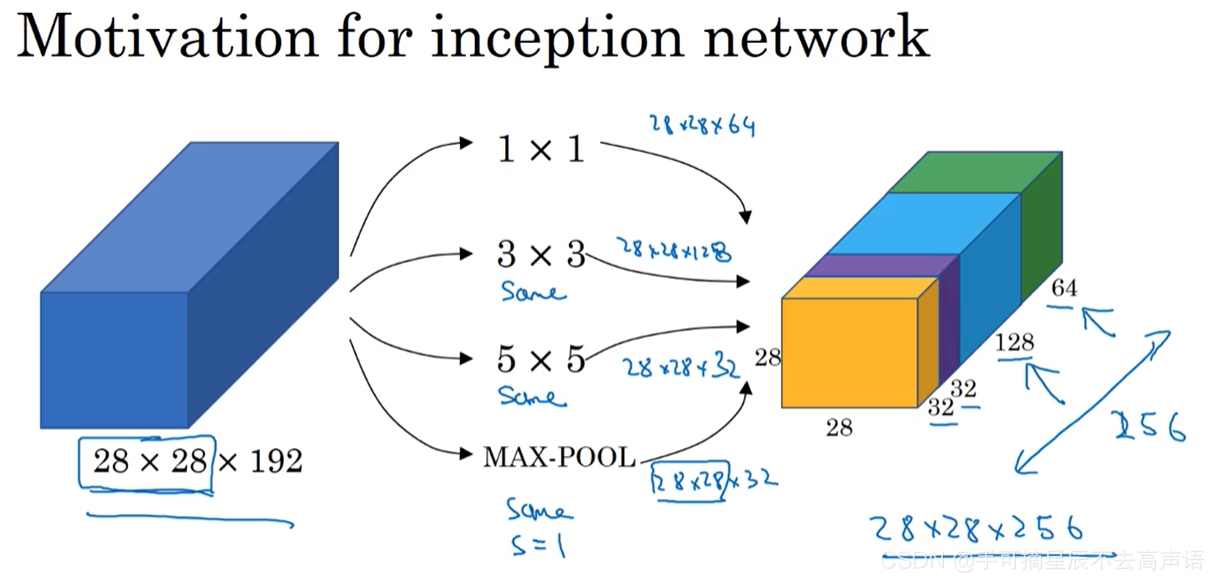

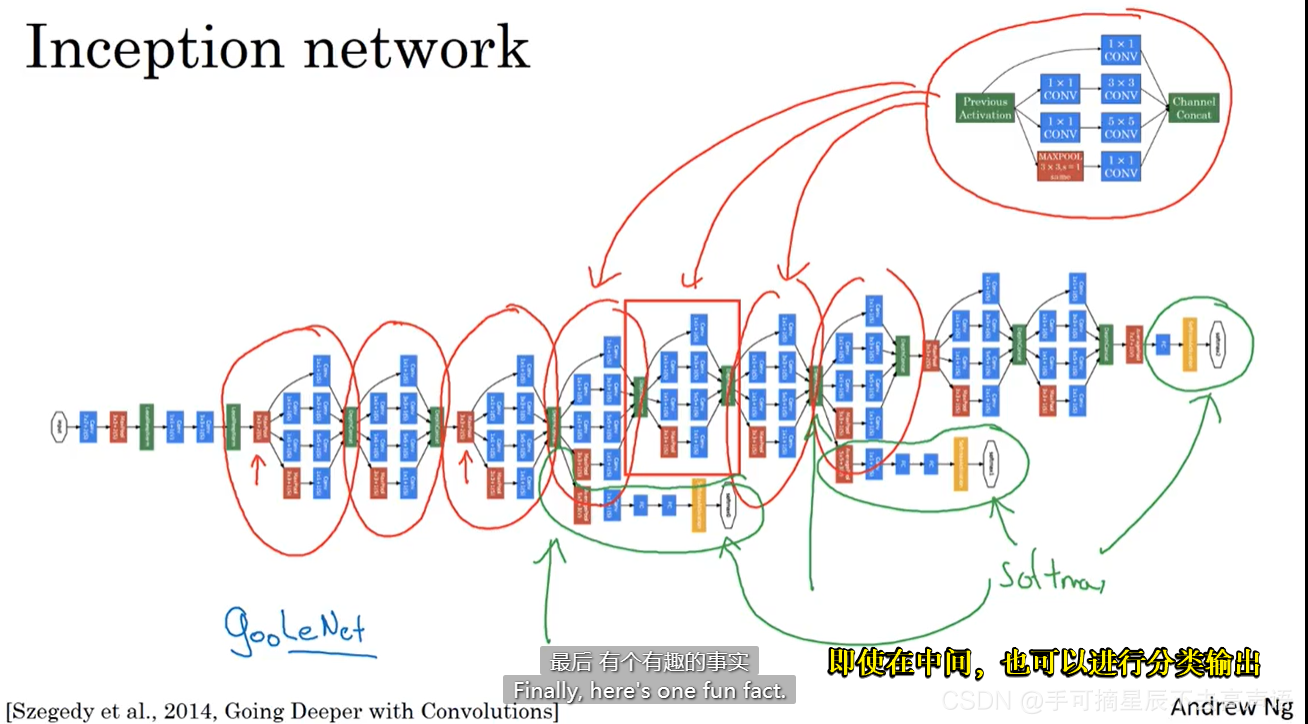

三、Inception

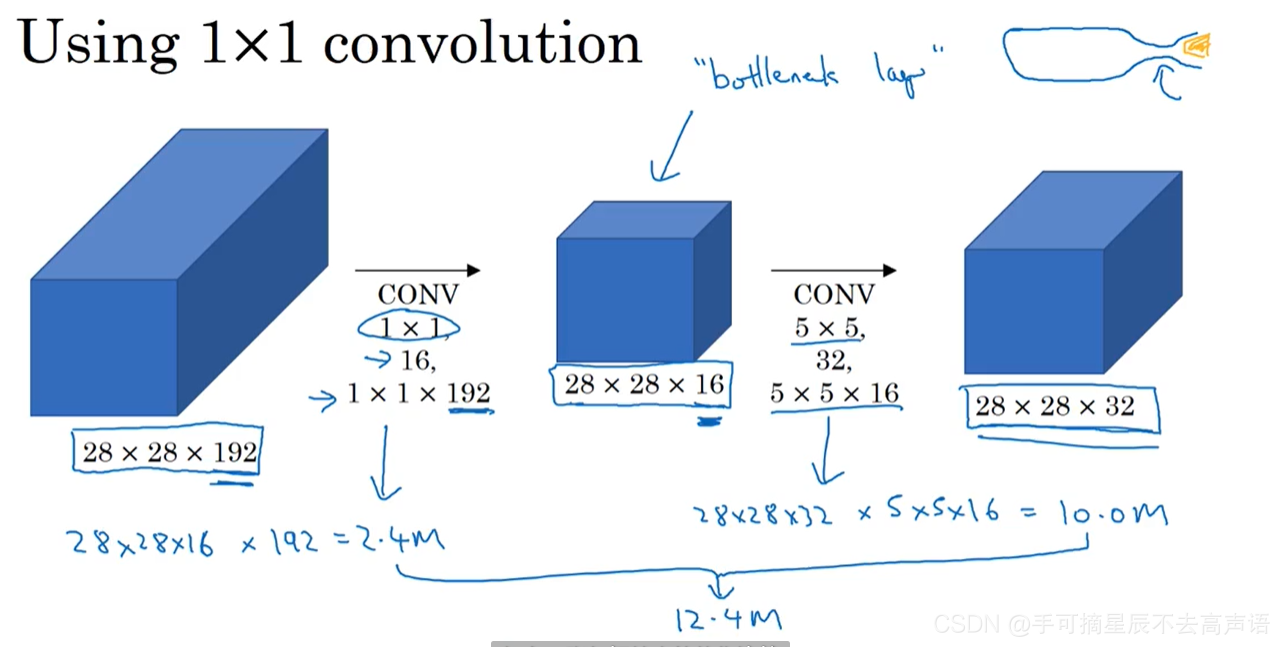

1×1网络:压缩信道

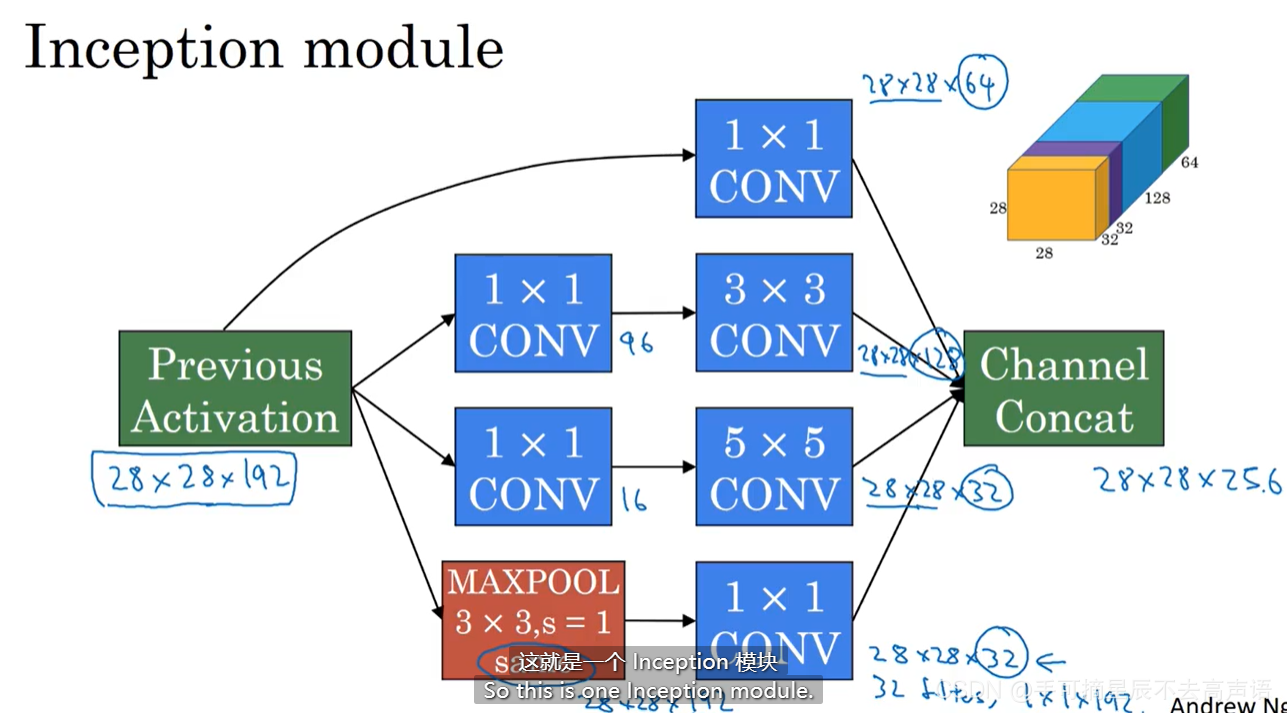

Inception的基本思想是:该网络不需要认为决定使用哪个过滤器,或是否需要池化,而是由网络自行确定这些参数,你可以为网络添加所有可能的值,然后把这些输出都连接起来,让网络自己学习它需要什么样的参数、采用哪一个滤波器

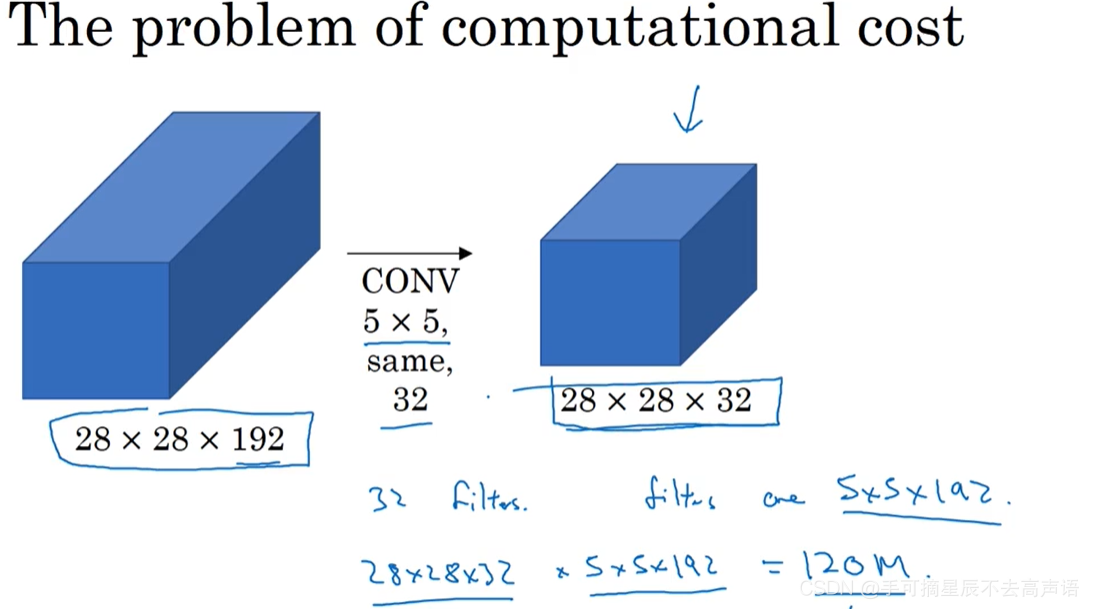

但是代价就是计算成本

如何计算计算量:

只要合理设置颈瓶层,那么既可以缩小运算规模,也不会降低网络性能

但是,Inception网络层如何做到代替人工来确定卷积层中的过滤器、确定是否需要池化层等等,这个是怎么做到的呢???等看论文的时候再去了解吧,网上都没有一个比较好的解释

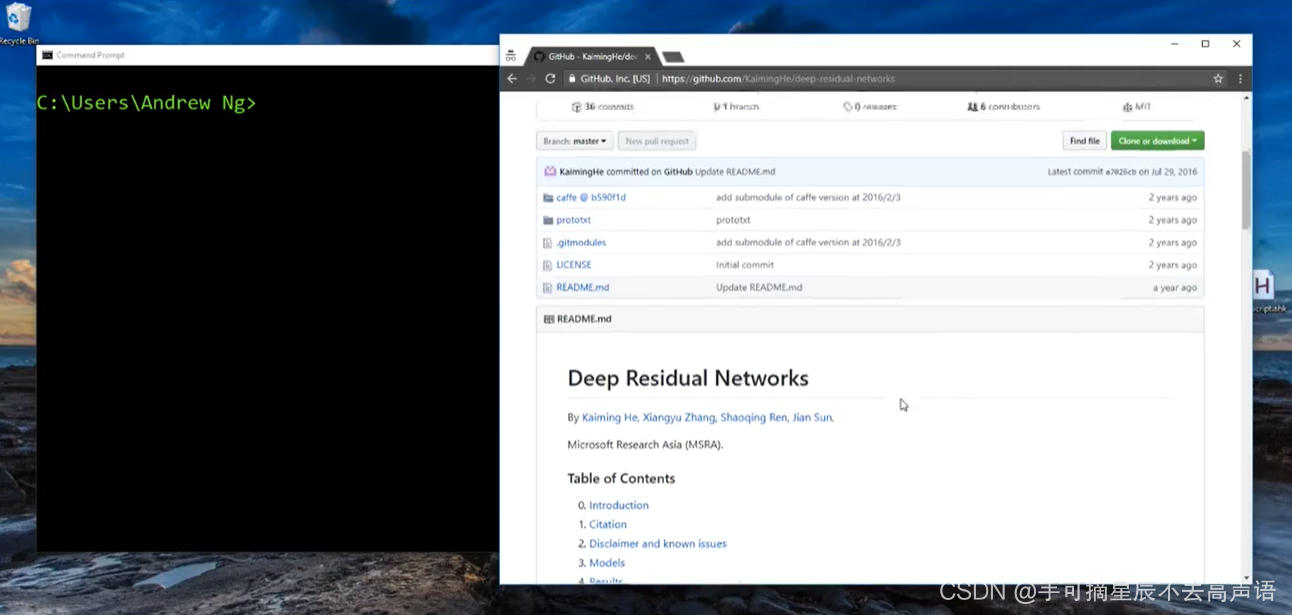

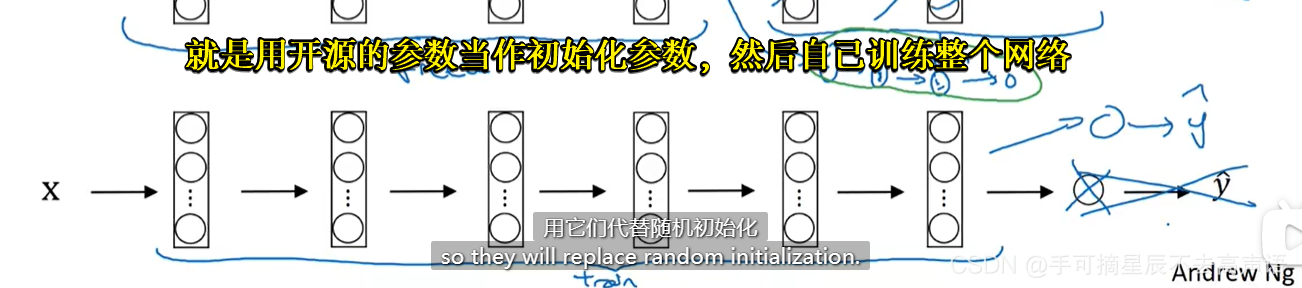

四、使用开源的实现建议以及迁移学习

因为论文里面的参数很难调整,即使是专业的学生也是很难复制他人的成果。

但是很多人都会将自己的研究成果开源,那么找一个开源的代码来说就很不错!!!

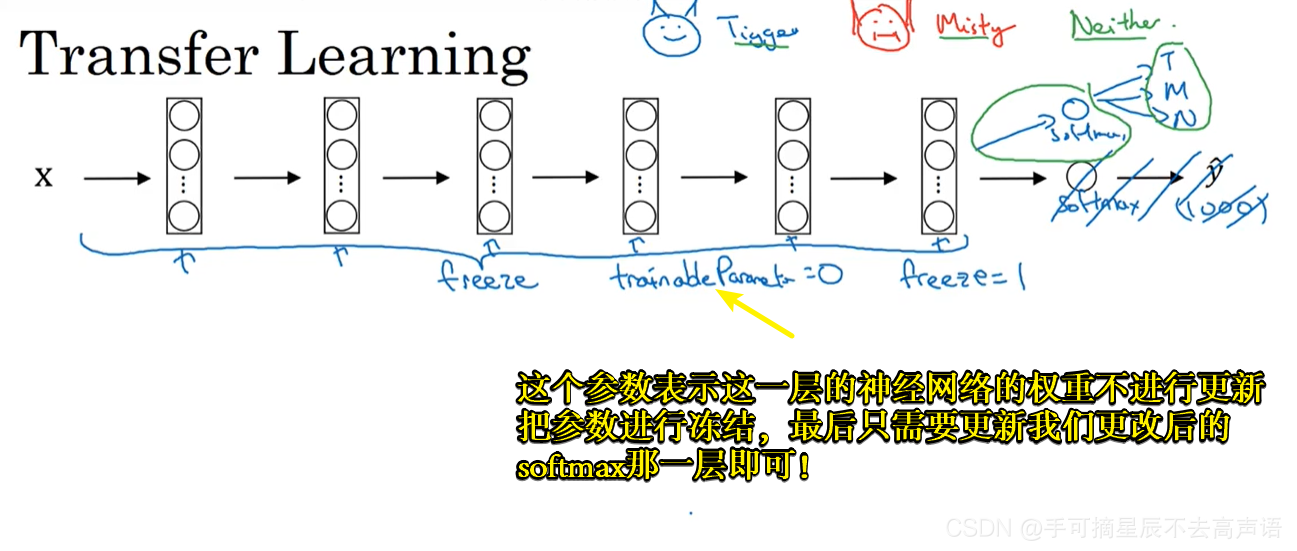

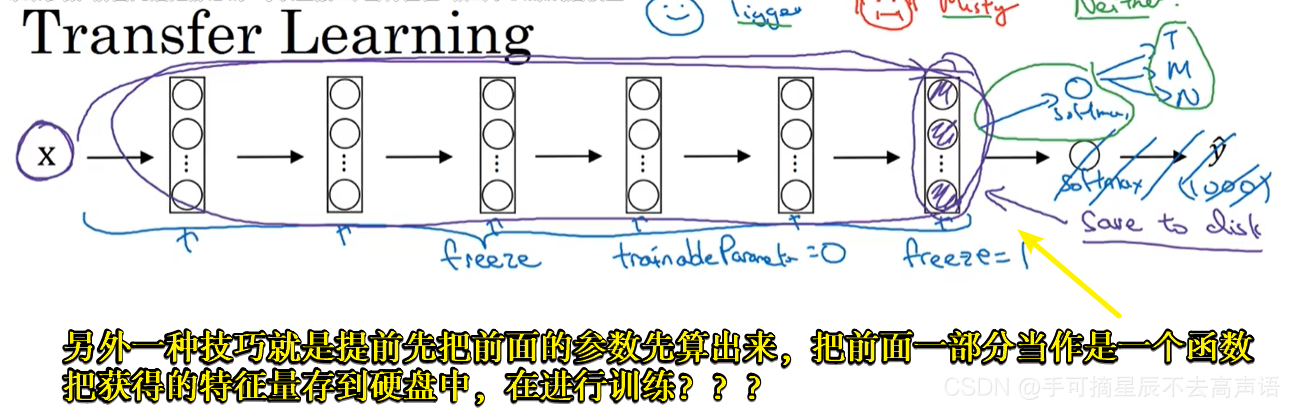

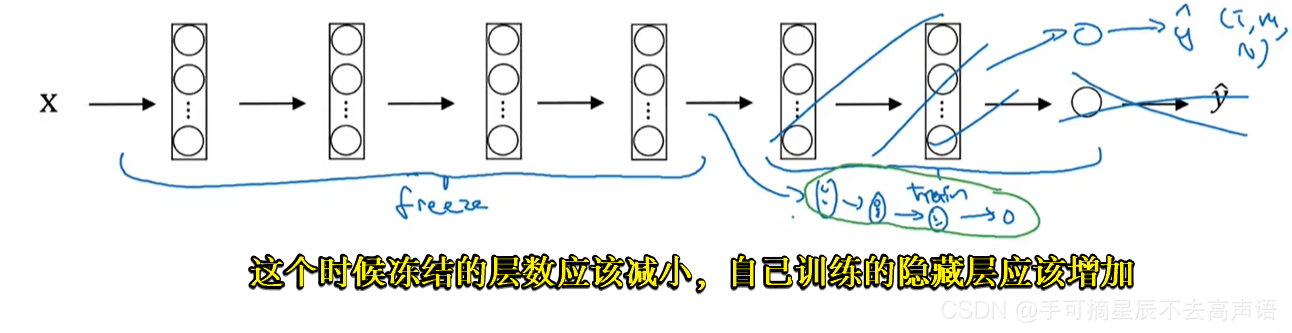

迁移学习

不如从别人已经训练很久的权重的参数开始训练自己的权重!进展就会相当快!

如果你的数据集很小的话:

如果你的数据集表较大的话:

如果你有大量的数据的话:

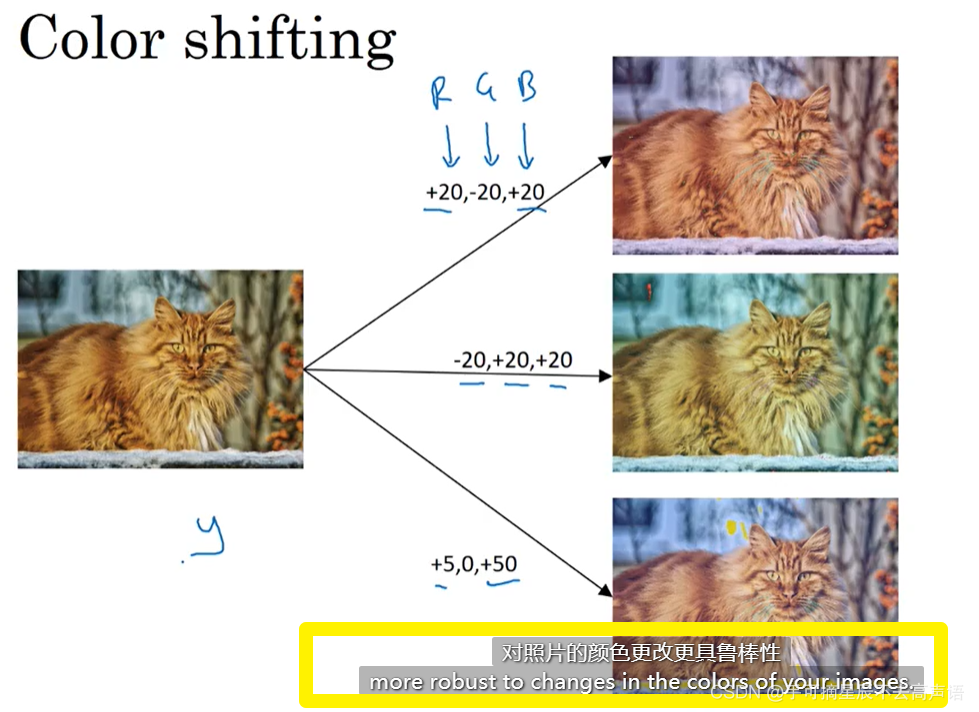

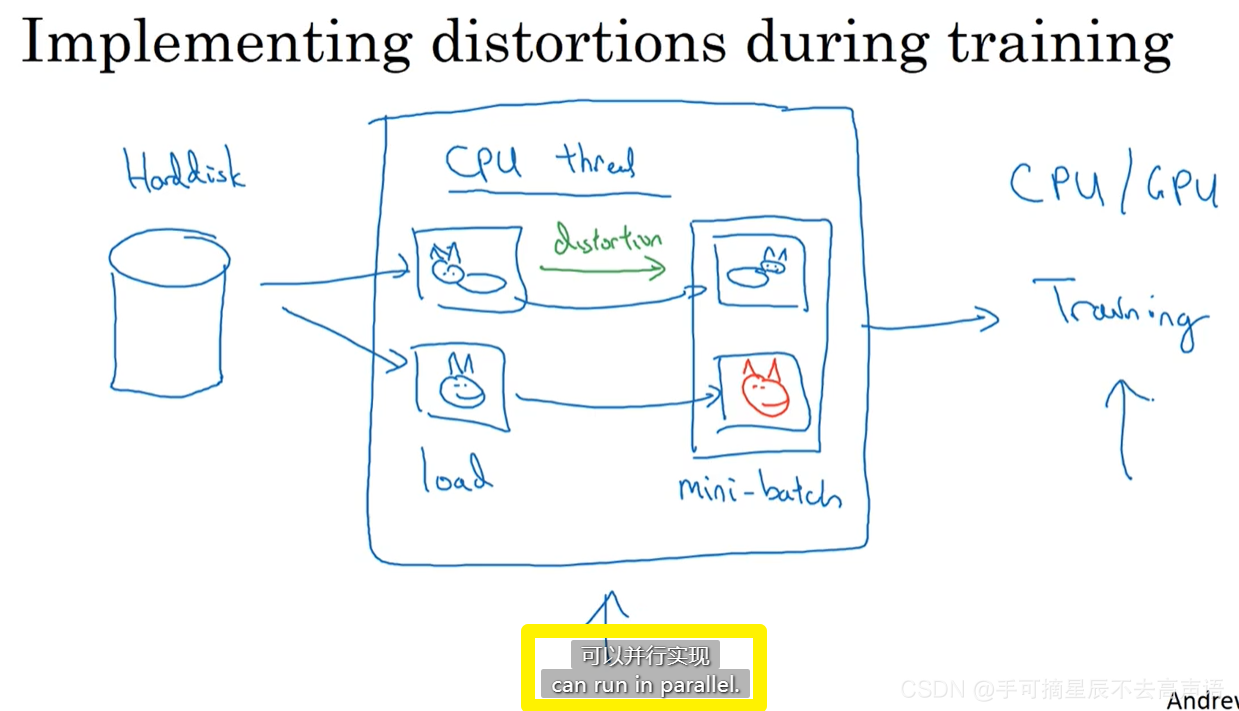

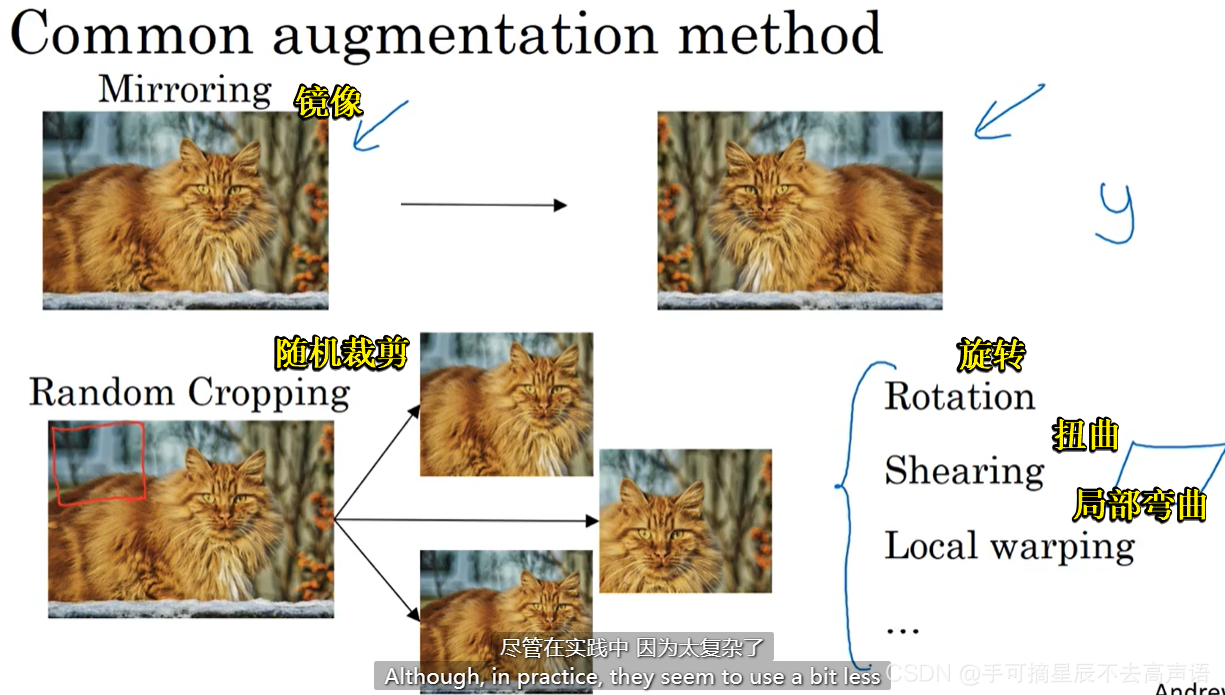

五、数据增强

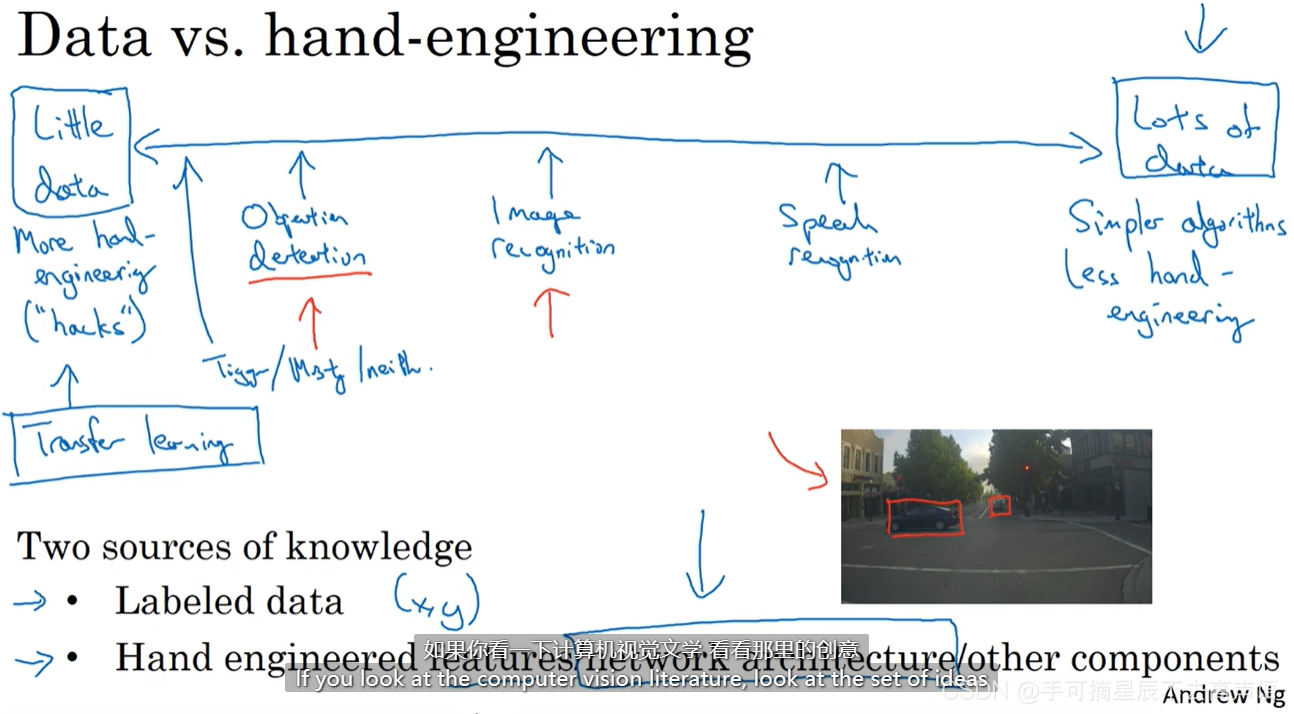

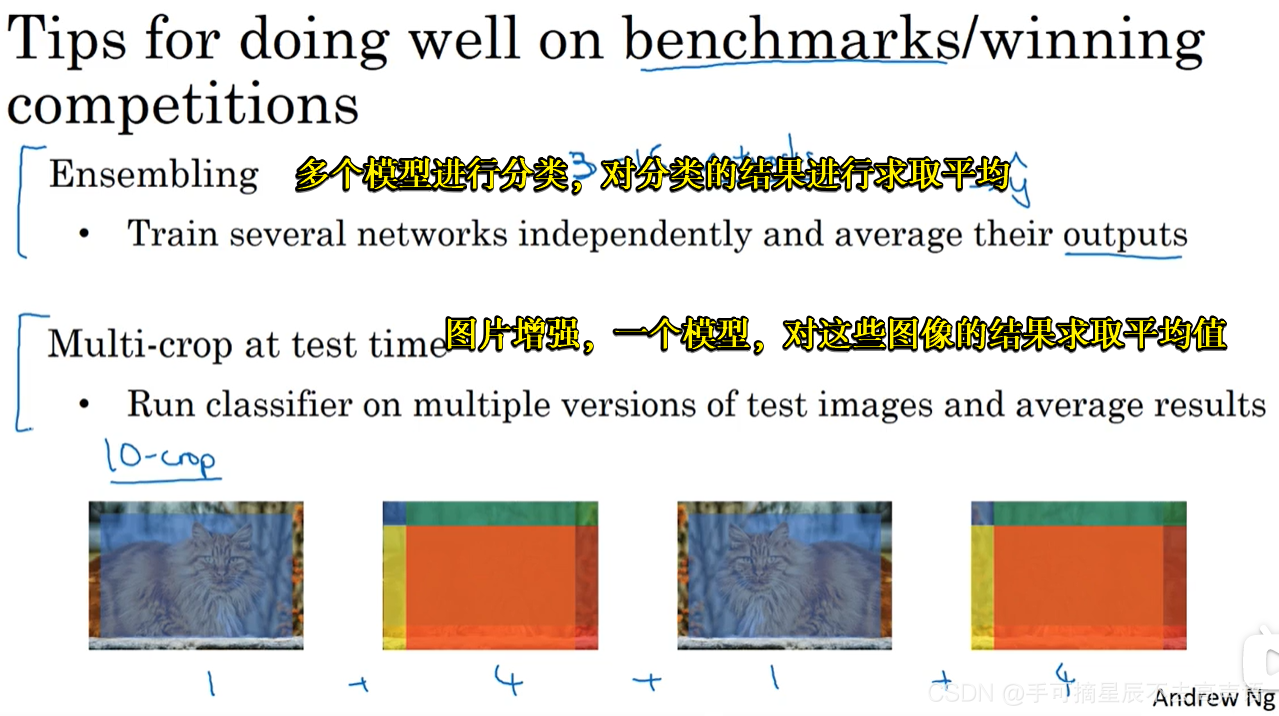

六、计算机视觉现状

深度解析:经典网络、ResNets与Inception:计算机视觉进阶指南

深度解析:经典网络、ResNets与Inception:计算机视觉进阶指南

本文探讨了经典网络如LeNet-5、AlexNet和VGG,重点剖析了Residual Networks(ResNets)的残差结构,以及Inception网络的模块化设计,包括1×1卷积和自动选择特征。此外,还介绍了开源实现、迁移学习策略,以及数据增强在视觉任务中的应用。

本文探讨了经典网络如LeNet-5、AlexNet和VGG,重点剖析了Residual Networks(ResNets)的残差结构,以及Inception网络的模块化设计,包括1×1卷积和自动选择特征。此外,还介绍了开源实现、迁移学习策略,以及数据增强在视觉任务中的应用。

1833

1833

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?