`.grad_fn` 属性的作用是记录创建张量时所执行的函数,即grad_fn表示变量通过怎样的计算方式得到,叶节点变量None。

这对于计算图的构建和反向传播至关重要。在反向传播过程中,PyTorch 会利用 `.grad_fn` 属性沿着计算图传播梯度。

具体作用和示例

假设我们有以下代码:

import torch

# 创建一个张量,要求计算梯度

x = torch.randn(2, requires_grad=True)

# 打印张量的 grad_fn 属性

print(f'x: {x}, grad_fn: {x.grad_fn}')

# 进行一些计算

y = x * x + 3

print(f'y: {y}, grad_fn: {y.grad_fn}')

# 进一步计算

out = y.mean()

print(f'out: {out}, grad_fn: {out.grad_fn}')

分析输出

1. **初始张量 `x`**:

x = torch.randn(2, requires_grad=True)

print(f'x: {x}, grad_fn: {x.grad_fn}')

对于初始张量 `x`,因为它是由 `torch.randn` 生成的,所以没有前驱操作,它的 `grad_fn` 属性为 `None`。

2. **计算 `y`**:

y = x * x + 3

print(f'y: {y}, grad_fn: {y.grad_fn}')这里,`y` 是由 `x` 通过一些操作(乘法和加法)得到的。`y` 的 `grad_fn` 会显示这个张量是通过哪些操作生成的。例如,这里可能显示为 `AddBackward0`,表示最后一个操作是加法,之前还有乘法。

3. **计算 `out`**:

out = y.mean()

print(f'out: {out}, grad_fn: {out.grad_fn}')这里,`out` 是 `y` 的平均值。`out` 的 `grad_fn` 会显示它是通过均值操作生成的,通常显示为 `MeanBackward0`。

反向传播中的作用

`grad_fn` 属性在反向传播过程中非常重要,因为它帮助 PyTorch 跟踪和管理计算图。以下是一个反向传播的示例:

import torch

# 创建一个张量,要求计算梯度

x = torch.randn(2, requires_grad=True)

# 进行一些计算

y = x * x + 3

# 进一步计算

out = y.mean()

# 进行反向传播

out.backward()

# 打印梯度

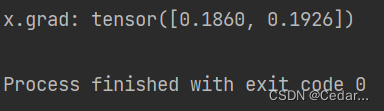

print(f'x.grad: {x.grad}')在这个过程中,`grad_fn` 会被用于追踪如何通过计算图传播梯度。例如,当我们调用 `out.backward()` 时,PyTorch 会从 `out` 的 `grad_fn` 属性开始,逐步回溯计算图并计算每个节点的梯度。

运行输出:

(注意:由于 torch.randn 每次生成的值都不同,因此输出也会不同)

总结

`.grad_fn` 是 PyTorch 中每个张量的一个属性,用于记录生成这个张量的操作。当进行反向传播时,`grad_fn` 帮助 PyTorch 确定如何沿着计算图传播梯度。通过查看 `grad_fn`,我们可以理解张量是如何通过一系列操作生成的,这对于调试和理解模型的计算流程非常有用。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?